决定系数(r 平方)

本文解释了统计学中的决定系数(或 R 方)。因此,您将了解如何计算决定系数、如何解释它,以及用于计算数据样本决定系数的在线计算器。

决定系数(R 平方)是多少?

决定系数,其符号为R 2 ( R 平方),是衡量回归模型拟合优度的统计量。决定系数表示回归模型对数据集的拟合程度,即表示回归模型解释的百分比。

因此,决定系数越高,回归模型越好。尽管这个条件并不总是满足,但我们原则上对尽可能大的决定系数感兴趣。我们将在下面看到如何解释决定系数。

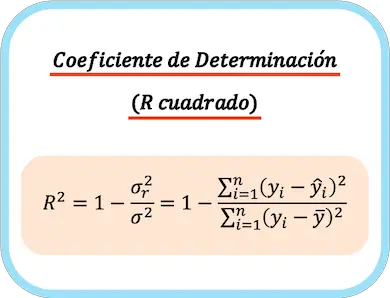

确定系数公式

决定系数等于一减去残差方差与因变量方差之比。确定系数也可以通过从总平方和的残差中减去一减去平方和来计算。

因此,决定系数的计算公式如下:

金子:

-

是决定系数。

-

是残差方差。

-

是因变量 Y 的方差。

-

是观测因变量 i 的值。

-

是观测值 i 的回归模型的近似值。

-

是所有观测值中因变量的平均值。

👉您可以使用下面的计算器来计算任何数据集的决定系数。

对于线性回归模型的情况,决定系数等于相关系数的平方:

![]()

金子

![]()

是变量 X 和 Y 的协方差,

![]()

和

![]()

分别是自变量 X 和因变量 Y 的方差。

决定系数计算器

将样本数据插入下面的计算器以拟合简单的线性回归模型并计算其决定系数。您需要分离数据对,以便第一个框中只有自变量 X 的值,第二个框中只有因变量 Y 的值。

数据必须用空格分隔,并使用句点作为小数点分隔符输入。

决定系数的解释

在本节中,我们将了解如何解释决定系数,因为如果您稍后不知道决定系数的含义,那么知道决定系数的值是没有意义的。

决定系数的值可以从 0 到 1,但通常以百分比表示,因此最小值为 0%,最大值为 100%。

关于决定系数的解释,其值越高意味着回归模型对数据样本的解释越好。因此,决定系数越接近1,模型调整的幅度就越大。另一方面,它越接近 0,生成的回归模型的可靠性就越低。

然而,当比较两个回归模型时,回归系数较高的模型并不总是更好。例如,回归模型可能具有回归系数R 2 = 100%,因为模型中添加了许多解释变量,因此它可以完美地解释所有观察结果。但该模型对未用于构建回归模型的新值的预测肯定非常差。

还应该记住,所得的回归模型满足先前的假设。因此,如果残差的变异性不是恒定的(同方差性),则具有非常高的确定系数的模型是无用的。

此外,决定系数提出了一个重要的限制,因为它不会惩罚包含解释变量。从逻辑上讲,回归模型的解释变量越多,模型就越复杂,但它能更好地解释观察到的数据,因此决定系数就越高。然而,调整后的决定系数考虑了模型中的变量数量(我们将在下面看到它是如何计算的)。

总之,决定系数对于分析回归模型非常有用,因为它让我们知道回归模型对数据集的拟合程度。然而,还应该使用其他工具来审查生成的模型,例如统计图表。

调整决定系数

调整决定系数也称为调整决定系数,通过考虑模型中包含的解释变量的数量来衡量回归模型的拟合优度。

决定系数与调整决定系数的区别在于,决定系数衡量调整的质量,不考虑变量的数量,而调整决定系数衡量调整的质量对每个添加的变量进行惩罚。

调整后决定系数的计算公式如下:

![]()

金子:

-

是调整后的决定系数。

-

是决定系数。

-

是样本大小。

-

是回归模型中解释变量的数量。

因此,调整后的决定系数优于比较两个不同模型的决定系数,因为这些模型可能具有不同数量的解释变量。