Logistische regression

In diesem Artikel wird erklärt, was logistische Regression in der Statistik ist. Ebenso finden Sie die logistische Regressionsformel, welche verschiedenen Arten der logistischen Regression es gibt und darüber hinaus eine gelöste logistische Regressionsübung.

Was ist logistische Regression?

In der Statistik ist die logistische Regression eine Art Regressionsmodell, das zur Vorhersage des Ergebnisses einer kategorialen Variablen verwendet wird. Das heißt, die logistische Regression wird verwendet, um die Wahrscheinlichkeit zu modellieren, dass eine kategoriale Variable basierend auf den unabhängigen Variablen einen bestimmten Wert annimmt.

Das gebräuchlichste logistische Regressionsmodell ist die binäre logistische Regression, bei der es nur zwei mögliche Ergebnisse gibt: „Misserfolg“ oder „Erfolg“ ( Bernoulli-Verteilung ). „Misserfolg“ wird durch den Wert 0 dargestellt, während „Erfolg“ durch den Wert 1 dargestellt wird.

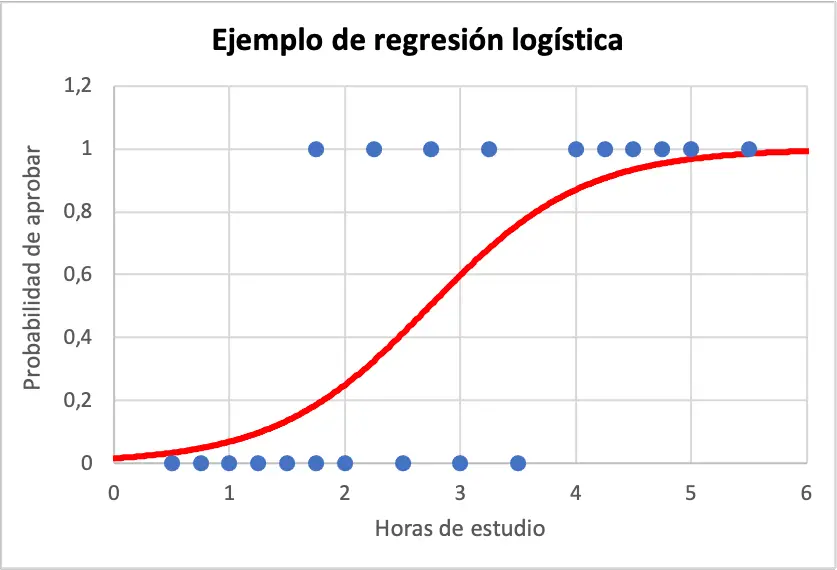

Beispielsweise kann die Wahrscheinlichkeit, dass ein Student eine Prüfung besteht, basierend auf den Stunden, die er mit dem Lernen verbracht hat, mithilfe eines logistischen Regressionsmodells untersucht werden. In diesem Fall wäre Scheitern die Folge von „Misserfolg“ und umgekehrt wäre Erfolg die Folge von „Erfolg“.

Logistische Regressionsformel

Die Gleichung für ein logistisches Regressionsmodell lautet:

![]()

Daher wird in einem logistischen Regressionsmodell die Wahrscheinlichkeit, das Ergebnis „Erfolg“ zu erhalten, d. h. dass die abhängige Variable den Wert 1 annimmt, mit der folgenden Formel berechnet:

![]()

Gold:

-

ist die Wahrscheinlichkeit, dass die abhängige Variable 1 ist.

-

ist die Konstante des logistischen Regressionsmodells.

-

ist der Regressionskoeffizient der Variablen i.

-

ist der Wert der Variablen i.

Beispiel für ein logistisches Regressionsmodell

Nachdem wir nun die Definition der logistischen Regression kennen, sehen wir uns ein konkretes Beispiel dafür an, wie man ein Modell dieser Art von Regression erstellt.

- In der folgenden Tabelle wurde eine Reihe von 20 Daten zusammengestellt, die sich auf die Studienstunden jedes Studenten und darauf beziehen, ob er eine Statistikprüfung bestanden oder nicht bestanden hat. Führen Sie ein logistisches Regressionsmodell durch und berechnen Sie die Wahrscheinlichkeit, dass ein Schüler besteht, wenn er oder sie 4 Stunden lang lernt.

In diesem Fall ist die erklärende Variable die Anzahl der Lernstunden und die Antwortvariable ist, ob der Student die Prüfung nicht bestanden (0) oder bestanden (1) hat. Daher haben wir in unserem Modell nur den Koeffizienten

![]()

und der Koeffizient

![]()

, da es nur eine unabhängige Variable gibt.

![]()

Die manuelle Bestimmung von Regressionskoeffizienten ist sehr aufwändig, daher empfiehlt sich die Verwendung von Computersoftware wie Minitab. Somit lauten die mit Minitab berechneten Werte der Regressionskoeffizienten wie folgt:

![Rendered by QuickLaTeX.com \begin{array}{c}\beta_0\approx -4,1\\[2ex]\beta_1\approx 1,5\end{array}](https://statorials.org/wp-content/ql-cache/quicklatex.com-6ed66de602220c69aabb71a726fec9f8_l3.png)

Das logistische Regressionsmodell sieht daher wie folgt aus:

![Rendered by QuickLaTeX.com \begin{aligned}p&=\cfrac{1}{1+e^{-(\beta_0+\beta_1x_1+\beta_2x_2+\dots+\beta_ix_i)}}\\[2ex]p&=\cfrac{1}{1+e^{-(-4,1+1,5x_1)}}\\[2ex]p&=\cfrac{1}{1+e^{4,1-1,5x_1}}\end{aligned}](https://statorials.org/wp-content/ql-cache/quicklatex.com-0902ac67194bedf38d5f4ff06dc27a38_l3.png)

Unten sehen Sie die Beispieldaten und die Gleichung des logistischen Regressionsmodells grafisch dargestellt:

Um also die Wahrscheinlichkeit zu berechnen, dass ein Student erfolgreich sein wird, wenn er oder sie 4 Stunden gelernt hat, verwenden Sie einfach die Gleichung, die Sie aus dem logistischen Regressionsmodell erhalten:

![Rendered by QuickLaTeX.com \begin{aligned}p&=\cfrac{1}{1+e^{4,1-1,5x_1}}\\[2ex]p&=\cfrac{1}{1+e^{4,1-1,5\cdot 4}}\\[2ex]p&=0,8699\end{aligned}](https://statorials.org/wp-content/ql-cache/quicklatex.com-930691eafee62c04e59d9c4de8ef6a76_l3.png)

Kurz gesagt: Wenn ein Student vier Stunden lang lernt, besteht die Wahrscheinlichkeit, dass er die Prüfung besteht, bei 86,99 %.

Arten der logistischen Regression

Es gibt drei Arten der logistischen Regression :

- Binäre logistische Regression : Die abhängige Variable kann nur zwei Werte haben (0 und 1).

- Multinomiale logistische Regression : Die abhängige Variable hat mehr als zwei mögliche Werte.

- Ordinale logistische Regression : Mögliche Ergebnisse haben eine natürliche Reihenfolge.

Logistische Regression und lineare Regression

Abschließend werden wir zusammenfassend sehen, was der Unterschied zwischen einer logistischen Regression und einer linearen Regression ist, da das in der Statistik am häufigsten verwendete Regressionsmodell das lineare Modell ist.

Die lineare Regression wird zur Modellierung numerischer abhängiger Variablen verwendet. Darüber hinaus ist bei der linearen Regression die Beziehung zwischen den erklärenden Variablen und der Antwortvariablen linear.

Daher besteht der Hauptunterschied zwischen der logistischen Regression und der linearen Regression in der Art der abhängigen Variablen. Bei einer logistischen Regression ist die abhängige Variable kategorisch, während die abhängige Variable bei einer linearen Regression numerisch ist.

Daher wird die logistische Regression verwendet, um ein Ergebnis zwischen zwei möglichen Optionen vorherzusagen, während die lineare Regression dabei hilft, ein numerisches Ergebnis vorherzusagen.