Einführung in die multiple lineare regression

Wenn wir die Beziehung zwischen einer einzelnen Prädiktorvariablen und einer Antwortvariablen verstehen möchten, verwenden wir häufigeine einfache lineare Regression .

Wenn wir jedoch die Beziehung zwischen mehreren Prädiktorvariablen und einer Antwortvariablen verstehen möchten, können wir die multiple lineare Regression verwenden.

Wenn wir p Prädiktorvariablen haben, hat ein multiples lineares Regressionsmodell die Form:

Y = β 0 + β 1 X 1 + β 2 X 2 + … + β p

Gold:

- Y : Die Antwortvariable

- X j : die j -te Vorhersagevariable

- β j : Die durchschnittliche Auswirkung einer Erhöhung von X j um eine Einheit auf Y, wobei alle anderen Prädiktoren unverändert bleiben

- ε : Der Fehlerterm

Die Werte von β 0 , β 1 , B 2 , …, β p werden mit der Methode der kleinsten Quadrate ausgewählt, die die Summe der Quadrate der Residuen (RSS) minimiert:

RSS = Σ(y i – ŷ i ) 2

Gold:

- Σ : Ein griechisches Symbol für Summe

- y i : der tatsächliche Antwortwert für die i-te Beobachtung

- ŷ i : Der vorhergesagte Antwortwert basierend auf dem multiplen linearen Regressionsmodell

Die zum Ermitteln dieser Koeffizientenschätzungen verwendete Methode ist mit der Matrixalgebra verknüpft, und wir werden hier nicht auf die Details eingehen. Glücklicherweise kann jede Statistiksoftware diese Koeffizienten für Sie berechnen.

So interpretieren Sie die Ausgabe der multiplen linearen Regression

Angenommen, wir passen ein multiples lineares Regressionsmodell unter Verwendung der Prädiktorvariablen , der gelernten Stunden und der abgelegten Vorbereitungsprüfungen sowie der Prüfungspunktzahl einer Antwortvariablen an.

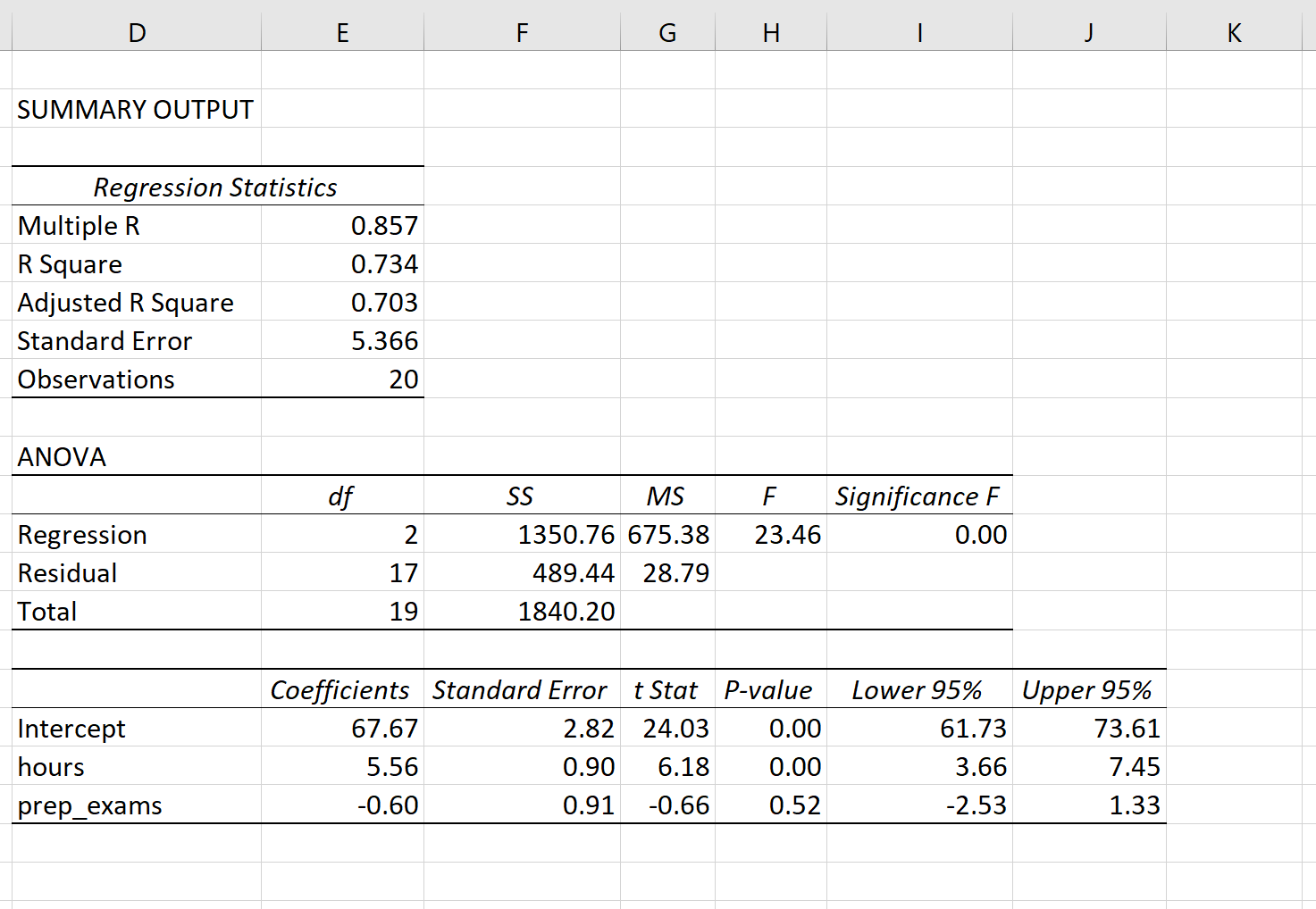

Der folgende Screenshot zeigt, wie das Ergebnis der multiplen linearen Regression für dieses Modell aussehen könnte:

Hinweis: Der Screenshot unten zeigt die Ausgabe der multiplen linearen Regression für Excel , aber die in der Ausgabe angezeigten Zahlen sind typisch für die Regressionsausgabe, die Sie mit jeder Statistiksoftware sehen.

Aus den Modellergebnissen ermöglichen uns die Koeffizienten die Bildung eines geschätzten multiplen linearen Regressionsmodells:

Prüfungsergebnis = 67,67 + 5,56*(Stunden) – 0,60*(Vorbereitungsprüfungen)

Die Koeffizienten lassen sich wie folgt interpretieren:

- Jede zusätzliche Erhöhung der Lernstunden um eine Einheit ist mit einer durchschnittlichen Steigerung der Prüfungspunktzahl um 5,56 Punkte verbunden, vorausgesetzt, dass die Übungsprüfungen konstant bleiben.

- Jede weitere Erhöhung der absolvierten Vorbereitungsprüfungen um eine Einheit geht mit einem durchschnittlichen Rückgang der Prüfungspunktzahl um 0,60 Punkte einher, wenn man davon ausgeht, dass die Zahl der gelernten Stunden konstant bleibt.

Wir können dieses Modell auch verwenden, um die erwartete Prüfungsnote zu bestimmen, die ein Student basierend auf der Gesamtzahl der gelernten Stunden und der abgelegten Vorbereitungsprüfungen erhalten wird. Beispielsweise sollte ein Student, der 4 Stunden lernt und eine Vorbereitungsprüfung ablegt, eine Prüfungspunktzahl von 89,31 erreichen:

Prüfungsergebnis = 67,67 + 5,56*(4) -0,60*(1) = 89,31

So interpretieren Sie die restlichen Modellergebnisse:

- R-Quadrat: Dies wird als Bestimmtheitsmaß bezeichnet. Es ist der Anteil der Varianz der Antwortvariablen, der durch die erklärenden Variablen erklärt werden kann. In diesem Beispiel lassen sich 73,4 % der Abweichungen bei den Prüfungsergebnissen durch die Anzahl der gelernten Stunden und die Anzahl der abgelegten Vorbereitungsprüfungen erklären.

- Standardfehler: Dies ist der durchschnittliche Abstand zwischen den beobachteten Werten und der Regressionsgeraden. In diesem Beispiel weichen die beobachteten Werte im Durchschnitt um 5.366 Einheiten von der Regressionsgeraden ab.

- F: Dies ist die Gesamt-F-Statistik für das Regressionsmodell, berechnet als Regressions-MS/Rest-MS.

- F Bedeutung: Dies ist der p-Wert, der der gesamten F-Statistik zugeordnet ist. Dies sagt uns, ob das Regressionsmodell als Ganzes statistisch signifikant ist oder nicht. Mit anderen Worten sagt es uns, ob die beiden erklärenden Variablen zusammen einen statistisch signifikanten Zusammenhang mit der Antwortvariablen haben. In diesem Fall liegt der p-Wert unter 0,05, was darauf hindeutet, dass die erklärenden Variablen, gelernte Stunden und absolvierte Vorbereitungsprüfungen zusammengenommen einen statistisch signifikanten Zusammenhang mit dem Prüfungsergebnis haben.

- P-Werte des Koeffizienten. Einzelne p-Werte sagen uns, ob jede erklärende Variable statistisch signifikant ist oder nicht. Wir können sehen, dass die Anzahl der gelernten Stunden statistisch signifikant ist (p = 0,00), während die Anzahl der absolvierten Vorbereitungsprüfungen (p = 0,52) mit α = 0,05 statistisch nicht signifikant ist. Da frühere Vorbereitungsprüfungen statistisch nicht signifikant sind, entscheiden wir uns möglicherweise, sie aus dem Modell zu entfernen.

So bewerten Sie die Anpassung eines multiplen linearen Regressionsmodells

Um zu bewerten, wie gut ein multiples lineares Regressionsmodell zu einem Datensatz „passt“, werden üblicherweise zwei Zahlen verwendet:

1. R-Quadrat: Dies ist der Anteil der Varianz in der Antwortvariablen , der durch die Prädiktorvariablen erklärt werden kann.

Der R-Quadrat-Wert kann zwischen 0 und 1 liegen. Ein Wert von 0 gibt an, dass die Antwortvariable überhaupt nicht durch die Prädiktorvariable erklärt werden kann. Ein Wert von 1 gibt an, dass die Antwortvariable perfekt und fehlerfrei durch die Prädiktorvariable erklärt werden kann.

Je höher das R-Quadrat eines Modells ist, desto besser kann das Modell die Daten anpassen.

2. Standardfehler: Dies ist der durchschnittliche Abstand zwischen den beobachteten Werten und der Regressionsgeraden. Je kleiner der Standardfehler ist, desto besser kann ein Modell die Daten anpassen.

Wenn wir Vorhersagen mithilfe eines Regressionsmodells treffen möchten, ist der Standardfehler der Regression möglicherweise eine nützlichere Metrik als das R-Quadrat, da er uns eine Vorstellung davon gibt, wie genau unsere Vorhersagen in Einheiten sind.

Eine vollständige Erläuterung der Vor- und Nachteile der Verwendung des R-Quadrats gegenüber dem Standardfehler zur Bewertung der Modellanpassung finden Sie in den folgenden Artikeln:

Annahmen mehrerer linearer Regressionen

Bei der multiplen linearen Regression werden vier wichtige Annahmen zu den Daten getroffen:

1. Lineare Beziehung: Es besteht eine lineare Beziehung zwischen der unabhängigen Variablen x und der abhängigen Variablen y.

2. Unabhängigkeit: Die Residuen sind unabhängig. Insbesondere besteht keine Korrelation zwischen aufeinanderfolgenden Residuen in Zeitreihendaten.

3. Homoskedastizität: Die Residuen haben auf jeder Ebene von x eine konstante Varianz.

4. Normalität: Die Modellresiduen sind normalverteilt.

Eine vollständige Erklärung zum Testen dieser Hypothesen finden Sie in diesem Artikel .

Multiple lineare Regression mithilfe von Software

Die folgenden Tutorials bieten Schritt-für-Schritt-Beispiele zur Durchführung einer multiplen linearen Regression mit unterschiedlicher Statistiksoftware:

So führen Sie eine multiple lineare Regression in R durch

So führen Sie eine multiple lineare Regression in Python durch

So führen Sie eine multiple lineare Regression in Excel durch

So führen Sie eine multiple lineare Regression in SPSS durch

So führen Sie eine multiple lineare Regression in Stata durch

So führen Sie eine lineare Regression in Google Sheets durch