Analisi di regressione

Questo articolo spiega cos’è l’analisi di regressione e a cosa serve nelle statistiche. Inoltre, sarai in grado di vedere quali sono i diversi tipi di analisi di regressione.

Cos’è l’analisi di regressione?

In statistica, l’analisi di regressione è un processo in cui viene studiata la relazione tra due o più variabili. Più specificamente, l’analisi di regressione implica il calcolo di un’equazione che mette in relazione matematicamente le variabili nello studio.

Il modello costruito in un’analisi di regressione è chiamato modello di regressione, mentre l’equazione che mette in relazione le variabili studiate è chiamata equazione di regressione.

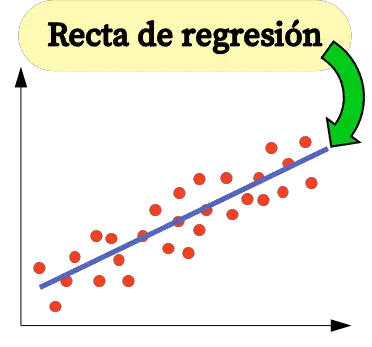

Ad esempio, se desideri studiare la relazione tra l’inflazione di un paese e il suo PIL, puoi eseguire un’analisi di regressione per analizzare la relazione tra le due variabili. In questo caso, l’equazione ottenuta dall’analisi di regressione sarebbe una retta di regressione.

Pertanto, un’analisi di regressione consiste nel raccogliere un campione di dati e, dai dati raccolti, viene calcolata un’equazione che consente di mettere in relazione matematicamente le variabili studiate.

Nelle analisi di regressione è importante distinguere tra i due tipi di variabili che possono essere incluse nel modello di regressione:

- Variabile dipendente (o variabile di risposta) : questo è il fattore che vogliamo analizzare, quindi verrà costruito un modello di regressione per vedere come varia il valore di questa variabile in base al valore di altre variabili.

- Variabile indipendente (o variabile esplicativa) : è un fattore che riteniamo possa influenzare la variabile che desideriamo analizzare. Cioè, il valore della variabile indipendente influenza il valore della variabile dipendente.

Tipi di analisi di regressione

Fondamentalmente esistono tre tipi di analisi di regressione :

- Analisi di regressione lineare semplice : il modello di regressione ha una variabile indipendente e una variabile dipendente e sono linearmente correlate.

- Analisi di regressione lineare multipla : due o più variabili indipendenti sono linearmente correlate a una variabile dipendente.

- Analisi di regressione non lineare : la relazione tra la variabile indipendente e la variabile dipendente è modellata utilizzando una funzione non lineare.

Analisi di regressione lineare semplice

La regressione lineare semplice viene utilizzata per mettere in relazione una variabile indipendente con entrambe le variabili utilizzando un’equazione lineare.

L’equazione di un modello di regressione lineare semplice è una retta, è quindi composta da due coefficienti: la costante dell’equazione (β 0 ) e il coefficiente di correlazione tra le due variabili (β 1 ). Pertanto, l’equazione per un modello di regressione lineare semplice è y=β 0 +β 1 x.

![]()

Le formule per il calcolo dei coefficienti della regressione lineare semplice sono le seguenti:

![Rendered by QuickLaTeX.com \begin{array}{c}\beta_1=\cfrac{\displaystyle \sum_{i=1}^n (x_i-\overline{x})(y_i-\overline{y})}{\displaystyle \sum_{i=1}^n (x_i-\overline{x})^2}\\[12ex]\beta_0=\overline{y}-\beta_1\overline{x}\end{array}](https://statorials.org/wp-content/ql-cache/quicklatex.com-459281504d26f92756115054ef567021_l3.png)

Oro:

-

è la costante della retta di regressione.

-

è la pendenza della retta di regressione.

-

è il valore della variabile indipendente X dei dati i.

-

è il valore della variabile dipendente Y dei dati i.

-

è la media dei valori della variabile indipendente

-

è la media dei valori della variabile dipendente Y.

Analisi di regressione lineare multipla

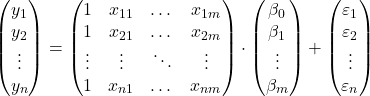

In un modello di regressione lineare multipla sono incluse almeno due variabili indipendenti. In altre parole, la regressione lineare multipla consente di collegare linearmente diverse variabili esplicative a una variabile di risposta. Pertanto, l’equazione per un modello di regressione lineare multipla è:

![]()

Oro:

-

è la variabile dipendente.

-

è la variabile indipendente i.

-

è la costante dell’equazione di regressione lineare multipla.

-

è il coefficiente di regressione associato alla variabile

.

-

è l’errore o residuo, cioè la differenza tra il valore osservato e il valore stimato dal modello.

-

è il numero totale di variabili nel modello.

Quindi, se abbiamo un campione con un totale di

![]()

osservazioni, possiamo porre il modello di regressione lineare multipla in forma matriciale:

L’espressione della matrice sopra può essere riscritta assegnando una lettera a ciascuna matrice:

![]()

Pertanto, applicando il criterio dei minimi quadrati, possiamo arrivare alla formula per stimare i coefficienti di un modello di regressione lineare multipla :

![]()

Tuttavia, l’applicazione di questa formula è molto laboriosa e richiede molto tempo, motivo per cui in pratica è consigliabile utilizzare un software per computer (come Minitab o Excel) che consente di creare un modello di regressione multipla molto più rapidamente.

Analisi di regressione non lineare

In statistica, la regressione non lineare è un tipo di regressione in cui una funzione non lineare viene utilizzata come modello dell’equazione di regressione. Pertanto, l’equazione di un modello di regressione non lineare è una funzione non lineare.

Logicamente, la regressione non lineare viene utilizzata per mettere in relazione la variabile indipendente con la variabile dipendente quando la relazione tra le due variabili non è lineare. Quindi, se rappresentando graficamente i dati del campione osserviamo che essi non hanno una relazione lineare, cioè non formano approssimativamente una linea retta, è meglio utilizzare un modello di regressione non lineare.

Ad esempio, l’equazione y=3-5x-8x 2 +x 3 è un modello di regressione non lineare perché mette in relazione matematicamente la variabile indipendente X con la variabile dipendente Y tramite una funzione cubica.

Esistono principalmente tre tipi di regressione non lineare :

- Regressione polinomiale – Regressione non lineare la cui equazione è sotto forma di polinomio.

- Regressione logaritmica – Regressione non lineare in cui la variabile indipendente è logaritmizzata.

- Regressione esponenziale – Regressione non lineare in cui la variabile indipendente risiede nell’esponente dell’equazione.

![]()

![]()

![]()

A cosa serve l’analisi di regressione?

L’analisi di regressione ha fondamentalmente due usi: l’analisi di regressione viene utilizzata per spiegare la relazione tra le variabili esplicative e la variabile di risposta e, analogamente, l’analisi di regressione viene utilizzata per prevedere il valore della variabile dipendente per una nuova osservazione.

Ottenendo l’equazione del modello di regressione, possiamo sapere che tipo di relazione esiste tra le variabili nel modello. Se il coefficiente di regressione di una variabile indipendente è positivo, la variabile dipendente aumenterà quando aumenta. mentre se il coefficiente di regressione di una variabile indipendente è negativo, la variabile dipendente diminuirà quando aumenta.

D’altro canto, l’equazione matematica ottenuta dall’analisi di regressione consente anche di fare previsioni di valore. Pertanto, introducendo i valori delle variabili esplicative nell’equazione del modello di regressione, possiamo calcolare il valore della variabile dipendente per un nuovo dato.