Come disegnare un albero decisionale in r (con esempio)

Nell’apprendimento automatico , un albero decisionale è un tipo di modello che utilizza un insieme di variabili predittive per creare un albero decisionale che predice il valore di una variabile di risposta.

Il modo più semplice per tracciare un albero decisionale in R è utilizzare la funzione prp() dal pacchetto rpart.plot .

L’esempio seguente mostra come utilizzare questa funzione nella pratica.

Esempio: disegnare un albero decisionale in R

Per questo esempio utilizzeremo il set di dati Hitters del pacchetto ISLR , che contiene varie informazioni su 263 giocatori di baseball professionisti.

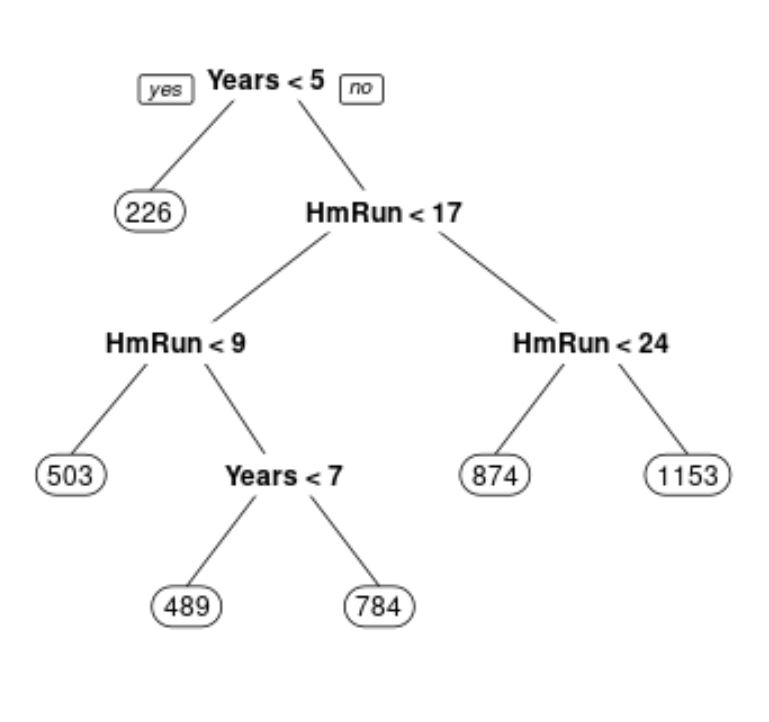

Utilizzeremo questo set di dati per costruire un albero di regressione che utilizza i fuoricampo e gli anni giocati per prevedere lo stipendio di un determinato giocatore.

Il codice seguente mostra come adattare questo albero di regressione e come utilizzare la funzione prp() per disegnare l’albero:

library (ISLR) library (rpart) library (rpart.plot) #build the initial decision tree tree <- rpart(Salary ~ Years + HmRun, data=Hitters, control=rpart. control (cp= .0001 )) #identify best cp value to use best <- tree$cptable[which. min (tree$cptable[," xerror "])," CP "] #produce a pruned tree based on the best cp value pruned_tree <- prune (tree, cp=best) #plot the pruned tree prp(pruned_tree)

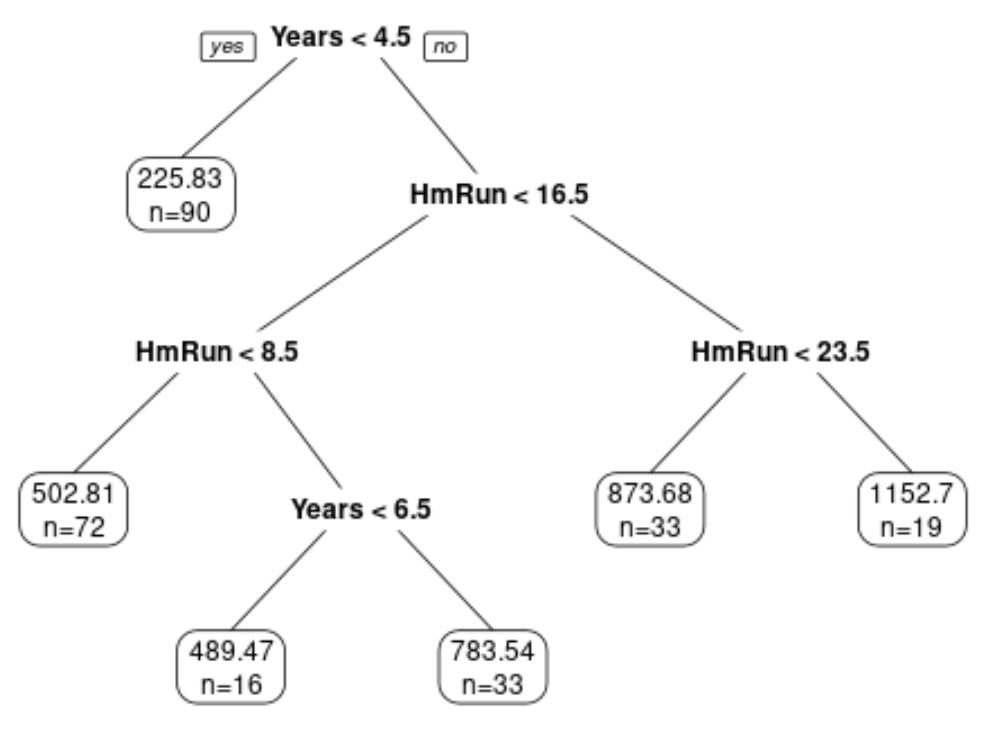

Tieni presente che possiamo anche personalizzare l’aspetto dell’albero decisionale utilizzando gli argomenti faclen , extra , roundint e digits nella funzione prp ():

#plot decision tree using custom arguments

prp(pruned_tree,

faclen= 0 , #use full names for factor labels

extra= 1 , #display number of observations for each terminal node

roundint= F , #don't round to integers in output

digits= 5 ) #display 5 decimal places in output

Possiamo vedere che l’albero ha sei nodi terminali.

Ciascun nodo terminale mostra lo stipendio previsto dei giocatori in quel nodo nonché il numero di osservazioni del set di dati originale che appartengono a quella valutazione.

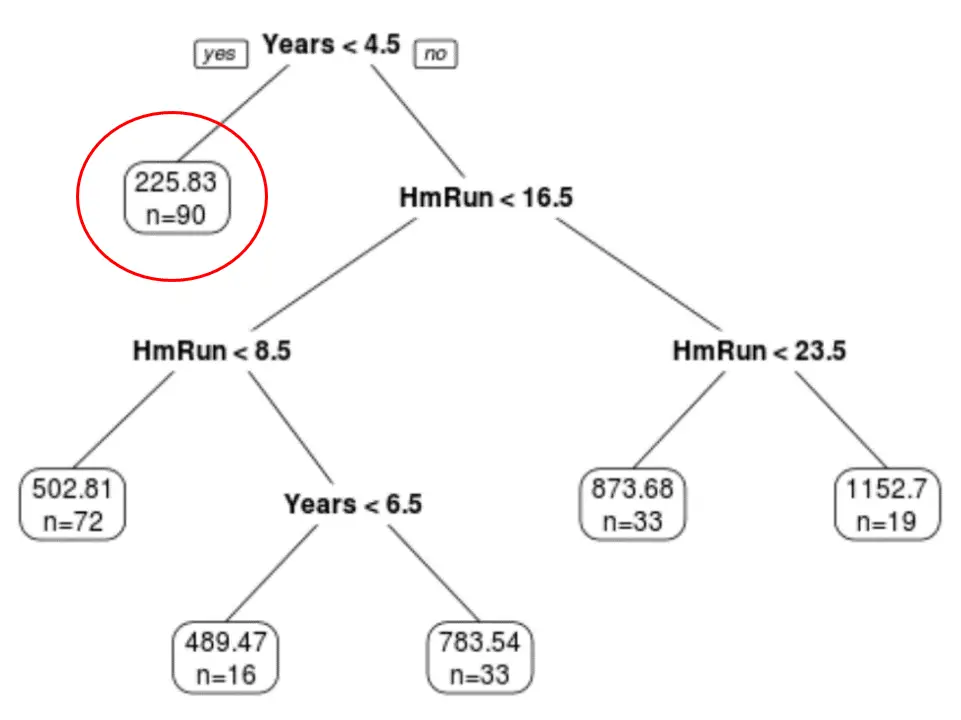

Ad esempio, possiamo vedere che nel set di dati originale c’erano 90 giocatori con meno di 4,5 anni di esperienza e il loro stipendio medio era di $ 225,83.000 .

Possiamo anche utilizzare l’albero per prevedere lo stipendio di un determinato giocatore in base ai suoi anni di esperienza e ai fuoricampo medi.

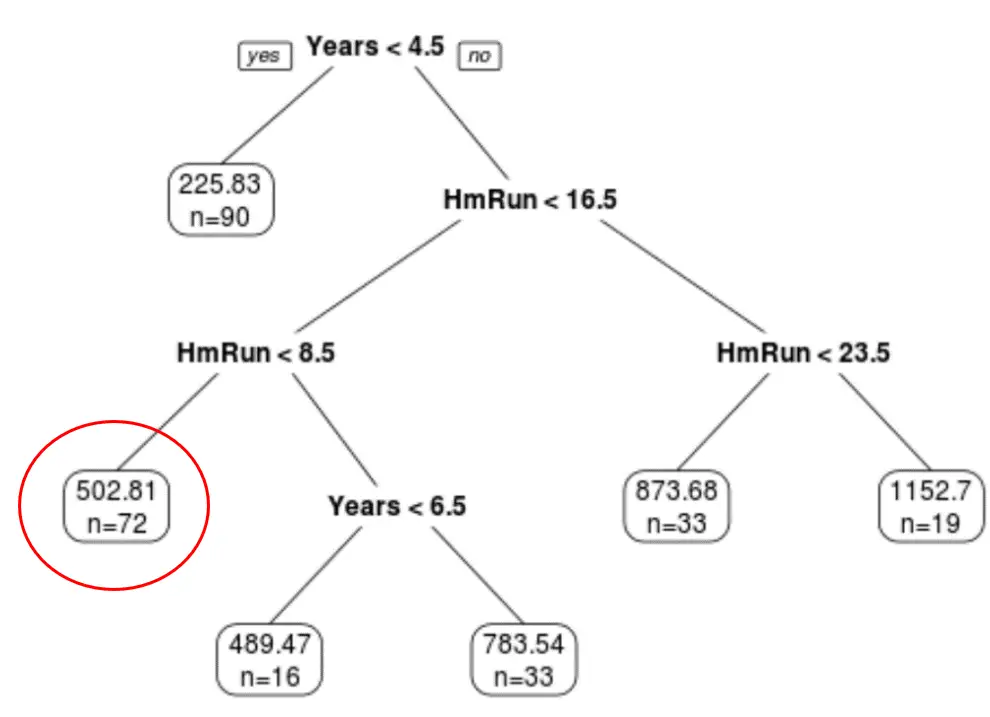

Ad esempio, un giocatore che ha 7 anni di esperienza e 4 fuoricampo in media ha uno stipendio previsto di $ 502,81k .

Questo è uno dei vantaggi dell’utilizzo di un albero decisionale: possiamo facilmente visualizzare e interpretare i risultati.

Risorse addizionali

Le seguenti esercitazioni forniscono informazioni aggiuntive sugli alberi decisionali:

Un’introduzione alla classificazione e agli alberi di regressione

Albero decisionale vs foreste casuali: qual è la differenza?

Come adattare gli alberi di classificazione e regressione in R