Introduzione alla regressione lineare multipla

Quando vogliamo comprendere la relazione tra una singola variabile predittrice e una variabile di risposta, spesso utilizziamo la regressione lineare semplice .

Tuttavia, se vogliamo comprendere la relazione tra più variabili predittive e una variabile di risposta, possiamo utilizzare la regressione lineare multipla .

Se abbiamo p variabili predittive, allora un modello di regressione lineare multipla assume la forma:

Y = β 0 + β 1 X 1 + β 2 X 2 + … + β p

Oro:

- Y : la variabile di risposta

- X j : la j- esima variabile predittiva

- β j : L’effetto medio su Y di un aumento di un’unità in X j , mantenendo fissi tutti gli altri predittori

- ε : Il termine di errore

I valori di β 0 , β 1 , B 2 , …, β p vengono scelti utilizzando il metodo dei minimi quadrati , che minimizza la somma dei quadrati dei residui (RSS):

RSS = Σ(y i – ŷ i ) 2

Oro:

- Σ : simbolo greco che significa somma

- y i : il valore di risposta effettivo per l’ i-esima osservazione

- ŷ i : il valore di risposta previsto basato sul modello di regressione lineare multipla

Il metodo utilizzato per trovare queste stime dei coefficienti è collegato all’algebra delle matrici e non entreremo nei dettagli qui. Fortunatamente, qualsiasi software statistico può calcolare questi coefficienti per te.

Come interpretare l’output della regressione lineare multipla

Supponiamo di adattare un modello di regressione lineare multipla utilizzando le variabili predittive , le ore studiate e gli esami preparatori sostenuti , nonché un punteggio dell’esame variabile di risposta.

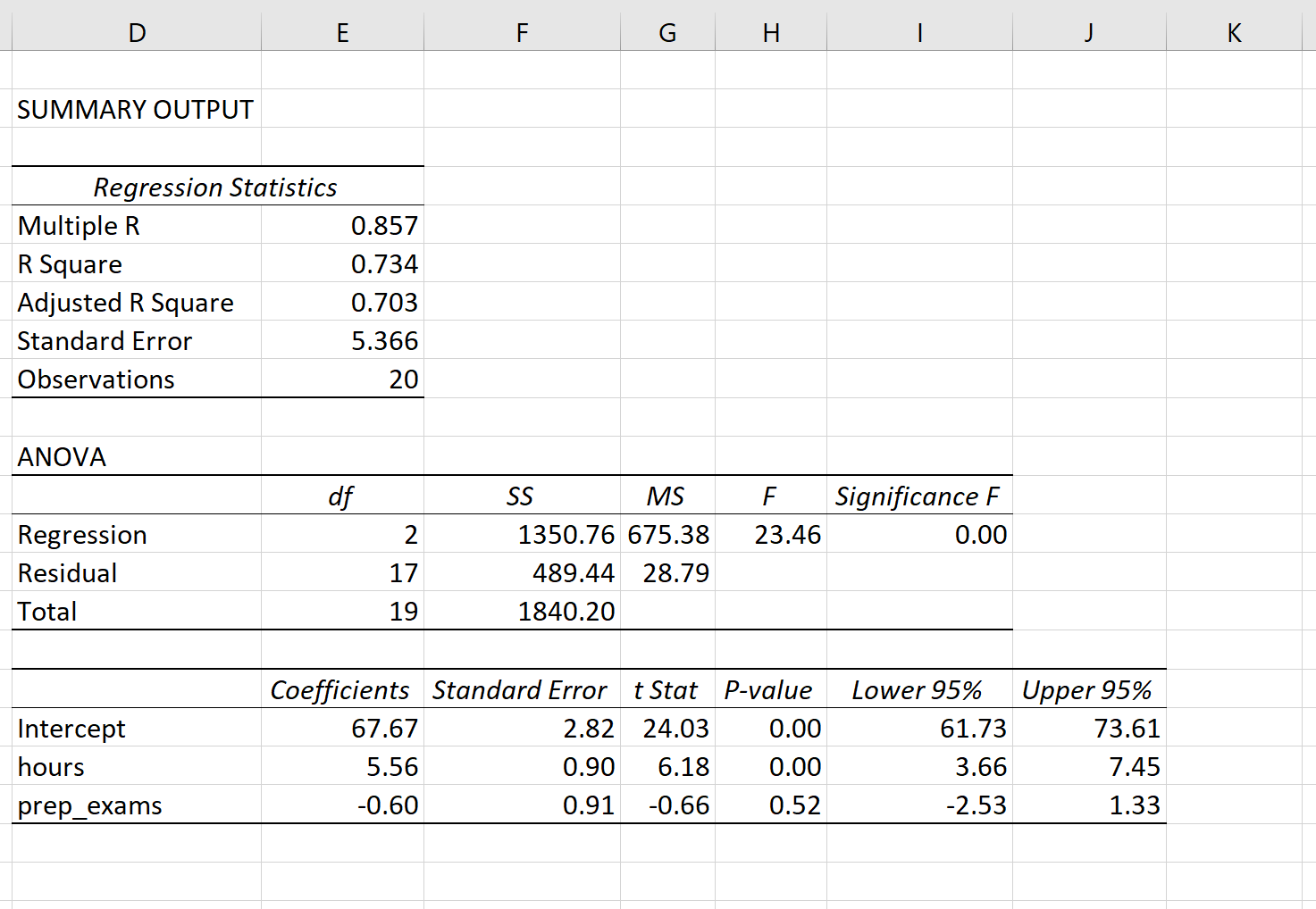

Lo screenshot seguente mostra come potrebbe apparire il risultato della regressione lineare multipla per questo modello:

Nota: lo screenshot seguente mostra l’output della regressione lineare multipla per Excel , ma i numeri mostrati nell’output sono tipici dell’output della regressione che vedrai utilizzando qualsiasi software statistico.

Dai risultati del modello, i coefficienti ci permettono di formare un modello di regressione lineare multipla stimato:

Punteggio esame = 67,67 + 5,56*(ore) – 0,60*(esami preparatori)

Il modo di interpretare i coefficienti è il seguente:

- Ogni ulteriore aumento di un’unità nelle ore studiate è associato a un aumento medio di 5,56 punti nel punteggio dell’esame, assumendo che gli esami pratici rimangano costanti.

- Ad ogni ulteriore incremento di un’unità degli esami preparatori sostenuti è associato un decremento medio del punteggio dell’esame di 0,60 punti, assumendo che il numero di ore studiate rimanga costante.

Possiamo anche utilizzare questo modello per determinare il voto previsto per l’esame che uno studente riceverà in base al numero totale di ore studiate e agli esami preparatori sostenuti. Ad esempio, uno studente che studia per 4 ore e sostiene 1 esame preparatorio dovrebbe ottenere un punteggio dell’esame di 89,31 :

Punteggio dell’esame = 67,67 + 5,56*(4) -0,60*(1) = 89,31

Ecco come interpretare il resto dei risultati del modello:

- R-quadrato: questo è chiamato coefficiente di determinazione. È la proporzione della varianza della variabile di risposta che può essere spiegata dalle variabili esplicative. In questo esempio, il 73,4% della variazione dei punteggi degli esami è spiegata dal numero di ore studiate e dal numero di esami preparatori sostenuti.

- Errore standard: è la distanza media tra i valori osservati e la retta di regressione. In questo esempio i valori osservati si discostano in media di 5.366 unità dalla retta di regressione.

- F: questa è la statistica F complessiva per il modello di regressione, calcolata come MS di regressione/MS residua.

- Significato F: questo è il valore p associato alla statistica F complessiva. Questo ci dice se il modello di regressione nel suo insieme è statisticamente significativo o meno. In altre parole, ci dice se le due variabili esplicative combinate hanno un’associazione statisticamente significativa con la variabile di risposta. In questo caso, il valore p è inferiore a 0,05, indicando che le variabili esplicative, le ore studiate e gli esami preparatori sostenuti combinati, hanno un’associazione statisticamente significativa con il risultato dell’esame.

- Valori P del coefficiente. I valori p individuali ci dicono se ciascuna variabile esplicativa è statisticamente significativa o meno. Possiamo vedere che le ore studiate sono statisticamente significative (p = 0,00) mentre gli esami preparatori sostenuti (p = 0,52) non sono statisticamente significativi con α = 0,05. Poiché gli esami preparatori passati non sono statisticamente significativi, potremmo decidere di rimuoverli dal modello.

Come valutare l’adattamento di un modello di regressione lineare multipla

Due numeri vengono comunemente utilizzati per valutare quanto bene un modello di regressione lineare multipla “si adatta” a un set di dati:

1. R quadrato: questa è la proporzione della varianza nella variabile di risposta che può essere spiegata dalle variabili predittive.

Il valore R quadrato può variare da 0 a 1. Un valore pari a 0 indica che la variabile di risposta non può essere spiegata affatto dalla variabile predittore. Un valore pari a 1 indica che la variabile di risposta può essere spiegata perfettamente senza errori dalla variabile predittore.

Più alto è il quadrato R di un modello, migliore sarà la capacità del modello di adattare i dati.

2. Errore standard: è la distanza media tra i valori osservati e la retta di regressione. Più piccolo è l’errore standard, migliore è la capacità del modello di adattare i dati.

Se vogliamo fare previsioni utilizzando un modello di regressione, l’errore standard della regressione può essere una metrica più utile da conoscere rispetto all’R quadrato, perché ci dà un’idea di quanto siano accurate le nostre previsioni in termini di unità.

Per una spiegazione completa dei pro e dei contro dell’utilizzo dell’R quadrato rispetto all’errore standard per valutare l’adattamento del modello, vedere i seguenti articoli:

Ipotesi di regressione lineare multipla

La regressione lineare multipla fa quattro ipotesi chiave sui dati:

1. Relazione lineare: esiste una relazione lineare tra la variabile indipendente, x, e la variabile dipendente, y.

2. Indipendenza: i residui sono indipendenti. In particolare, non esiste alcuna correlazione tra i residui consecutivi nei dati delle serie temporali.

3. Omoschedasticità: i residui hanno una varianza costante ad ogni livello di x.

4. Normalità: i residui del modello sono distribuiti normalmente.

Per una spiegazione completa su come verificare queste ipotesi, vedere questo articolo .

Regressione lineare multipla tramite software

I seguenti tutorial forniscono esempi passo passo su come eseguire una regressione lineare multipla utilizzando diversi software statistici:

Come eseguire la regressione lineare multipla in R

Come eseguire regressioni lineari multiple in Python

Come eseguire una regressione lineare multipla in Excel

Come eseguire la regressione lineare multipla in SPSS

Come eseguire la regressione lineare multipla in Stata

Come eseguire la regressione lineare in Fogli Google