線形回帰

この記事では、線形回帰とは何か、統計で何に使用されるかについて説明します。さらに、2 種類の線形回帰 (単純線形回帰と多重線形回帰) がどのように計算されるかを確認できます。

線形回帰とは何ですか?

線形回帰は、1 つ以上の独立変数を従属変数に関連付ける統計モデルです。簡単に言えば、線形回帰は、1 つ以上の説明変数と応答変数の間の関係を近似する方程式を見つけるために使用される手法です。

たとえば、方程式 y=2+5x 1 -3x 2 +8x 3は、3 つの独立変数 (x 1 、 x 2 、 x 3 ) を従属変数 (y) に数学的に関連付けており、さらに、変数間の関係は線形です。

線形回帰の種類

線形回帰には 2 つのタイプがあります。

- 単純線形回帰: 単一の独立変数が従属変数にリンクされます。したがって、このタイプの線形回帰モデルの方程式は、y=β 0 +β 1 x 1の形式になります。

- 多重線形回帰: 回帰モデルには、いくつかの説明変数と 1 つの応答変数があります。したがって、このタイプの線形回帰モデルの方程式は、y=β 0 +β 1 x 1 +β 2 x 2 …+β m x mの形式になります。

単純な線形回帰

単純な線形回帰を使用して、1 つの独立変数を両方の変数に関連付けます。

単純な線形回帰モデルの方程式は直線であるため、方程式の定数 (β 0 ) と 2 つの変数間の相関係数 (β 1 ) の 2 つの係数で構成されます。したがって、単純な線形回帰モデルの方程式は y=β 0 +β 1 x となります。

![]()

単回帰係数の計算式は次のとおりです。

![Rendered by QuickLaTeX.com \begin{array}{c}\beta_1=\cfrac{\displaystyle \sum_{i=1}^n (x_i-\overline{x})(y_i-\overline{y})}{\displaystyle \sum_{i=1}^n (x_i-\overline{x})^2}\\[12ex]\beta_0=\overline{y}-\beta_1\overline{x}\end{array}](https://statorials.org/wp-content/ql-cache/quicklatex.com-459281504d26f92756115054ef567021_l3.png)

金:

-

回帰直線の定数です。

-

は回帰直線の傾きです。

-

データ i の独立変数 X の値です。

-

データ i の従属変数 Y の値です。

-

独立変数の値の平均です

-

従属変数 Y の値の平均です。

多重線形回帰

重線形回帰モデルには、少なくとも 2 つの独立変数が含まれます。言い換えれば、重線形回帰では、いくつかの説明変数を応答変数に線形にリンクさせることができます。

重線形回帰モデルの方程式は、y=β 0 +β 1 x 1 +β 2 x 2 +…+β m x m +εです。

![]()

金:

-

は従属変数です。

-

は独立変数 i です。

-

重回帰式の定数です。

-

変数に関連付けられた回帰係数です

。

-

誤差または残差、つまり観測値とモデルによって推定された値の差です。

-

はモデル内の変数の総数です。

したがって、合計が含まれるサンプルがある場合、

![]()

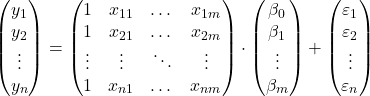

観察結果を基に、行列形式で重線形回帰モデルを立てることができます。

上記の行列式は、各行列に文字を割り当てることで書き換えることができます。

![]()

したがって、最小二乗基準を適用すると、重線形回帰モデルの係数を推定するための式に到達できます。

![]()

ただし、この公式の適用は非常に手間と時間がかかるため、実際には、重回帰モデルをより迅速に作成できるコンピューター ソフトウェア (Minitab や Excel など) を使用することをお勧めします。

線形回帰の仮定

線形回帰モデルでは、モデルが有効であるためには次の条件が満たされる必要があります。

- 独立性: 残基は互いに独立していなければなりません。モデルの独立性を確保する一般的な方法は、サンプリング プロセスにランダム性を追加することです。

- 等分散性: 残差の分散には均一性がなければなりません。つまり、残差の変動性は一定でなければなりません。

- 非多重共線性: モデルに含まれる説明変数は相互にリンクできないか、少なくともそれらの関係は非常に弱い必要があります。

- 正規性: 残差は正規分布する必要があります。つまり、残差は平均 0 の正規分布に従う必要があります。

- 線形性: 応答変数と説明変数の間の関係は線形であると仮定されます。

線形回帰は何に使用されますか?

線形回帰には基本的に 2 つの用途があります。線形回帰は説明変数と応答変数の関係を説明するために使用され、同様に、線形回帰は新しい観測値の従属変数の値を予測するために使用されます。

線形回帰モデルの方程式を求めることで、モデル内の変数間にどのような関係が存在するかを知ることができます。独立変数の回帰係数が正の場合、従属変数が増加すると従属変数も増加します。一方、独立変数の回帰係数が負の場合、従属変数は増加すると減少します。

一方、線形回帰で計算された方程式を使用すると、値を予測することもできます。したがって、説明変数の値をモデル方程式に導入することで、新しいデータの従属変数の値を計算できます。