머신러닝 강화에 대한 간단한 소개

대부분 의 지도 기계 학습 알고리즘은 선형 회귀 , 로지스틱 회귀 , 능선 회귀 등과 같은 단일 예측 모델 사용을 기반으로 합니다.

그러나 배깅 및 랜덤 포레스트 와 같은 방법은 원본 데이터세트의 반복적인 부트스트랩 샘플을 기반으로 다양한 모델을 구축합니다. 새로운 데이터에 대한 예측은 개별 모델의 예측을 평균하여 이루어집니다.

이러한 방법은 다음 프로세스를 사용하기 때문에 단일 예측 모델만 사용하는 방법에 비해 예측 정확도가 향상되는 경향이 있습니다.

- 먼저, 분산은 높고 편향은 낮은 개별 모델을 구축합니다(예: 깊게 성장한 의사결정 트리 ).

- 그런 다음 개별 모델의 예측을 평균화하여 분산을 줄입니다.

예측 정확도를 더욱 크게 향상시키는 또 다른 방법은 부스팅(boosting) 이라고 알려져 있습니다.

부스팅이란 무엇입니까?

부스팅은 모든 유형의 모델에 사용할 수 있는 방법이지만 의사결정 트리에 가장 자주 사용됩니다.

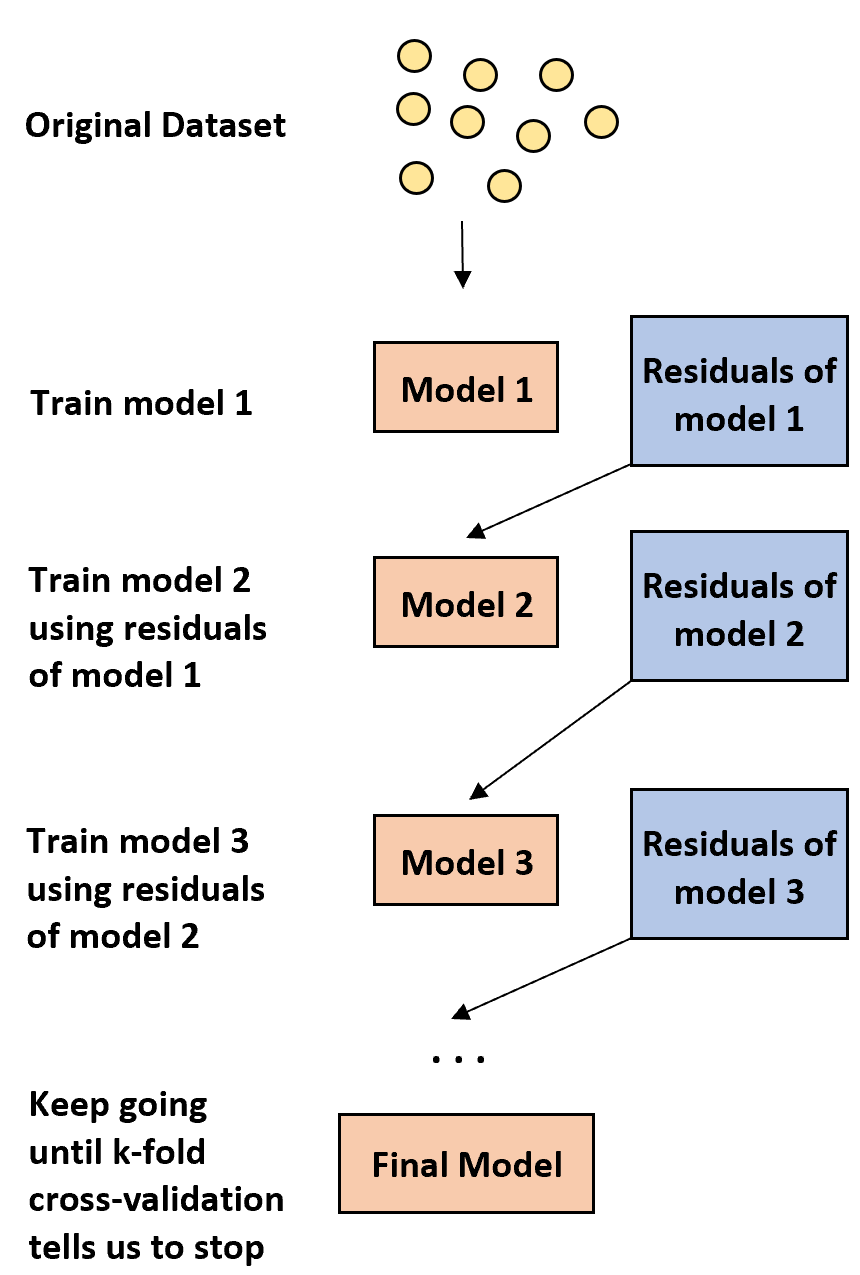

부스팅의 아이디어는 간단합니다.

1. 먼저 약한 모델을 구축합니다.

- “약한” 모델은 오류율이 무작위 추정보다 약간 더 나은 모델입니다.

- 실제로 이는 일반적으로 하나 또는 두 개의 구분만 있는 의사결정 트리입니다.

2. 다음으로, 이전 모델의 잔차를 기반으로 또 다른 약한 모델을 구축합니다.

- 실제로 우리는 이전 모델의 잔차(즉, 예측의 오류)를 사용하여 전체 오류율을 약간 향상시키는 새 모델을 맞춥니다.

3. k-겹 교차 검증이 중지하라는 메시지를 표시할 때까지 이 프로세스를 계속합니다.

- 실제로 우리는 k-겹 교차 검증을 사용하여 부스트 모델 개발을 중단해야 하는 시기를 식별합니다.

이 방법을 사용하면 약한 모델로 시작하여 예측 정확도가 높은 최종 모델을 얻을 때까지 이전 트리의 성능을 향상시키는 새로운 트리를 순차적으로 구축하여 성능을 계속 “개선”할 수 있습니다.

부스팅이 작동하는 이유는 무엇입니까?

부스팅은 모든 기계 학습에서 가장 강력한 모델을 생성할 수 있는 것으로 나타났습니다.

많은 산업에서 부스트 모델은 다른 모든 모델보다 성능이 뛰어난 경향이 있기 때문에 프로덕션에서 참조 모델로 사용됩니다.

Boosted 템플릿이 잘 작동하는 이유는 다음과 같은 간단한 아이디어를 이해하는 데 있습니다.

1. 첫째, 개선된 모델은 예측 정확도가 낮은 약한 의사결정 트리를 구성합니다. 이 의사결정 트리는 낮은 분산과 높은 편향을 갖는다고 합니다.

2. 개선된 모델은 이전 의사결정 트리의 순차적 개선 프로세스를 따르므로 전체 모델은 분산을 크게 늘리지 않고 각 단계에서 편향을 천천히 줄일 수 있습니다.

3. 최종 적합 모델은 편향 과 분산이 충분히 낮은 경향이 있어 새로운 데이터에 대해 낮은 테스트 오류율을 생성할 수 있는 모델이 됩니다.

부스팅의 장점과 단점

부스팅의 확실한 장점은 거의 모든 유형의 모델에 비해 예측 정확도가 높은 모델을 생성할 수 있다는 것입니다.

잠재적인 단점은 적합하고 개선된 모델을 해석하기가 매우 어렵다는 것입니다. 새로운 데이터의 반응값을 예측하는 엄청난 능력을 제공할 수 있지만 이를 달성하기 위해 사용하는 정확한 프로세스를 설명하기는 어렵습니다.

실제로 대부분의 데이터 과학자와 기계 학습 실무자는 새로운 데이터의 응답 값을 정확하게 예측할 수 있기를 원하기 때문에 향상된 모델을 만듭니다. 따라서 개선된 모델을 해석하기 어렵다는 사실은 일반적으로 문제가 되지 않습니다.

실제로 부스터

실제로 다음을 포함하여 부스팅에 사용되는 다양한 유형의 알고리즘이 있습니다.

데이터 세트의 크기와 컴퓨터의 처리 능력에 따라 이러한 방법 중 하나가 다른 방법보다 더 나을 수 있습니다.