Wat is de aanname van gelijke variantie in de statistiek?

Veel statistische tests gaan uit van een gelijke variantie . Als deze veronderstelling niet wordt gerespecteerd, worden de testresultaten onbetrouwbaar.

De meest voorkomende statistische tests en procedures die deze aanname van gelijke variantie maken, zijn onder meer:

1. ANOVA

2. t-toetsen

3. Lineaire regressie

In deze tutorial wordt uitgelegd welke aanname voor elke test is gemaakt, hoe u kunt bepalen of aan deze aanname is voldaan en wat u moet doen als deze niet wordt nageleefd.

Aanname van gelijkheid van variantie in ANOVA

Een ANOVA (“Analysis of Variance”) wordt gebruikt om te bepalen of er al dan niet een significant verschil is tussen de gemiddelden van drie of meer onafhankelijke groepen.

Hier is een voorbeeld van wanneer we een ANOVA zouden kunnen gebruiken:

Laten we zeggen dat we 90 mensen rekruteren om deel te nemen aan een experiment voor gewichtsverlies. We wijzen willekeurig 30 mensen toe om programma A, B of C een maand lang te gebruiken.

Om te zien of het programma impact heeft op gewichtsverlies, kunnen we een one-way ANOVA uitvoeren.

Een ANOVA gaat ervan uit dat elk van de groepen een gelijke variantie heeft. Er zijn twee manieren om te testen of deze hypothese waar is:

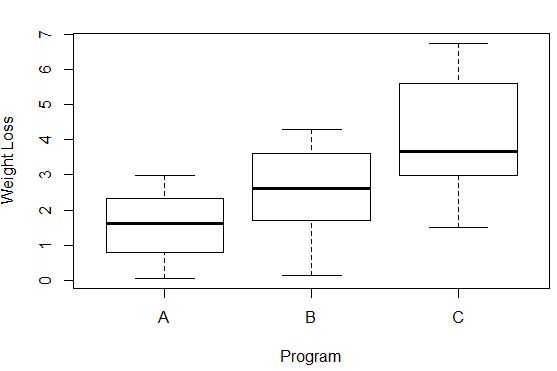

1. Maak boxplots.

Boxplots bieden een visuele manier om de aanname van gelijkheid van varianties te verifiëren.

De variantie in gewichtsverlies in elke groep kan worden waargenomen aan de hand van de lengte van elke boxplot. Hoe langer het vakje, hoe hoger de variantie. We kunnen bijvoorbeeld zien dat de variantie iets hoger is voor deelnemers aan Programma C vergeleken met Programma A en Programma B.

2. Voer de Bartlett-test uit.

De Bartlett-test test de nulhypothese dat de steekproeven gelijke varianties hebben, tegenover de alternatieve hypothese dat de steekproeven geen gelijke varianties hebben.

Als de p-waarde van de test onder een bepaald significantieniveau ligt (zoals 0,05), dan hebben we bewijs dat de steekproeven niet allemaal gelijke varianties hebben.

Wat gebeurt er als niet aan de aanname van gelijke variantie wordt voldaan?

Over het algemeen worden ANOVA’s als redelijk robuust beschouwd tegen schendingen van de aanname van gelijke varianties, zolang elke groep dezelfde steekproefomvang heeft.

Als de steekproefomvang echter niet hetzelfde is en deze aanname ernstig wordt geschonden, kunt u in plaats daarvan een Kruskal-Wallis-test uitvoeren, de niet-parametrische versie van eenrichtings-ANOVA.

Aanname van gelijke variantie in t-toetsen

Een t-test met twee steekproeven wordt gebruikt om te testen of de gemiddelden van twee populaties gelijk zijn of niet.

Bij de test wordt ervan uitgegaan dat de varianties tussen de twee groepen gelijk zijn. Er zijn twee manieren om te testen of deze hypothese waar is:

1. Gebruik de verhoudingsregel.

Als de verhouding tussen de grootste variantie en de kleinste variantie kleiner is dan 4, kunnen we over het algemeen aannemen dat de varianties ongeveer gelijk zijn en de t-test met twee steekproeven gebruiken.

Stel bijvoorbeeld dat monster 1 een variantie van 24,5 heeft en monster 2 een variantie van 15,2. De verhouding tussen de grootste steekproefvariantie en de kleinste steekproefvariantie zou als volgt worden berekend: 24,5 / 15,2 = 1,61.

Omdat deze verhouding kleiner is dan 4, zou men kunnen aannemen dat de verschillen tussen de twee groepen ongeveer gelijk zijn.

2. Voer een F-test uit.

De F-test toetst de nulhypothese dat de steekproeven gelijke varianties hebben, tegenover de alternatieve hypothese dat de steekproeven geen gelijke varianties hebben.

Als de p-waarde van de test onder een bepaald significantieniveau ligt (zoals 0,05), dan hebben we bewijs dat de steekproeven niet allemaal gelijke varianties hebben.

Wat gebeurt er als niet aan de aanname van gelijke variantie wordt voldaan?

Als deze aanname wordt geschonden, kunnen we de t-test van Welch uitvoeren, wat een niet-parametrische versie is van de t-test met twee steekproeven en er niet van uitgaat dat de twee steekproeven gelijke varianties hebben.

Aanname van gelijke variantie bij lineaire regressie

Lineaire regressie wordt gebruikt om de relatie tussen een of meer voorspellende variabelen en een responsvariabele te kwantificeren.

Bij lineaire regressie wordt ervan uitgegaan dat de residuen een constante variantie hebben op elk niveau van de voorspellende variabele(n). Dit heet homoscedasticiteit . Wanneer dit niet het geval is, lijden de residuen aan heteroskedasticiteit en worden de resultaten van de regressieanalyse onbetrouwbaar.

De meest gebruikelijke manier om te bepalen of aan deze aanname wordt voldaan, is door een grafiek te maken van de residuen versus de aangepaste waarden. Als de residuen in deze grafiek willekeurig rond nul verspreid lijken te zijn, wordt waarschijnlijk voldaan aan de aanname van homoscedasticiteit.

Als er echter een systematische trend in de residuen zit, zoals de „kegelvorm“ in de volgende grafiek, dan is heteroskedasticiteit een probleem:

Wat gebeurt er als niet aan de aanname van gelijke variantie wordt voldaan?

Als deze aanname wordt geschonden, is de meest gebruikelijke manier om het probleem op te lossen het transformeren van de responsvariabele met behulp van een van de volgende drie transformaties:

1. Logtransformatie: transformeer de responsvariabele van y naar log(y) .

2. Vierkantsworteltransformatie: Transformeer de responsvariabele van y naar √y .

3. Derdemachtsworteltransformatie: transformeer de responsvariabele van y naar y 1/3 .

Door deze transformaties uit te voeren verdwijnt het probleem van heteroskedasticiteit doorgaans.

Een andere manier om te corrigeren voor heteroskedasticiteit is het gebruikvan gewogen kleinste kwadratenregressie . Dit type regressie kent een gewicht toe aan elk gegevenspunt op basis van de variantie van de aangepaste waarde.

In wezen geeft dit een laag gewicht aan datapunten met grotere varianties, waardoor hun resterende kwadraten kleiner worden. Wanneer de juiste gewichten worden gebruikt, kan dit het probleem van heteroskedasticiteit elimineren.

Aanvullende bronnen

De drie hypothesen geformuleerd in een ANOVA

De vier hypothesen geformuleerd in een T-test

De vier aannames van lineaire regressie