De vier aannames van lineaire regressie

Lineaire regressie is een nuttige statistische methode die we kunnen gebruiken om de relatie tussen twee variabelen, x en y, te begrijpen. Voordat we echter een lineaire regressie uitvoeren, moeten we er eerst voor zorgen dat aan vier aannames wordt voldaan:

1. Lineaire relatie: Er bestaat een lineaire relatie tussen de onafhankelijke variabele, x, en de afhankelijke variabele, y.

2. Onafhankelijkheid: De residuen zijn onafhankelijk. In het bijzonder is er geen correlatie tussen opeenvolgende residuen in tijdreeksgegevens.

3. Homoscedasticiteit: de residuen hebben een constante variantie op elk niveau van x.

4. Normaliteit: De modelresiduen zijn normaal verdeeld.

Als aan een of meer van deze aannames niet wordt voldaan, kunnen de resultaten van onze lineaire regressie onbetrouwbaar of zelfs misleidend zijn.

In dit artikel geven we een uitleg voor elke aanname, hoe je kunt bepalen of aan de aanname wordt voldaan en wat je moet doen als niet aan de aanname wordt voldaan.

Hypothese 1: Lineair verband

Uitleg

De eerste aanname van lineaire regressie is dat er een lineair verband bestaat tussen de onafhankelijke variabele x en de onafhankelijke variabele y.

Hoe te bepalen of aan deze veronderstelling wordt voldaan

De eenvoudigste manier om te detecteren of aan deze veronderstelling is voldaan, is door een spreidingsdiagram van x versus y te maken. Hiermee kunt u visueel zien of er een lineair verband bestaat tussen de twee variabelen. Als blijkt dat de punten op de grafiek langs een rechte lijn zouden kunnen liggen, dan is er een soort lineair verband tussen de twee variabelen en wordt aan deze veronderstelling voldaan.

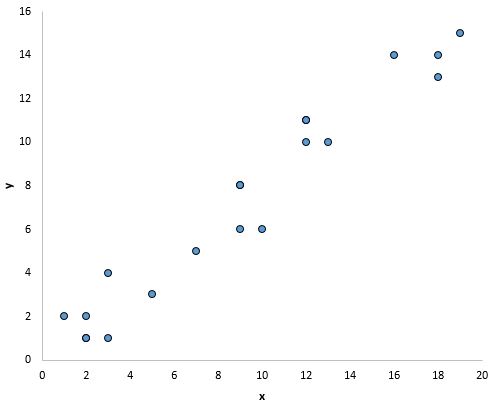

De punten in de onderstaande grafiek lijken bijvoorbeeld op een rechte lijn te vallen, wat aangeeft dat er een lineair verband bestaat tussen x en y:

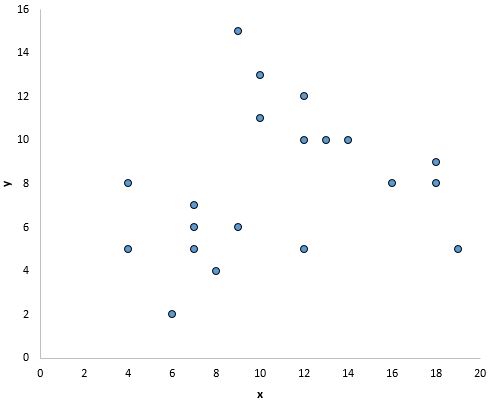

Er lijkt echter geen lineair verband te bestaan tussen x en y in de onderstaande grafiek:

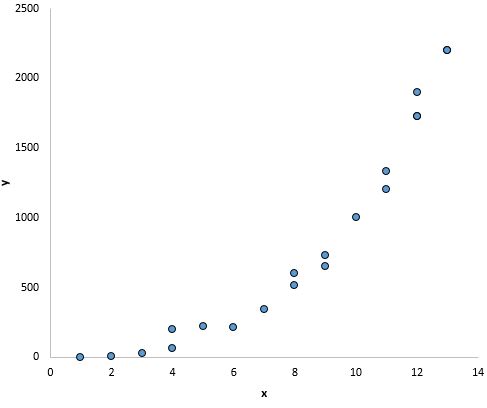

En in deze grafiek lijkt er een duidelijk verband te bestaan tussen x en y, maar geen lineair verband :

Wat te doen als deze veronderstelling niet wordt gerespecteerd

Als u een spreidingsdiagram van waarden voor x en y maakt en ontdekt dat er geen lineair verband bestaat tussen de twee variabelen, heeft u verschillende opties:

1. Pas een niet-lineaire transformatie toe op de onafhankelijke en/of afhankelijke variabele. Veelvoorkomende voorbeelden zijn onder meer het nemen van de logaritmische wortel, de wortel of het omgekeerde van de onafhankelijke en/of afhankelijke variabele.

2. Voeg nog een onafhankelijke variabele toe aan het model. Als de grafiek van x versus y bijvoorbeeld een parabolische vorm heeft, kan het zinvol zijn om X 2 als extra onafhankelijke variabele in het model toe te voegen.

Hypothese 2: Onafhankelijkheid

Uitleg

De volgende aanname van lineaire regressie is dat de residuen onafhankelijk zijn. Dit is vooral relevant bij het werken met tijdreeksgegevens. Idealiter willen we niet dat er een trend ontstaat tussen opeenvolgende residuen. De residuen mogen bijvoorbeeld niet voortdurend in de loop van de tijd toenemen.

Hoe te bepalen of aan deze veronderstelling wordt voldaan

De eenvoudigste manier om te testen of deze aanname klopt, is door te kijken naar een tijdreeksgrafiek van residuen, een grafiek van residuen versus tijd. Idealiter zouden de meeste resterende autocorrelaties binnen de 95%-betrouwbaarheidsbanden rond nul moeten vallen, die ongeveer +/- 2 op de vierkantswortel van n liggen, waarbij n de steekproefomvang is. Je kunt ook formeel testen of aan deze veronderstelling wordt voldaan met behulp van de Durbin-Watson-test .

Wat te doen als deze veronderstelling niet wordt gerespecteerd

Afhankelijk van hoe deze veronderstelling wordt geschonden, hebt u verschillende opties:

- Voor positieve seriële correlatie kunt u overwegen vertragingen van de afhankelijke en/of onafhankelijke variabele aan het model toe te voegen.

- Zorg er bij negatieve seriële correlatie voor dat geen van uw variabelen te veel vertraging heeft.

- Voor seizoenscorrelatie kunt u overwegen seizoensdummies aan het model toe te voegen.

Hypothese 3: Homoskedasticiteit

Uitleg

De volgende aanname van lineaire regressie is dat de residuen een constante variantie hebben op elk niveau van x. Dit heet homoscedasticiteit . Wanneer dit niet het geval is, lijden de residuen aan heteroscedasticiteit .

Wanneer heteroscedasticiteit aanwezig is in een regressieanalyse, worden de resultaten van de analyse moeilijk te geloven. Concreet vergroot heteroskedasticiteit de variantie van de schattingen van de regressiecoëfficiënten, maar het regressiemodel houdt daar geen rekening mee. Dit maakt het veel waarschijnlijker dat een regressiemodel zal beweren dat een term in het model statistisch significant is, terwijl dit in werkelijkheid niet het geval is.

Hoe te bepalen of aan deze veronderstelling wordt voldaan

De eenvoudigste manier om heteroskedasticiteit te detecteren is door een aangepaste waarde/residuele plot te creëren.

Zodra u een regressielijn aan een gegevensset heeft aangepast, kunt u een spreidingsdiagram maken waarin de aangepaste waarden van het model worden weergegeven ten opzichte van de residuen van die aangepaste waarden. Het onderstaande spreidingsdiagram toont een typische grafiek van de gepaste waarde versus het residu waarin heteroskedasticiteit aanwezig is.

Merk op hoe de residuen zich steeds meer verspreiden naarmate de aangepaste waarden toenemen. Deze “kegelvorm” is een klassiek teken van heteroscedasticiteit:

Wat te doen als deze veronderstelling niet wordt gerespecteerd

Er zijn drie veelgebruikte manieren om heteroskedasticiteit te corrigeren:

1. Transformeer de afhankelijke variabele. Een gebruikelijke transformatie is om eenvoudigweg de log van de afhankelijke variabele te nemen. Als we bijvoorbeeld de bevolkingsomvang (onafhankelijke variabele) gebruiken om het aantal bloemisten in een stad te voorspellen (afhankelijke variabele), kunnen we in plaats daarvan proberen de bevolkingsomvang te gebruiken om de logaritme van het aantal bloemisten in een stad te voorspellen. Het gebruik van de log van de afhankelijke variabele, in plaats van de oorspronkelijke afhankelijke variabele, resulteert vaak in het verdwijnen van heteroscedasticiteit.

2. Definieer de afhankelijke variabele opnieuw. Een gebruikelijke manier om de afhankelijke variabele opnieuw te definiëren is door een tarief te gebruiken in plaats van de ruwe waarde. In plaats van de bevolkingsomvang te gebruiken om het aantal bloemisten in een stad te voorspellen, kunnen we bijvoorbeeld de bevolkingsomvang gebruiken om het aantal bloemisten per hoofd van de bevolking te voorspellen. In de meeste gevallen vermindert dit de variabiliteit die van nature voorkomt binnen grotere populaties, omdat we het aantal bloemisten per persoon meten, in plaats van het aantal bloemisten zelf.

3. Gebruik gewogen regressie. Een andere manier om te corrigeren voor heteroskedasticiteit is het gebruik van gewogen regressie. Dit type regressie kent een gewicht toe aan elk gegevenspunt op basis van de variantie van de aangepaste waarde. In wezen geeft dit een laag gewicht aan datapunten met hogere varianties, waardoor hun resterende kwadraten kleiner worden. Wanneer de juiste gewichten worden gebruikt, kan dit het probleem van heteroskedasticiteit elimineren.

Hypothese 4: normaliteit

Uitleg

De volgende aanname van lineaire regressie is dat de residuen normaal verdeeld zijn.

Hoe te bepalen of aan deze veronderstelling wordt voldaan

Er zijn twee gebruikelijke manieren om te controleren of aan deze veronderstelling is voldaan:

1. Verifieer de hypothese visueel met behulp van QQ-plots .

Een QQ-plot, een afkorting van quantile-quantile plot, is een type plot dat we kunnen gebruiken om te bepalen of de residuen van een model al dan niet een normale verdeling volgen. Als de punten op de grafiek grofweg een rechte diagonale lijn vormen, wordt aan de aanname van normaliteit voldaan.

De volgende QQ-plot toont een voorbeeld van residuen die grofweg een normale verdeling volgen:

De onderstaande QQ-grafiek toont echter een voorbeeld van een geval waarin de residuen duidelijk afwijken van een rechte diagonale lijn, wat aangeeft dat ze niet de normale verdeling volgen:

2. Je kunt de normaliteitsaanname ook controleren met behulp van formele statistische tests zoals Shapiro-Wilk, Kolmogorov-Smironov, Jarque-Barre of D’Agostino-Pearson. Houd er echter rekening mee dat deze tests gevoelig zijn voor grote steekproeven; dat wil zeggen dat ze vaak concluderen dat de residuen niet normaal zijn als uw steekproefomvang groot is. Dit is de reden waarom het vaak eenvoudiger is om eenvoudigweg grafische methoden zoals een QQ-plot te gebruiken om deze hypothese te verifiëren.

Wat te doen als deze veronderstelling niet wordt gerespecteerd

Als niet aan de normaliteitsaanname wordt voldaan, heeft u verschillende opties:

- Controleer eerst of de uitschieters geen grote invloed hebben op de verdeling. Als er uitschieters zijn, zorg er dan voor dat het echte waarden zijn en geen fouten bij de gegevensinvoer.

- Vervolgens kunt u een niet-lineaire transformatie toepassen op de onafhankelijke en/of afhankelijke variabele. Veelvoorkomende voorbeelden zijn onder meer het nemen van de logaritmische wortel, de wortel of het omgekeerde van de onafhankelijke en/of afhankelijke variabele.

Verder lezen:

Inleiding tot eenvoudige lineaire regressie

Heteroscedasticiteit begrijpen in regressieanalyse

Hoe u een QQ-plot in R maakt en interpreteert