Inleiding tot meervoudige lineaire regressie

Als we de relatie tussen een enkele voorspellende variabele en een responsvariabele willen begrijpen, gebruiken we vaakeenvoudige lineaire regressie .

Als we echter de relatie tussen meerdere voorspellende variabelen en een responsvariabele willen begrijpen, kunnen we meervoudige lineaire regressie gebruiken.

Als we p- voorspellingsvariabelen hebben, heeft een meervoudig lineair regressiemodel de volgende vorm:

Y = β 0 + β 1 X 1 + β 2 X 2 + … + β p

Goud:

- Y : De responsvariabele

- Xj : de j -de voorspellende variabele

- βj : Het gemiddelde effect op Y van een toename van één eenheid in Xj , waarbij alle andere voorspellers vast blijven

- ε : De foutterm

De waarden van β 0 , β 1 , B 2 , …, β p worden gekozen met behulp van de kleinste kwadratenmethode , die de som van de kwadraten van de residuen (RSS) minimaliseert:

RSS = Σ(y i – ŷ i ) 2

Goud:

- Σ : Een Grieks symbool dat som betekent

- y i : de werkelijke responswaarde voor de i-de waarneming

- ŷ i : De voorspelde responswaarde op basis van het meervoudige lineaire regressiemodel

De methode die wordt gebruikt om deze coëfficiëntschattingen te vinden, is gekoppeld aan matrixalgebra en we zullen hier niet op de details ingaan. Gelukkig kan elk statistisch programma deze coëfficiënten voor u berekenen.

Hoe u meerdere lineaire regressie-uitvoer interpreteert

Stel dat we een meervoudig lineair regressiemodel passen met behulp van de voorspellende variabelen , de bestudeerde uren en de afgelegde voorbereidende examens , evenals een examenvariabele met een antwoordvariabele.

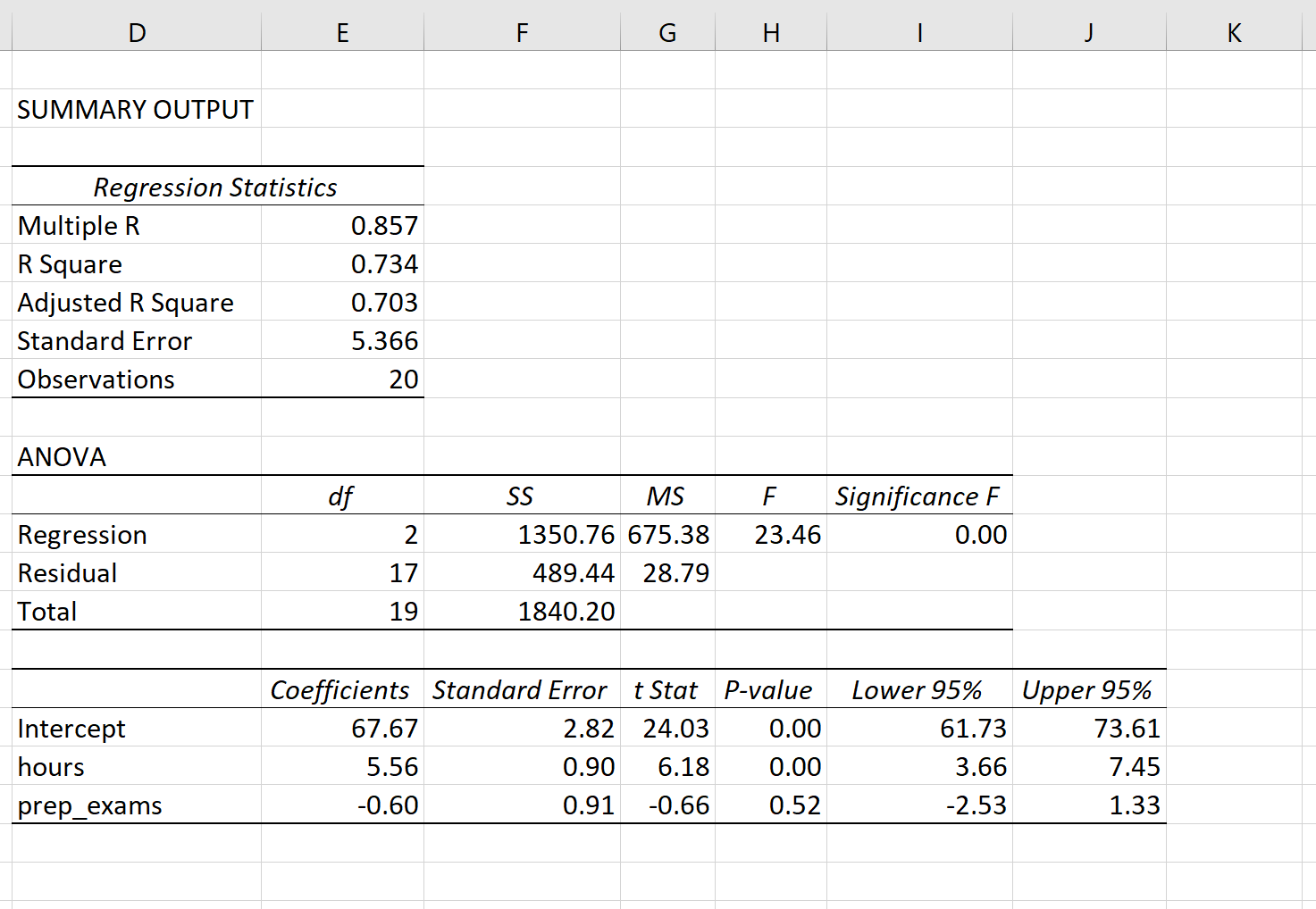

De volgende schermafbeelding laat zien hoe het resultaat van meervoudige lineaire regressie er voor dit model uit zou kunnen zien:

Opmerking: De onderstaande schermafbeelding toont de meervoudige lineaire regressie-uitvoer voor Excel , maar de getallen die in de uitvoer worden weergegeven zijn typerend voor de regressie-uitvoer die u zult zien met behulp van statistische software.

Op basis van de modelresultaten stellen de coëfficiënten ons in staat een geschat meervoudig lineair regressiemodel te vormen:

Examenscore = 67,67 + 5,56*(uren) – 0,60*(voorbereidende examens)

De manier om de coëfficiënten te interpreteren is als volgt:

- Elke extra stijging met één eenheid in het aantal bestudeerde uren gaat gepaard met een gemiddelde stijging van 5,56 punten in de examenscore, ervan uitgaande dat de oefenexamens constant blijven.

- Elke extra stijging met één eenheid in het aantal afgelegde voorbereidende examens gaat gepaard met een gemiddelde daling van de examenscore met 0,60 punten, ervan uitgaande dat het aantal gestudeerde uren constant blijft.

We kunnen dit model ook gebruiken om het verwachte examencijfer te bepalen dat een student zal behalen op basis van het totaal aantal gestudeerde uren en afgelegde voorbereidende examens. Een student die bijvoorbeeld 4 uur studeert en 1 voorbereidend examen aflegt, moet een examenscore van 89,31 behalen:

Examenscore = 67,67 + 5,56*(4) -0,60*(1) = 89,31

Zo interpreteert u de rest van de modelresultaten:

- R-kwadraat: Dit wordt de determinatiecoëfficiënt genoemd. Het is het deel van de variantie van de responsvariabele dat kan worden verklaard door de verklarende variabelen. In dit voorbeeld wordt 73,4% van de variatie in examenscores verklaard door het aantal gestudeerde uren en het aantal afgelegde voorbereidende examens.

- Standaardfout: Dit is de gemiddelde afstand tussen de waargenomen waarden en de regressielijn. In dit voorbeeld wijken de waargenomen waarden gemiddeld 5.366 eenheden af van de regressielijn.

- F: Dit is de algemene F-statistiek voor het regressiemodel, berekend als Regressie MS/Residuele MS.

- F Betekenis: Dit is de p-waarde die is gekoppeld aan de algehele F-statistiek. Dit vertelt ons of het regressiemodel als geheel statistisch significant is of niet. Met andere woorden, het vertelt ons of de twee verklarende variabelen samen een statistisch significant verband hebben met de responsvariabele. In dit geval is de p-waarde kleiner dan 0,05, wat aangeeft dat de verklarende variabelen, bestudeerde uren en afgelegde voorbereidende examens samen een statistisch significant verband hebben met het examenresultaat.

- P-waarden van de coëfficiënt. Individuele p-waarden vertellen ons of elke verklarende variabele statistisch significant is of niet. We kunnen zien dat het aantal gestudeerde uren statistisch significant is (p = 0,00), terwijl afgelegde voorbereidende examens (p = 0,52) niet statistisch significant zijn bij α = 0,05. Omdat voorbereidende examens uit het verleden niet statistisch significant zijn, kunnen we uiteindelijk besluiten ze uit het model te verwijderen.

Hoe de fit van een meervoudig lineair regressiemodel te evalueren

Twee getallen worden vaak gebruikt om te evalueren hoe goed een meervoudig lineair regressiemodel „past“ in een dataset:

1. R-kwadraat: Dit is het deel van de variantie in de responsvariabele dat kan worden verklaard door de voorspellende variabelen.

De R-kwadraatwaarde kan variëren van 0 tot 1. Een waarde van 0 geeft aan dat de responsvariabele helemaal niet kan worden verklaard door de voorspellende variabele. Een waarde van 1 geeft aan dat de responsvariabele perfect en zonder fouten kan worden verklaard door de voorspellende variabele.

Hoe hoger het R-kwadraat van een model, hoe beter het model in de gegevens kan passen.

2. Standaardfout: Dit is de gemiddelde afstand tussen de waargenomen waarden en de regressielijn. Hoe kleiner de standaardfout, hoe beter een model de gegevens kan aanpassen.

Als we voorspellingen willen doen met behulp van een regressiemodel, kan de standaardfout van de regressie een nuttiger metriek zijn om te weten dan R-kwadraat, omdat het ons een idee geeft van hoe nauwkeurig onze voorspellingen zijn in termen van eenheden.

Zie de volgende artikelen voor een volledige uitleg van de voor- en nadelen van het gebruik van R-kwadraat versus standaardfout om de modelfit te evalueren:

Meerdere lineaire regressie-aannames

Meervoudige lineaire regressie maakt vier belangrijke aannames over de gegevens:

1. Lineaire relatie: Er bestaat een lineaire relatie tussen de onafhankelijke variabele, x, en de afhankelijke variabele, y.

2. Onafhankelijkheid: De residuen zijn onafhankelijk. In het bijzonder is er geen correlatie tussen opeenvolgende residuen in tijdreeksgegevens.

3. Homoscedasticiteit: de residuen hebben een constante variantie op elk niveau van x.

4. Normaliteit: De modelresiduen zijn normaal verdeeld.

Zie dit artikel voor een volledige uitleg over hoe u deze hypothesen kunt testen.

Meervoudige lineaire regressie met behulp van software

De volgende tutorials bieden stapsgewijze voorbeelden van het uitvoeren van meervoudige lineaire regressie met behulp van verschillende statistische software:

Hoe meervoudige lineaire regressie uit te voeren in R

Hoe u meerdere lineaire regressies uitvoert in Python

Hoe u meerdere lineaire regressies uitvoert in Excel

Hoe u meervoudige lineaire regressie uitvoert in SPSS

Hoe meervoudige lineaire regressie uit te voeren in Stata

Lineaire regressie uitvoeren in Google Spreadsheets