Jakie jest założenie o równej wariancji w statystyce?

Wiele testów statystycznych zakłada równą wariancję . Jeżeli to założenie nie jest przestrzegane, wyniki testów stają się niewiarygodne.

Do najpopularniejszych testów i procedur statystycznych, które przyjmują założenie o równej wariancji, należą:

1. ANOVA

2. testy t

3. Regresja liniowa

W tym samouczku wyjaśniono założenia przyjęte dla każdego testu, sposób ustalenia, czy to założenie jest spełnione i co zrobić, jeśli zostanie naruszone.

Założenie równości wariancji w ANOVA

Do określenia, czy istnieje istotna różnica między średnimi trzech lub więcej niezależnych grup, stosuje się analizę ANOVA („analiza wariancji”).

Oto przykład, kiedy możemy zastosować ANOVA:

Załóżmy, że rekrutujemy 90 osób do udziału w eksperymencie dotyczącym utraty wagi. Losowo przydzielamy 30 osób do korzystania z programu A, B lub C na miesiąc.

Aby sprawdzić, czy program ma wpływ na utratę wagi, możemy wykonać jednokierunkową ANOVA .

W analizie ANOVA zakłada się, że każda z grup ma równą wariancję. Prawdziwość tej hipotezy można sprawdzić na dwa sposoby:

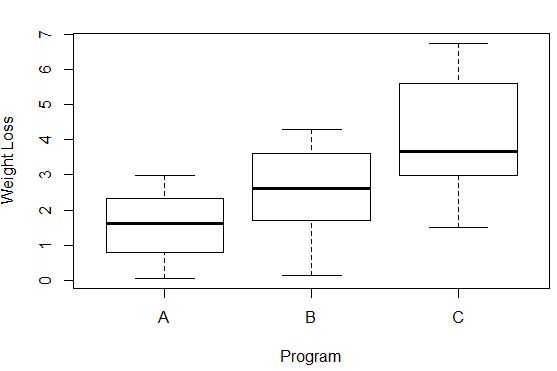

1. Utwórz wykresy pudełkowe.

Wykresy pudełkowe umożliwiają wizualną weryfikację założenia o równości wariancji.

Różnicę w utracie masy ciała w każdej grupie można zaobserwować na podstawie długości każdego wykresu pudełkowego. Im dłuższe pudełko, tym większa wariancja. Na przykład widzimy, że wariancja jest nieco większa w przypadku uczestników Programu C w porównaniu z Programem A i Programem B.

2. Wykonaj test Bartletta.

Test Bartletta sprawdza hipotezę zerową, że próbki mają równe wariancje, w porównaniu z alternatywną hipotezą, że próbki nie mają równych wariancji.

Jeśli wartość p testu jest poniżej pewnego poziomu istotności (np. 0,05), wówczas mamy dowód, że nie wszystkie próbki mają równe wariancje.

Co się stanie, jeśli założenie o równej wariancji nie zostanie spełnione?

Ogólnie rzecz biorąc, analizy ANOVA uważa się za dość odporne na naruszenia założenia o równych wariancjach, o ile każda grupa ma tę samą wielkość próby.

Jeśli jednak rozmiary próbek nie są takie same i to założenie zostanie poważnie naruszone, można zamiast tego przeprowadzić test Kruskala-Wallisa , który jest nieparametryczną wersją jednokierunkowej analizy ANOVA.

Założenie równej wariancji w testach t

Test t dla dwóch prób służy do sprawdzenia, czy średnie z dwóch populacji są równe, czy nie.

W teście założono, że wariancje pomiędzy obiema grupami są równe. Prawdziwość tej hipotezy można sprawdzić na dwa sposoby:

1. Skorzystaj z praktycznej zasady proporcji.

Ogólnie rzecz biorąc, jeśli stosunek największej wariancji do najmniejszej wariancji jest mniejszy niż 4, wówczas możemy założyć, że wariancje są w przybliżeniu równe i zastosować test t dla dwóch prób.

Załóżmy na przykład, że próbka 1 ma wariancję 24,5, a próbka 2 ma wariancję 15,2. Stosunek największej wariancji próbki do najmniejszej wariancji próbki zostanie obliczony jako: 24,5 / 15,2 = 1,61.

Ponieważ stosunek ten jest mniejszy niż 4, można założyć, że różnice między obiema grupami są w przybliżeniu równe.

2. Wykonaj test F.

Test F sprawdza hipotezę zerową, że próbki mają równe wariancje, w porównaniu z alternatywną hipotezą, że próbki nie mają równych wariancji.

Jeśli wartość p testu jest poniżej pewnego poziomu istotności (np. 0,05), wówczas mamy dowód, że nie wszystkie próbki mają równe wariancje.

Co się stanie, jeśli założenie o równej wariancji nie zostanie spełnione?

Jeżeli to założenie zostanie naruszone, wówczas możemy wykonać test t Welcha , który jest nieparametryczną wersją testu t dla dwóch prób i nie zakłada, że obie próbki mają równe wariancje.

Założenie równej wariancji w regresji liniowej

Regresję liniową stosuje się do ilościowego określenia związku między jedną lub większą liczbą zmiennych predykcyjnych a zmienną odpowiedzi.

Regresja liniowa zakłada, że reszty mają stałą wariancję na każdym poziomie zmiennych predykcyjnych. Nazywa się to homoskedastycznością . Jeżeli tak nie jest, reszty charakteryzują się heteroskedastycznością i wyniki analizy regresji stają się niewiarygodne.

Najczęstszym sposobem sprawdzenia, czy to założenie jest spełnione, jest utworzenie wykresu reszt w funkcji dopasowanych wartości. Jeśli reszty na tym wykresie wydają się być losowo rozproszone wokół zera, wówczas założenie o homoskedastyczności jest prawdopodobnie spełnione.

Jeśli jednak istnieje systematyczny trend reszt, taki jak kształt „stożka” na poniższym wykresie, wówczas problemem jest heteroskedastyczność:

Co się stanie, jeśli założenie o równej wariancji nie zostanie spełnione?

Jeżeli to założenie zostanie naruszone, najczęstszym sposobem rozwiązania problemu jest przekształcenie zmiennej odpowiedzi za pomocą jednej z trzech transformacji:

1. Transformacja logu: przekształć zmienną odpowiedzi z y na log(y) .

2. Transformacja pierwiastka kwadratowego: Przekształć zmienną odpowiedzi z y na √y .

3. Transformacja pierwiastka sześciennego: przekształć zmienną odpowiedzi z y na y 1/3 .

Dokonując tych przekształceń, problem heteroskedastyczności generalnie znika.

Innym sposobem skorygowania heteroskedastyczności jest zastosowanie regresji ważonej metodą najmniejszych kwadratów . Ten typ regresji przypisuje wagę każdemu punktowi danych na podstawie wariancji jego dopasowanej wartości.

Zasadniczo nadaje to niskie wagi punktom danych o większych wariancjach, zmniejszając ich kwadraty resztowe. Zastosowanie odpowiednich wag może wyeliminować problem heteroskedastyczności.

Dodatkowe zasoby

Trzy hipotezy sformułowane w analizie ANOVA

Cztery hipotezy sformułowane w teście T

Cztery założenia regresji liniowej