Análise de regressão

Este artigo explica o que é a análise de regressão e para que ela é usada nas estatísticas. Além disso, você poderá ver quais são os diferentes tipos de análise de regressão.

O que é análise de regressão?

Em estatística, a análise de regressão é um processo no qual se estuda a relação entre duas ou mais variáveis. Mais especificamente, a análise de regressão envolve o cálculo de uma equação que relaciona matematicamente as variáveis do estudo.

O modelo construído em uma análise de regressão é denominado modelo de regressão, enquanto a equação que relaciona as variáveis estudadas é denominada equação de regressão.

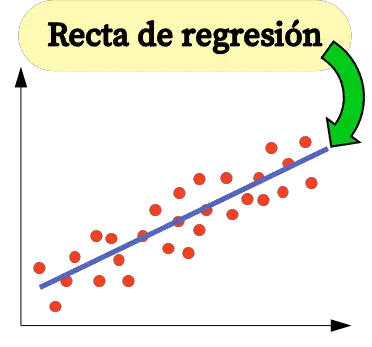

Por exemplo, se quiser estudar a relação entre a inflação de um país e o seu PIB, pode realizar uma análise de regressão para analisar a relação entre as duas variáveis. Nesse caso, a equação obtida na análise de regressão seria uma reta de regressão.

Assim, uma análise de regressão consiste na coleta de uma amostra de dados e, a partir dos dados coletados, é calculada uma equação que permite relacionar matematicamente as variáveis estudadas.

Nas análises de regressão, é importante distinguir entre os dois tipos de variáveis que podem ser incluídas no modelo de regressão:

- Variável dependente (ou variável resposta) : este é o fator que queremos analisar, portanto será construído um modelo de regressão para ver como o valor desta variável varia dependendo do valor de outras variáveis.

- Variável independente (ou variável explicativa) : é um fator que consideramos provável de influenciar a variável que desejamos analisar. Ou seja, o valor da variável independente afeta o valor da variável dependente.

Tipos de análise de regressão

Basicamente, existem três tipos de análise de regressão :

- Análise de regressão linear simples : O modelo de regressão possui uma variável independente e uma variável dependente e elas estão linearmente relacionadas.

- Análise de regressão linear múltipla : duas ou mais variáveis independentes estão linearmente relacionadas a uma variável dependente.

- Análise de regressão não linear : A relação entre a variável independente e a variável dependente é modelada usando uma função não linear.

Análise de regressão linear simples

A regressão linear simples é usada para relacionar uma variável independente a ambas as variáveis usando uma equação linear.

A equação de um modelo de regressão linear simples é uma reta, portanto é composta por dois coeficientes: a constante da equação (β 0 ) e o coeficiente de correlação entre as duas variáveis (β 1 ). Portanto, a equação para um modelo de regressão linear simples é y=β 0 +β 1 x.

![]()

As fórmulas para cálculo dos coeficientes de regressão linear simples são as seguintes:

![Rendered by QuickLaTeX.com \begin{array}{c}\beta_1=\cfrac{\displaystyle \sum_{i=1}^n (x_i-\overline{x})(y_i-\overline{y})}{\displaystyle \sum_{i=1}^n (x_i-\overline{x})^2}\\[12ex]\beta_0=\overline{y}-\beta_1\overline{x}\end{array}](https://statorials.org/wp-content/ql-cache/quicklatex.com-459281504d26f92756115054ef567021_l3.png)

Ouro:

-

é a constante da linha de regressão.

-

é a inclinação da linha de regressão.

-

é o valor da variável independente X dos dados i.

-

é o valor da variável dependente Y dos dados i.

-

é a média dos valores da variável independente

-

é a média dos valores da variável dependente Y.

Análise de regressão linear múltipla

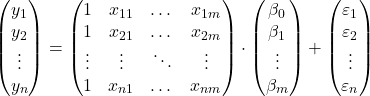

Num modelo de regressão linear múltipla , pelo menos duas variáveis independentes são incluídas. Em outras palavras, a regressão linear múltipla permite que diversas variáveis explicativas sejam ligadas linearmente a uma variável resposta. Portanto, a equação para um modelo de regressão linear múltipla é:

![]()

Ouro:

-

é a variável dependente.

-

é a variável independente eu.

-

é a constante da equação de regressão linear múltipla.

-

é o coeficiente de regressão associado à variável

.

-

é o erro ou resíduo, ou seja, a diferença entre o valor observado e o valor estimado pelo modelo.

-

é o número total de variáveis no modelo.

Então, se tivermos uma amostra com um total de

![]()

observações, podemos colocar o modelo de regressão linear múltipla em forma de matriz:

A expressão matricial acima pode ser reescrita atribuindo uma letra a cada matriz:

![]()

Assim, aplicando o critério dos mínimos quadrados, podemos chegar à fórmula para estimar os coeficientes de um modelo de regressão linear múltipla :

![]()

No entanto, a aplicação desta fórmula é muito trabalhosa e demorada, razão pela qual na prática se recomenda a utilização de software informático (como Minitab ou Excel) que permite criar um modelo de regressão múltipla com muito mais rapidez.

Análise de regressão não linear

Em estatística, a regressão não linear é um tipo de regressão em que uma função não linear é usada como modelo da equação de regressão. Portanto, a equação de um modelo de regressão não linear é uma função não linear.

Logicamente, a regressão não linear é usada para relacionar a variável independente com a variável dependente quando a relação entre as duas variáveis não é linear. Portanto, se ao traçarmos o gráfico dos dados amostrais observarmos que eles não possuem uma relação linear, ou seja, não formam aproximadamente uma linha reta, é melhor ‘utilizar um modelo de regressão não linear.

Por exemplo, a equação y=3-5x-8x 2 +x 3 é um modelo de regressão não linear porque relaciona matematicamente a variável independente X com a variável dependente Y por meio de uma função cúbica.

Existem basicamente três tipos de regressão não linear :

- Regressão Polinomial – Regressão não linear cuja equação está na forma de um polinômio.

- Regressão Logarítmica – Regressão não linear em que a variável independente é logaritmizada.

- Regressão Exponencial – Regressão não linear em que a variável independente reside no expoente da equação.

![]()

![]()

![]()

Para que é usada a análise de regressão?

A análise de regressão tem basicamente dois usos: a análise de regressão é usada para explicar a relação entre as variáveis explicativas e a variável de resposta e da mesma forma, a análise de regressão é usada para prever o valor da variável dependente para uma nova observação.

Ao obter a equação do modelo de regressão, podemos saber que tipo de relação existe entre as variáveis do modelo. Se o coeficiente de regressão de uma variável independente for positivo, a variável dependente aumentará à medida que aumenta. ao passo que se o coeficiente de regressão de uma variável independente for negativo, a variável dependente diminuirá à medida que aumenta.

Por outro lado, a equação matemática obtida na análise de regressão também nos permite fazer previsões de valores. Assim, ao introduzir os valores das variáveis explicativas na equação do modelo de regressão, podemos calcular o valor da variável dependente para um novo dado.