Como desenhar uma árvore de decisão em r (com exemplo)

No aprendizado de máquina , uma árvore de decisão é um tipo de modelo que usa um conjunto de variáveis preditoras para criar uma árvore de decisão que prevê o valor de uma variável de resposta.

A maneira mais fácil de traçar uma árvore de decisão em R é usar a função prp() do pacote rpart.plot .

O exemplo a seguir mostra como usar esta função na prática.

Exemplo: desenhando uma árvore de decisão em R

Para este exemplo, usaremos o conjunto de dados Hitters do pacote ISLR , que contém diversas informações sobre 263 jogadores profissionais de beisebol.

Usaremos esse conjunto de dados para construir uma árvore de regressão que usa home runs e anos jogados para prever o salário de um determinado jogador.

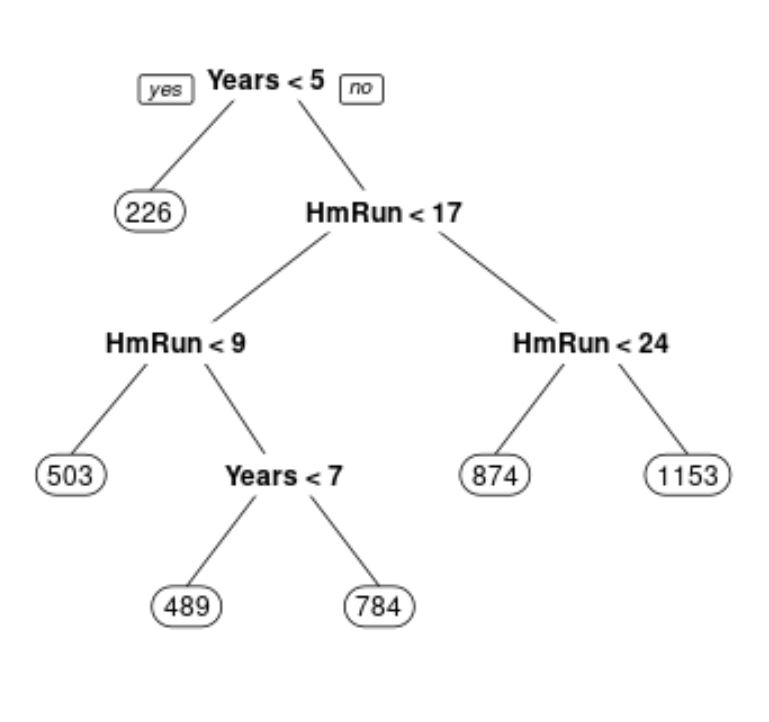

O código a seguir mostra como ajustar esta árvore de regressão e como usar a função prp() para desenhar a árvore:

library (ISLR) library (rpart) library (rpart.plot) #build the initial decision tree tree <- rpart(Salary ~ Years + HmRun, data=Hitters, control=rpart. control (cp= .0001 )) #identify best cp value to use best <- tree$cptable[which. min (tree$cptable[," xerror "])," CP "] #produce a pruned tree based on the best cp value pruned_tree <- prune (tree, cp=best) #plot the pruned tree prp(pruned_tree)

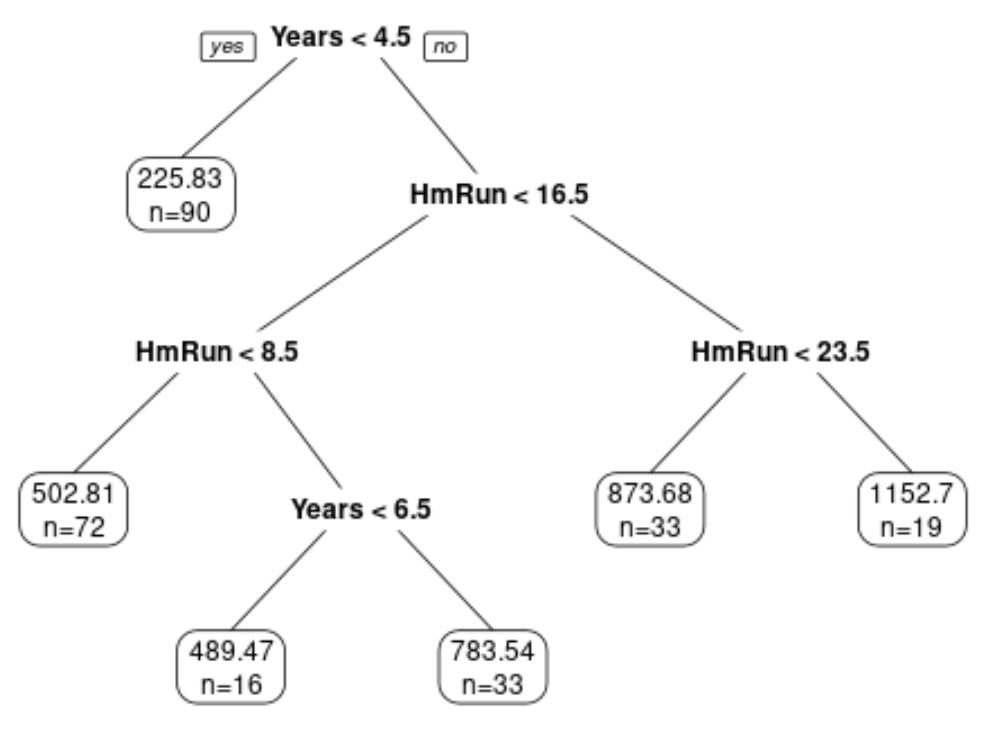

Observe que também podemos personalizar a aparência da árvore de decisão usando os argumentos faclen , extra , roundint e digits na função prp ():

#plot decision tree using custom arguments

prp(pruned_tree,

faclen= 0 , #use full names for factor labels

extra= 1 , #display number of observations for each terminal node

roundint= F , #don't round to integers in output

digits= 5 ) #display 5 decimal places in output

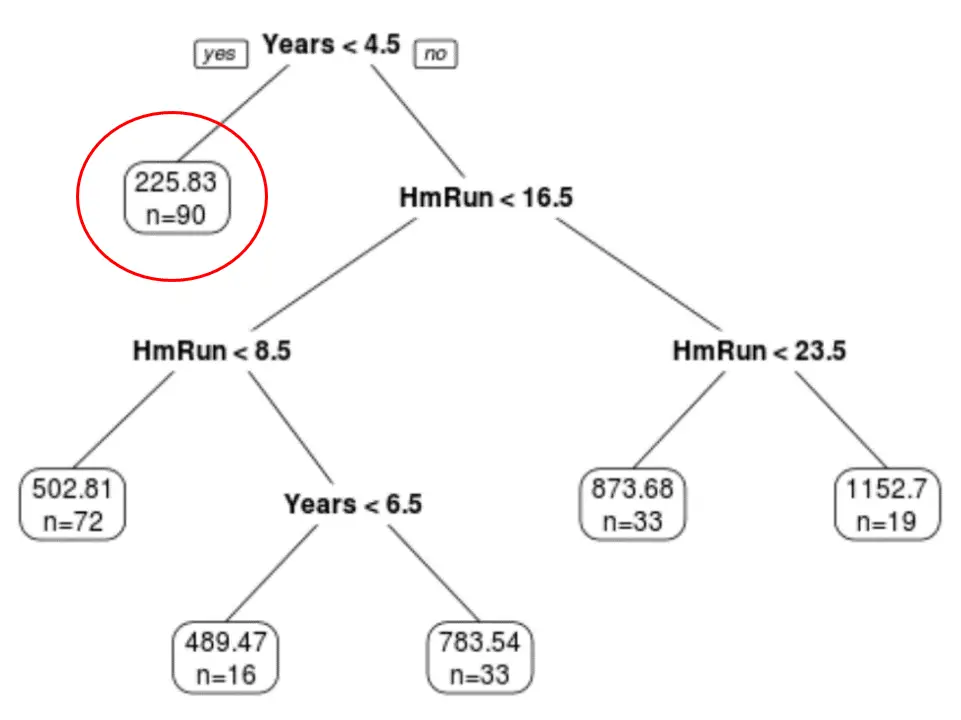

Podemos ver que a árvore possui seis nós terminais.

Cada nó terminal exibe o salário previsto dos jogadores naquele nó, bem como o número de observações do conjunto de dados original que pertencem a essa classificação.

Por exemplo, podemos ver que no conjunto de dados original, havia 90 jogadores com menos de 4,5 anos de experiência e seu salário médio era de US$ 225,83 mil .

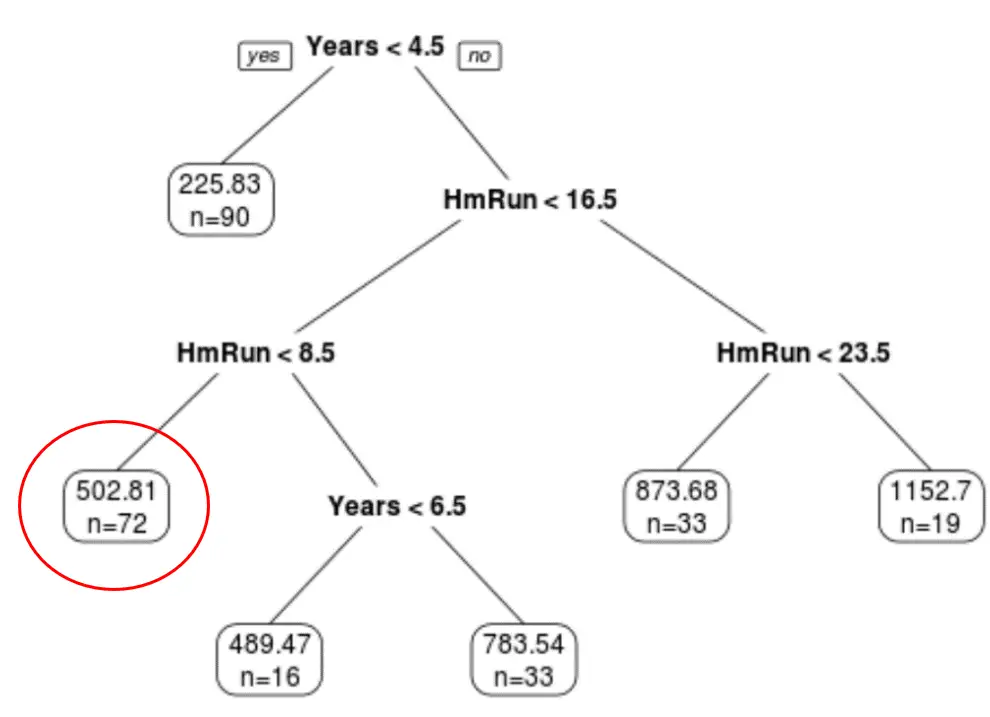

Também podemos usar a árvore para prever o salário de um determinado jogador com base em seus anos de experiência e na média de home runs.

Por exemplo, um jogador que tem 7 anos de experiência e 4 home runs em média tem um salário esperado de $ 502,81 mil .

Essa é uma das vantagens de utilizar uma árvore de decisão: podemos visualizar e interpretar facilmente os resultados.

Recursos adicionais

Os tutoriais a seguir fornecem informações adicionais sobre árvores de decisão:

Uma introdução às árvores de classificação e regressão

Árvore de decisão vs florestas aleatórias: qual a diferença?

Como ajustar árvores de classificação e regressão em R