Regressão linear múltipla

Este artigo explica o que é regressão linear múltipla em estatística. Além disso, você aprenderá como criar um modelo de regressão linear múltipla e como ele é interpretado.

O que é regressão linear múltipla?

A regressão linear múltipla é um modelo de regressão no qual duas ou mais variáveis independentes são incluídas. Em outras palavras, a regressão linear múltipla é um modelo estatístico que permite vincular linearmente diversas variáveis explicativas a uma variável resposta.

Portanto, um modelo de regressão linear múltipla é usado para encontrar uma equação que relacione duas ou mais variáveis independentes a uma variável dependente. Assim, ao substituir o valor de cada variável independente, obtém-se uma aproximação do valor da variável dependente.

Por exemplo, a equação y=3+6x 1 -4x 2 +7x 3 é um modelo de regressão linear múltipla porque relaciona matematicamente três variáveis independentes (x 1 , x 2 , x 3 ) com uma variável dependente (y) caminho de valor linear .

Fórmula de regressão linear múltipla

A equação para um modelo de regressão linear múltipla é y=β 0 +β 1 x 1 +β 2 x 2 +…+β m x m +ε.

![]()

Ouro:

-

é a variável dependente.

-

é a variável independente eu.

-

é a constante da equação de regressão linear múltipla.

-

é o coeficiente de regressão associado à variável

.

-

Este é o erro ou resíduo, ou seja, a diferença entre o valor observado e o valor estimado pelo modelo.

-

é o número total de variáveis no modelo.

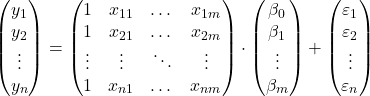

Então, se tivermos uma amostra com um total de

![]()

observações, podemos propor o modelo de regressão linear múltipla em forma de matriz:

A expressão de array acima pode ser reescrita atribuindo uma letra a cada array:

![]()

Assim, aplicando o critério dos mínimos quadrados, é possível chegar à fórmula de estimativa dos coeficientes de um modelo de regressão linear múltipla :

![]()

No entanto, a aplicação desta fórmula é muito trabalhosa e demorada, pelo que na prática recomenda-se a utilização de software informático (como Minitab ou Excel) que permite executar um modelo de regressão múltipla com muito mais rapidez.

Suposições múltiplas de regressão linear

Num modelo de regressão linear múltipla, as seguintes condições devem ser atendidas para que o modelo seja válido:

- Independência : os resíduos devem ser independentes entre si. Uma maneira comum de garantir a independência do modelo é adicionar aleatoriedade ao processo de amostragem.

- Homocedasticidade : Deve haver homogeneidade nas variâncias dos resíduos, ou seja, a variabilidade dos resíduos deve ser constante.

- Não multicolinearidade : as variáveis explicativas incluídas no modelo não podem ser vinculadas entre si ou, pelo menos, sua relação deve ser muito fraca.

- Normalidade : Os resíduos devem ter distribuição normal, ou seja, devem seguir uma distribuição normal com média 0.

- Linearidade : Supõe-se que a relação entre a variável resposta e as variáveis explicativas é linear.

Interpretando um modelo de regressão linear múltipla

Para interpretar um modelo de regressão linear múltipla, devemos observar o coeficiente de determinação (R ao quadrado), que expressa o percentual explicado pelo modelo de regressão. Assim, quanto maior o coeficiente de determinação, mais o modelo estará ajustado à amostra de dados estudada.

No entanto, a qualidade do ajuste de um modelo estatístico pode ser enganosa, especialmente em modelos de regressão linear múltipla. Porque ao adicionar uma variável ao modelo, o coeficiente de determinação aumenta, mesmo que a variável não seja significativa. Porém, é necessário maximizar o coeficiente de determinação tentando minimizar o número de variáveis, uma vez que o modelo é menos complicado e mais fácil de interpretar.

Para resolver este problema, é necessário calcular o coeficiente de determinação ajustado (R ajustado ao quadrado), que é um coeficiente estatístico que mede a qualidade de ajuste de um modelo de regressão, penalizando para cada variável adicionada ao modelo, ao contrário do coeficiente não ajustado de determinação. isso não leva em consideração o número de variáveis no modelo.

Assim, o coeficiente de determinação ajustado permite comparar a qualidade do ajuste de dois modelos com um número diferente de variáveis. A princípio, deve-se escolher o modelo que tenha maior coeficiente de determinação ajustado, mas se os dois modelos tiverem valores muito semelhantes, é melhor selecionar o modelo com menos variáveis, pois é mais fácil de interpretar.

Em contrapartida, os coeficientes de regressão indicam a relação entre a variável explicativa e a variável resposta. Se o coeficiente de regressão for positivo, a variável resposta aumentará à medida que a variável explicativa aumentar. ao passo que se o coeficiente de regressão for negativo, a variável resposta diminuirá quando a variável explicativa aumentar.

Logicamente, para que a condição anterior seja atendida, as demais variáveis devem permanecer constantes. Por isso é importante que não haja multicolinearidade entre as diferentes variáveis explicativas do modelo. Você pode ver como se estuda a multicolinearidade de um modelo pesquisando o artigo correspondente em nosso site.

Regressão linear múltipla e simples

Por fim, veremos quais são as diferenças entre um modelo de regressão linear simples e um modelo de regressão linear múltipla, visto que são dois modelos de regressão amplamente utilizados em estatística.

A regressão linear simples é um modelo de regressão usado para relacionar uma variável independente. Portanto, a equação de um modelo de regressão linear simples é a seguinte:

![]()

Portanto, a diferença entre a regressão linear múltipla e a regressão linear simples está na quantidade de variáveis explicativas. Um modelo de regressão linear múltipla possui duas ou mais variáveis explicativas, enquanto um modelo de regressão linear simples possui apenas uma variável explicativa.

![]()

Concluindo, a regressão linear múltipla é uma extensão da regressão linear simples, uma vez que são simplesmente adicionadas mais variáveis explicativas e seus respectivos coeficientes de regressão. Porém os coeficientes de regressão são calculados de forma diferente, para ver como isso é feito clique aqui: