Введение в простую линейную регрессию

Простая линейная регрессия — это статистический метод, который можно использовать, чтобы понять взаимосвязь между двумя переменными, x и y.

Переменная x известна как переменная-предиктор .

Другая переменная, y , известна как переменная ответа .

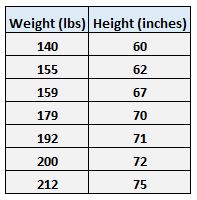

Например, предположим, что у нас есть следующий набор данных с весом и ростом семи человек:

Пусть вес будет переменной-предиктором, а рост — переменной отклика.

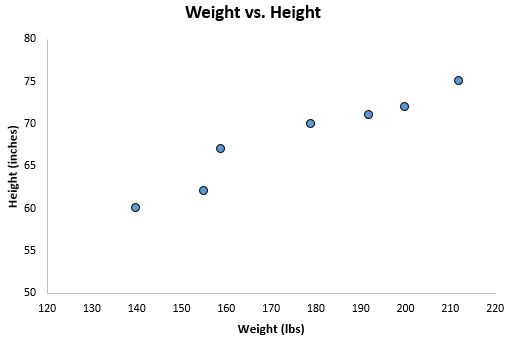

Если мы построим график этих двух переменных, используя диаграмму рассеяния, с весом по оси X и высотой по оси Y, это будет выглядеть так:

Предположим, мы хотим понять взаимосвязь между весом и ростом. Из диаграммы рассеяния мы ясно видим, что по мере увеличения веса рост также имеет тенденцию к увеличению, но для фактического количественного определения этой взаимосвязи между весом и ростом нам необходимо использовать линейную регрессию.

Используя линейную регрессию, мы можем найти линию, которая лучше всего «соответствует» нашим данным. Эта линия известна как линия регрессии по методу наименьших квадратов и может использоваться, чтобы помочь нам понять взаимосвязь между весом и ростом.

Обычно вы используете такое программное обеспечение, как Microsoft Excel, SPSS или графический калькулятор, чтобы найти уравнение для этой линии.

Формула линии наилучшего соответствия записывается:

ŷ = б 0 + б 1 х

где ŷ — прогнозируемое значение переменной отклика, b 0 — точка пересечения, b 1 — коэффициент регрессии, а x — значение переменной-предиктора.

Связанный: 4 примера использования линейной регрессии в реальной жизни

Найдите «наиболее подходящую линию»

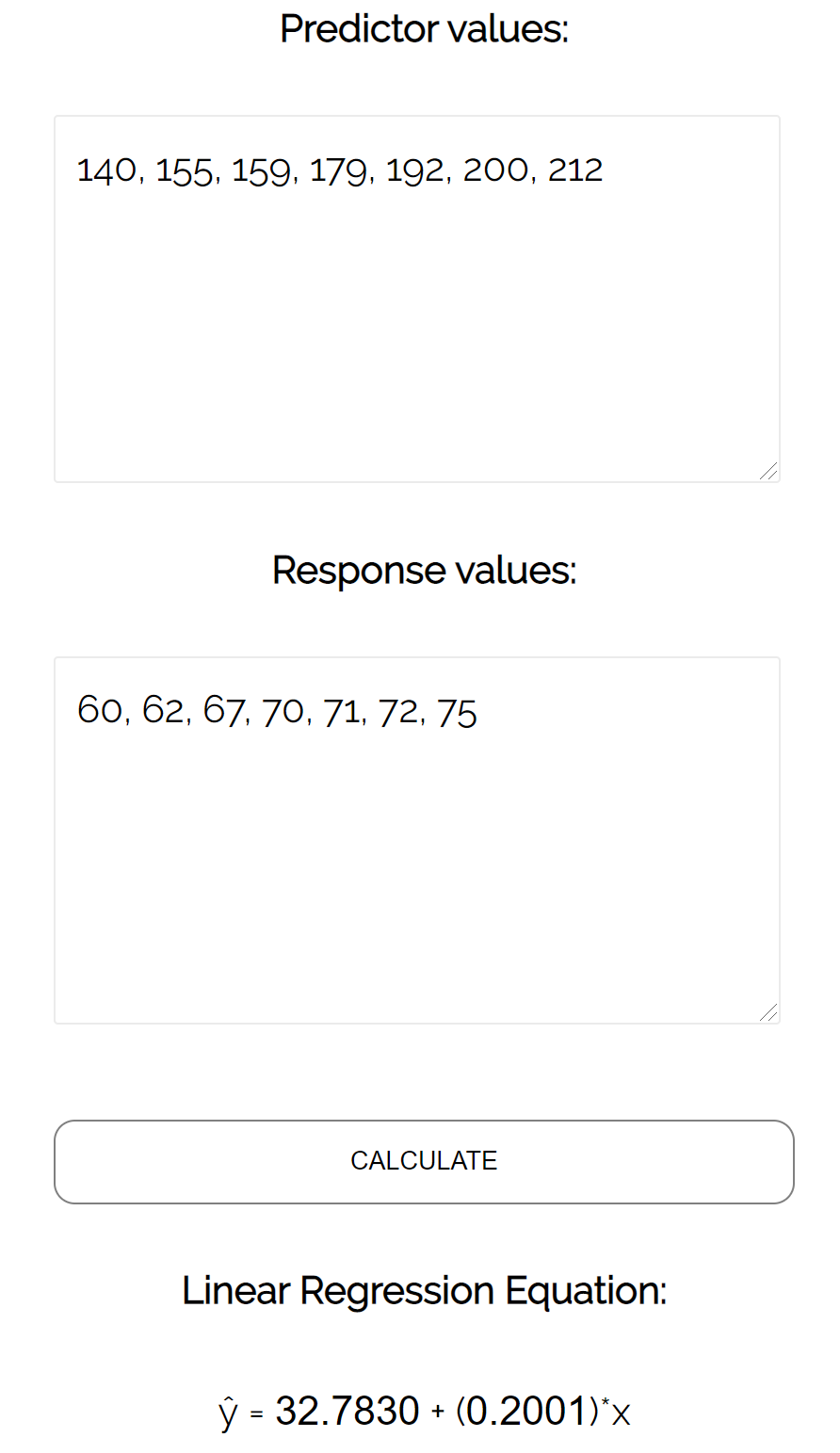

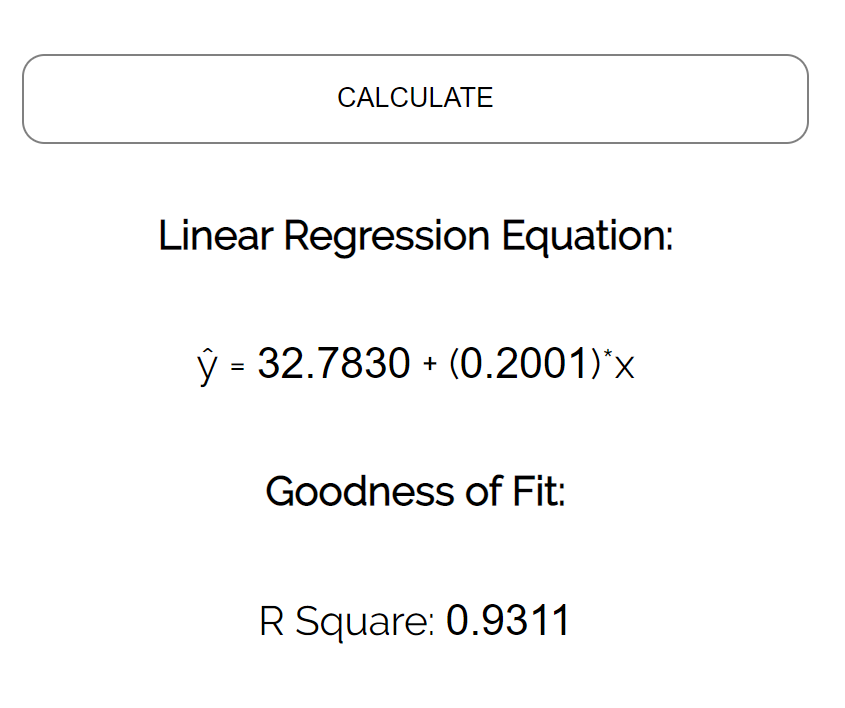

В этом примере мы можем просто вставить наши данные в калькулятор статистической линейной регрессии и нажать «Рассчитать» :

Калькулятор автоматически находит линию регрессии по методу наименьших квадратов :

ŷ = 32,7830 + 0,2001x

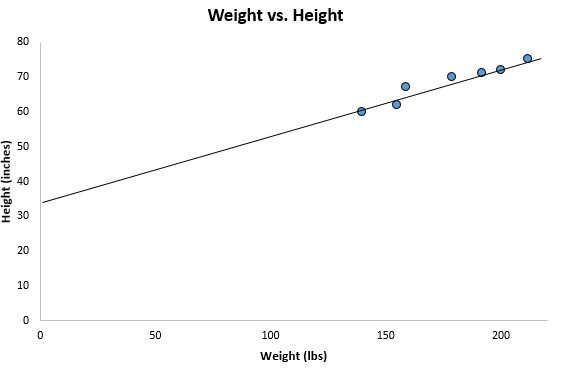

Если мы уменьшим масштаб нашей предыдущей диаграммы рассеяния и добавим эту линию на график, она будет выглядеть так:

Обратите внимание, как близко разбросаны наши точки данных вокруг этой линии. Действительно, эта линия регрессии по методу наименьших квадратов лучше всего подходит для наших данных среди всех возможных линий, которые мы могли бы нарисовать.

Как интерпретировать линию регрессии по методу наименьших квадратов

Вот как интерпретировать эту линию регрессии по методу наименьших квадратов: ŷ = 32,7830 + 0,2001x

б0 = 32,7830 . Это означает, что когда переменная масса предиктора равна нулю, прогнозируемая высота составляет 32,7830 дюйма. Иногда значение b 0 может быть полезно знать, но в данном конкретном примере интерпретировать b 0 нет смысла, поскольку человек не может весить ноль фунтов.

б1 = 0,2001 . Это означает, что увеличение x на одну единицу связано с увеличением y на 0,2001 единицы. В данном случае увеличение веса на один фунт связано с увеличением роста на 0,2001 дюйма.

Как использовать линию регрессии по методу наименьших квадратов

Используя эту линию регрессии по методу наименьших квадратов, мы можем ответить на такие вопросы, как:

Какой рост мы должны ожидать от человека, который весит 170 фунтов?

Чтобы ответить на этот вопрос, мы можем просто вставить 170 в нашу линию регрессии для x и найти y:

ŷ = 32,7830 + 0,2001(170) = 66,8 дюйма

Какой рост мы должны ожидать от человека, который весит 150 фунтов?

Чтобы ответить на этот вопрос, мы можем вставить 150 в нашу линию регрессии для x и решить для y:

ŷ = 32,7830 + 0,2001(150) = 62,798 дюйма

Внимание: при использовании уравнения регрессии для ответа на подобные вопросы обязательно используйте только те значения для переменной-предиктора, которые находятся в пределах диапазона переменной-предиктора в наборе данных. начало координат, которое мы использовали для создания линии регрессии по методу наименьших квадратов. Например, вес в нашем наборе данных колебался от 140 до 212 фунтов. Поэтому имеет смысл отвечать на вопросы об ожидаемом росте, когда вес составляет от 140 до 212 фунтов.

Коэффициент детерминации

Один из способов измерить, насколько хорошо линия регрессии по методу наименьших квадратов «соответствует» данным, — использовать коэффициент детерминации , обозначаемый R 2 .

Коэффициент детерминации — это доля дисперсии переменной отклика, которую можно объяснить переменной-предиктором.

Коэффициент детерминации может варьироваться от 0 до 1. Значение 0 указывает на то, что переменная отклика вообще не может быть объяснена переменной-предиктором. Значение 1 указывает на то, что переменная ответа может быть полностью без ошибок объяснена переменной-предиктором.

R 2 между 0 и 1 указывает степень, в которой переменная отклика может быть объяснена переменной-предиктором. Например, R 2 , равный 0,2, означает, что 20% дисперсии переменной отклика можно объяснить переменной-предиктором; R2, равный 0,77, указывает на то, что 77% дисперсии переменной отклика можно объяснить переменной-предиктором.

Обратите внимание, что в нашем предыдущем результате мы получили R2 , равный 0,9311, что указывает на то, что 93,11% изменчивости роста можно объяснить переменной-предиктором веса:

Это говорит нам о том, что вес является очень хорошим показателем роста.

Предположения линейной регрессии

Чтобы результаты модели линейной регрессии были действительными и надежными, мы должны убедиться, что выполняются следующие четыре предположения:

1. Линейная связь. Между независимой переменной x и зависимой переменной y существует линейная связь.

2. Независимость: остатки независимы. В частности, нет корреляции между последовательными остатками в данных временных рядов.

3. Гомоскедастичность: остатки имеют постоянную дисперсию на каждом уровне x.

4. Нормальность: остатки модели имеют нормальное распределение.

Если одно или несколько из этих предположений не выполняются, то результаты нашей линейной регрессии могут быть ненадежными или даже вводящими в заблуждение.

Обратитесь к этой статье для объяснения каждого предположения, как определить, выполняется ли предположение и что делать, если предположение не выполняется.