Множественная линейная регрессия

В этой статье объясняется, что такое множественная линейная регрессия в статистике. Кроме того, вы узнаете, как создать модель множественной линейной регрессии и как ее интерпретировать.

Что такое множественная линейная регрессия?

Множественная линейная регрессия — это модель регрессии, в которую включены две или более независимые переменные. Другими словами, множественная линейная регрессия — это статистическая модель, которая позволяет линейно связать несколько объясняющих переменных с переменной отклика.

Поэтому модель множественной линейной регрессии используется для поиска уравнения, которое связывает две или более независимых переменных с зависимой переменной. Таким образом, подставляя значение каждой независимой переменной, получают аппроксимацию значения зависимой переменной.

Например, уравнение y=3+ 6×1 -4×2 + 7×3 представляет собой модель множественной линейной регрессии, поскольку оно математически связывает три независимые переменные ( x1 , x2 , x3 ) с одной зависимой переменной (y) путем линейного значения. .

Формула множественной линейной регрессии

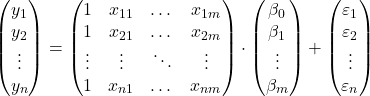

Уравнение модели множественной линейной регрессии: y=β 0 +β 1 x 1 +β 2 x 2 +…+β m x m +ε.

![]()

Золото:

-

является зависимой переменной.

-

– независимая переменная i.

-

— константа уравнения множественной линейной регрессии.

-

коэффициент регрессии, связанный с переменной

.

-

Это ошибка или остаток, то есть разница между наблюдаемым значением и значением, оцененным моделью.

-

— общее количество переменных в модели.

Итак, если у нас есть образец с общим количеством

![]()

наблюдений мы можем предложить модель множественной линейной регрессии в матричной форме:

Выражение массива, приведенное выше, можно переписать, присвоив букву каждому массиву:

![]()

Таким образом, применив критерий наименьших квадратов, можно прийти к формуле оценки коэффициентов модели множественной линейной регрессии :

![]()

Однако применение этой формулы очень трудоемко и требует много времени, поэтому на практике рекомендуется использовать компьютерное программное обеспечение (например, Minitab или Excel), которое позволяет гораздо быстрее прогонять множественную регрессионную модель.

Множественные предположения линейной регрессии

В модели множественной линейной регрессии для того, чтобы модель была действительной, должны быть выполнены следующие условия:

- Независимость : остатки должны быть независимы друг от друга. Распространенный способ обеспечить независимость модели — добавить случайность в процесс выборки.

- Гомоскедастичность : дисперсии остатков должны быть однородными, то есть изменчивость остатков должна быть постоянной.

- Немультиколлинеарность : объясняющие переменные, включенные в модель, не могут быть связаны друг с другом или, по крайней мере, их связь должна быть очень слабой.

- Нормальность : остатки должны быть нормально распределены или, другими словами, они должны следовать нормальному распределению со средним значением 0.

- Линейность : Предполагается, что связь между переменной ответа и объясняющими переменными является линейной.

Интерпретация модели множественной линейной регрессии

Чтобы интерпретировать модель множественной линейной регрессии, мы должны посмотреть на коэффициент детерминации (R в квадрате), который выражает процент, объясняемый моделью регрессии. Таким образом, чем выше коэффициент детерминации, тем больше модель будет адаптирована к изучаемой выборке данных.

Однако степень соответствия статистической модели может вводить в заблуждение, особенно в моделях множественной линейной регрессии. Потому что при добавлении переменной в модель коэффициент детерминации увеличивается, даже если переменная не является значимой. Однако необходимо максимизировать коэффициент детерминации, пытаясь минимизировать количество переменных, поскольку модель менее сложна и ее легче интерпретировать.

Чтобы решить эту проблему, необходимо рассчитать скорректированный коэффициент детерминации (скорректированный R-квадрат), который представляет собой статистический коэффициент, измеряющий качество соответствия регрессионной модели, наказывающий за каждую добавленную в модель переменную, в отличие от нескорректированного коэффициента. решимости. при этом не учитывается количество переменных в модели.

Таким образом, скорректированный коэффициент детерминации позволяет сравнить степень соответствия двух моделей с разным количеством переменных. В принципе, следует выбрать модель с более высоким скорректированным коэффициентом детерминации, но если две модели имеют очень похожие значения, лучше выбрать модель с меньшим количеством переменных, поскольку ее легче интерпретировать.

Напротив, коэффициенты регрессии указывают на связь между объясняющей переменной и переменной ответа. Если коэффициент регрессии положителен, переменная ответа будет увеличиваться по мере увеличения объясняющей переменной. тогда как, если коэффициент регрессии отрицательный, переменная ответа будет уменьшаться при увеличении объясняющей переменной.

Логично, что для выполнения предыдущего условия другие переменные должны оставаться постоянными. Вот почему важно, чтобы между различными объясняющими переменными модели не было мультиколлинеарности. Посмотреть, как изучается мультиколлинеарность модели, можно, выполнив поиск соответствующей статьи на нашем сайте.

Множественная и простая линейная регрессия

Наконец, мы увидим, каковы различия между простой моделью линейной регрессии и моделью множественной линейной регрессии, поскольку это две модели регрессии, широко используемые в статистике.

Простая линейная регрессия — это модель регрессии, используемая для связи независимой переменной. Итак, уравнение простой модели линейной регрессии выглядит следующим образом:

![]()

Следовательно, разница между множественной линейной регрессией и простой линейной регрессией заключается в количестве объясняющих переменных. Модель множественной линейной регрессии имеет две или более объясняющие переменные, тогда как модель простой линейной регрессии имеет только одну объясняющую переменную.

![]()

В заключение отметим, что множественная линейная регрессия является расширением простой линейной регрессии, поскольку просто добавляется больше объясняющих переменных и соответствующих им коэффициентов регрессии. Однако коэффициенты регрессии рассчитываются по-другому. Чтобы узнать, как это делается, нажмите здесь: