Нижние квадраты

В этой статье объясняется, что такое метод наименьших квадратов в статистике, что такое метод наименьших квадратов и как регрессионная модель аппроксимируется критерием наименьших квадратов.

Что такое метод наименьших квадратов?

Метод наименьших квадратов — это статистический метод, используемый для определения уравнения регрессии. Другими словами, метод наименьших квадратов – это критерий, используемый в регрессионной модели для минимизации ошибки, получаемой при расчете уравнения регрессии.

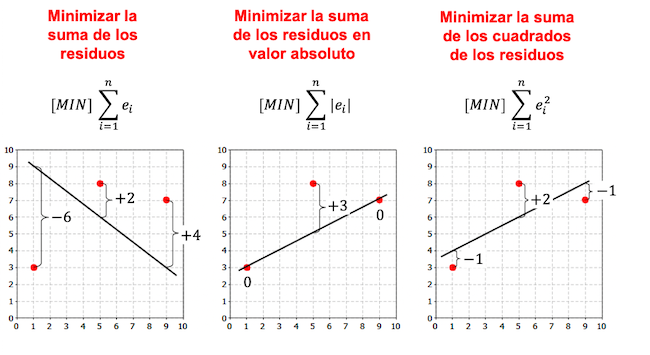

Конкретно метод наименьших квадратов состоит в минимизации суммы квадратов остатков, или, другими словами, он основан на минимизации суммы квадратов разностей между значениями, предсказанными регрессионной моделью, и наблюдаемыми значениями. . . Ниже мы подробно увидим, как модель регрессии аппроксимируется критерием наименьших квадратов.

Основная особенность метода наименьших квадратов заключается в том, что максимально большие расстояния между наблюдаемыми значениями и функцией регрессии сводятся к минимуму. В отличие от других критериев регрессии, метод наименьших квадратов считает более важным минимизировать большие остатки, чем малые, поскольку квадрат большого числа намного больше квадрата малого. число.

Ошибка оценки

Чтобы полностью понять концепцию метода наименьших квадратов, мы должны сначала понять, что такое остатки в регрессионной модели. Поэтому ниже мы увидим, что такое ошибка оценки и как она рассчитывается.

В статистике ошибка оценки , также называемая остатком , представляет собой разницу между истинным значением и значением, полученным с помощью регрессионной модели. Таким образом, статистический остаток рассчитывается следующим образом:

![]()

Золото:

-

является остатком данных i.

-

— реальная ценность данных i.

-

— значение, предоставленное моделью регрессии для данных i.

Таким образом, чем больше остаток фрагмента данных, тем хуже регрессионная модель адаптирована к этому фрагменту данных. Таким образом, чем меньше остаток, тем меньше расстояние между его фактическим значением и прогнозируемым значением.

Аналогично, если остаток части данных положителен, это означает, что модель регрессии прогнозирует значение ниже истинного значения. тогда как, если остаток отрицательный, это означает, что прогнозируемое значение больше фактического значения.

Минимизируйте квадраты ошибок

Теперь, когда мы знаем, что такое остаток в статистике, будет легче понять, как минимизировать квадраты ошибок.

Квадрат ошибки — это квадрат остатка, поэтому квадрат ошибки равен разнице между истинным значением и значением, полученным с помощью модели регрессии, возведенной в степень двойки.

![]()

Золото:

-

— квадрат остатка данных i.

-

— реальная ценность данных i.

-

— значение, предоставленное моделью регрессии для данных i.

Таким образом, метод наименьших квадратов заключается в создании регрессионной модели путем минимизации суммы квадратов ошибок . Таким образом, критерий наименьших квадратов основан на минимизации следующего выражения:

![Rendered by QuickLaTeX.com \begin{array}{l} [MIN] \ \displaystyle \sum_{i=1}^ne_i^2\\[4ex][MIN] \ \displaystyle \sum_{i=1}^n(y_i-\widehat{y}_i)^2\end{array}](https://statorials.org/wp-content/ql-cache/quicklatex.com-0a82d4d723b77093b4d584609f372cd7_l3.png)

Вот почему критерий наименьших квадратов также называют критерием наименьших квадратов.

Как видно из предыдущей формулы, критерий наименьших квадратов придает большее значение минимизации больших остатков, чем малых остатков. Например, если один остаток равен 3, а другой остаток равен 5, их квадраты равны 9 и 25 соответственно, поэтому критерий наименьших квадратов будет отдавать приоритет минимизации второго остатка перед первым остатком.

Корректировка методом наименьших квадратов

Подбор модели регрессии с использованием критерия наименьших квадратов заключается в поиске модели регрессии, которая минимизирует квадраты остатков. Следовательно, уравнение, полученное на основе регрессионной модели, будет таким, в котором квадраты разностей между наблюдаемыми значениями и подобранными значениями минимальны.

Обратите внимание, что в следующем примере существует больше критериев для создания регрессионной модели, и в зависимости от выбранного критерия уравнение регрессии будет разным.

Как видно из предыдущих примеров, линия, полученная из модели линейной регрессии для того же набора данных, зависит от выбранного критерия. Обычно в регрессионных моделях используется критерий наименьших квадратов.

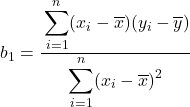

В статистике наиболее широко используемой моделью регрессии является простая модель линейной регрессии, которая состоит из аппроксимации связи между независимой переменной X и зависимой переменной Y с помощью прямой линии.

![]()

Итак, формулы для подгонки набора данных к простой модели линейной регрессии:

![]()

Вы можете увидеть пример того, как рассчитывается простая модель линейной регрессии с использованием критерия наименьших квадратов, нажав на следующую ссылку: