ความน่าเชื่อถือระหว่างผู้ประเมินคืออะไร? (คำจำกัดความ & #038; ตัวอย่าง)

ในเชิงสถิติ ความน่าเชื่อถือของผู้ประเมินระหว่างกัน เป็นวิธีหนึ่งในการวัดระดับข้อตกลงระหว่างผู้ประเมินหรือผู้พิพากษาหลายคน

ใช้เพื่อประเมินความน่าเชื่อถือของการตอบสนองที่เกิดจากรายการต่างๆ ในการทดสอบ หากการทดสอบมีความน่าเชื่อถือของผู้ประเมินระหว่างกันต่ำกว่า อาจบ่งชี้ได้ว่ารายการทดสอบนั้นทำให้เกิดความสับสน ไม่ชัดเจน หรือแม้แต่ไม่มีประโยชน์ด้วยซ้ำ

มีสองวิธีทั่วไปในการวัดความน่าเชื่อถือระหว่างผู้ประเมิน:

1. ร้อยละของข้อตกลง

วิธีง่ายๆ ในการวัดความน่าเชื่อถือของผู้ประเมินระหว่างกันคือการคำนวณเปอร์เซ็นต์ของรายการที่ผู้ตัดสินเห็นด้วย

สิ่งนี้เรียกว่า เปอร์เซ็นต์ข้อตกลง ซึ่งจะอยู่ระหว่าง 0 ถึง 1 เสมอ โดย 0 หมายถึงไม่มีข้อตกลงระหว่างผู้ประเมิน และ 1 หมายถึงข้อตกลงที่สมบูรณ์แบบระหว่างผู้ประเมิน

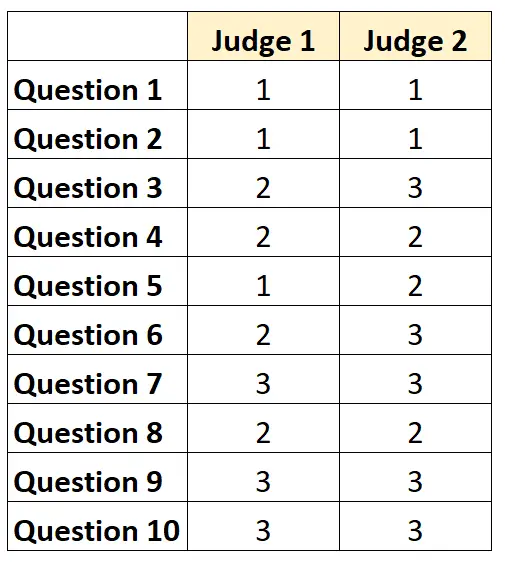

ตัวอย่างเช่น สมมติว่าผู้พิพากษาสองคนถูกขอให้ให้คะแนนความยากของ 10 ข้อในการทดสอบในระดับ 1 ถึง 3 ผลลัพธ์แสดงไว้ด้านล่าง:

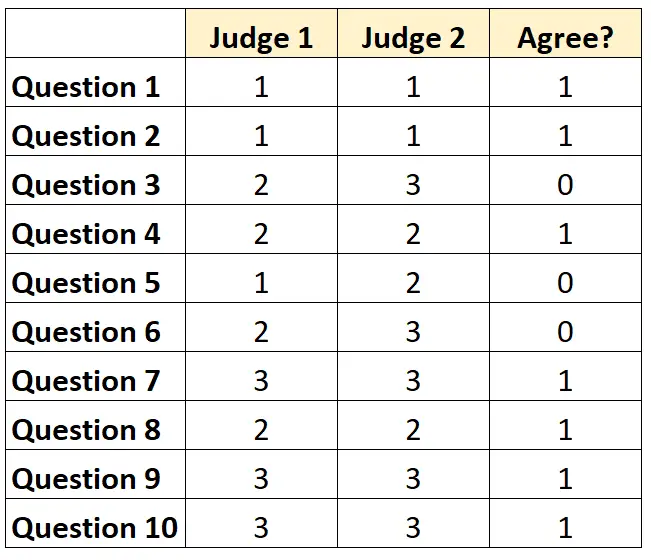

สำหรับแต่ละคำถาม เราสามารถเขียน “1” หากกรรมการทั้งสองเห็นด้วย และ “0” หากไม่เห็นด้วย

เปอร์เซ็นต์ของคำถามที่กรรมการเห็นด้วยคือ 7/10 = 70%

2. คัปปาของโคเฮน

วิธีที่ยากที่สุด (และเข้มงวดที่สุด) ในการวัดความน่าเชื่อถือของผู้ประเมินระหว่างกันคือการใช้ Kappa ของโคเฮน ซึ่งจะคำนวณเปอร์เซ็นต์ของรายการที่ผู้ประเมินเห็นด้วย ขณะเดียวกันก็คำนึงถึงว่าผู้ประเมินอาจเห็นด้วยกับองค์ประกอบบางอย่างเท่านั้น โชคดี.

สูตรคัปปาของโคเฮนคำนวณได้ดังนี้:

k = (พี โอ – พี อี ) / (1 – พี อี )

ทอง:

- p o : ข้อตกลงสัมพัทธ์ที่สังเกตได้ระหว่างผู้ประเมิน

- p e : ความน่าจะเป็นสมมุติฐานของข้อตกลงโอกาส

Kappa ของ Cohen มีค่าระหว่าง 0 ถึง 1 เสมอ โดย 0 หมายถึงไม่มีข้อตกลงระหว่างผู้ประเมิน และ 1 หมายถึงข้อตกลงที่สมบูรณ์แบบระหว่างผู้ประเมิน

สำหรับตัวอย่างวิธีคำนวณคัปปาของโคเฮนทีละขั้นตอน โปรดดู บทช่วยสอนนี้

วิธีการตีความความน่าเชื่อถือของผู้ประเมินระหว่างกัน

ยิ่งความน่าเชื่อถือของผู้ประเมินระหว่างกันสูงเท่าใด ผู้ตัดสินหลายรายก็จะให้คะแนนรายการหรือคำถามในการทดสอบที่มีคะแนนใกล้เคียงกันมากขึ้นเท่านั้น

โดยทั่วไป จำเป็นต้องมีข้อตกลงระหว่างผู้ประเมินอย่างน้อย 75% ในพื้นที่ส่วนใหญ่เพื่อให้การทดสอบถือว่าเชื่อถือได้ อย่างไรก็ตาม อาจจำเป็นต้องมีความน่าเชื่อถือของผู้ประเมินระหว่างกันที่สูงขึ้นในโดเมนเฉพาะ

ตัวอย่างเช่น ความน่าเชื่อถือของผู้ประเมินระหว่างกันที่ 75% อาจเป็นที่ยอมรับสำหรับการทดสอบเพื่อพิจารณาว่าจะรับรายการโทรทัศน์ได้ดีเพียงใด

ในทางกลับกัน อาจจำเป็นต้องมีความน่าเชื่อถือของผู้ประเมินระหว่างกัน 95% ในสถานพยาบาลซึ่งมีแพทย์หลายคนตัดสินว่าควรใช้การรักษาบางอย่างกับผู้ป่วยรายใดรายหนึ่งหรือไม่

โปรดทราบว่าในสภาพแวดล้อมทางวิชาการส่วนใหญ่และสาขาการวิจัยที่เข้มงวด Cohen’s Kappa ใช้ในการคำนวณความน่าเชื่อถือระหว่างผู้ประเมิน

แหล่งข้อมูลเพิ่มเติม

ข้อมูลเบื้องต้นเกี่ยวกับการวิเคราะห์ความน่าเชื่อถือโดยย่อ

ความน่าเชื่อถือแบ่งออกเป็นสองส่วนคืออะไร?

ความน่าเชื่อถือของการทดสอบซ้ำคืออะไร?

ความน่าเชื่อถือของรูปแบบคู่ขนานคืออะไร?

ข้อผิดพลาดมาตรฐานในการวัดคืออะไร?

เครื่องคิดเลขแคปปาของโคเฮน