ความสัมพันธ์

บทความนี้จะอธิบายความหมายของความสัมพันธ์ระหว่างตัวแปรสองตัว วิธีการคำนวณค่าสัมประสิทธิ์สหสัมพันธ์ และความสัมพันธ์ประเภทต่างๆ ที่มีอยู่ นอกจากนี้ยังแสดงวิธีตีความค่าความสัมพันธ์ระหว่างตัวแปรสองตัวด้วย

ความสัมพันธ์คืออะไร?

สหสัมพันธ์ เป็นการวัดทางสถิติที่ระบุระดับความสัมพันธ์ระหว่างตัวแปรสองตัว โดยเฉพาะอย่างยิ่ง ความสัมพันธ์เชิงเส้น ถูกนำมาใช้เพื่อกำหนดระดับของความสัมพันธ์เชิงเส้นระหว่างตัวแปรสองตัวที่แตกต่างกัน

ตัวแปรสองตัวเชื่อมโยงกันเมื่อเปลี่ยนค่าของตัวแปรหนึ่งก็เปลี่ยนค่าของตัวแปรอีกตัวหนึ่งด้วย ตัวอย่างเช่น ถ้าการเพิ่มตัวแปร A ยังเพิ่มตัวแปร B ก็มีความสัมพันธ์กันระหว่างตัวแปร A และ B

ประเภทของความสัมพันธ์

ขึ้นอยู่กับความสัมพันธ์ระหว่างตัวแปรสุ่มสองตัว ความสัมพันธ์เชิงเส้นประเภท ต่อไปนี้จะแยกแยะได้:

- ความสัมพันธ์โดยตรง (หรือความสัมพันธ์เชิงบวก) : ตัวแปรหนึ่งจะเพิ่มขึ้นเมื่ออีกตัวแปรหนึ่งเพิ่มขึ้นเช่นกัน

- ความสัมพันธ์แบบผกผัน (หรือความสัมพันธ์เชิงลบ) : เมื่อตัวแปรตัวหนึ่งเพิ่มขึ้น อีกตัวหนึ่งก็จะลดลง และในทางกลับกัน หากตัวแปรตัวหนึ่งลดลง อีกตัวก็จะเพิ่มขึ้น

- Zero correlation (no correlation) : ไม่มีความสัมพันธ์ระหว่างตัวแปรทั้งสอง

โปรดจำไว้ว่าสิ่งเหล่านี้คือความสัมพันธ์เชิงเส้นประเภทต่างๆ ที่มีอยู่ แต่อาจเป็นได้ว่าความสัมพันธ์ทางคณิตศาสตร์ระหว่างตัวแปรสองตัวไม่สามารถแสดงเป็นเส้นตรงได้ แต่จำเป็นต้องใช้ฟังก์ชันที่ซับซ้อนมากขึ้น เช่น อุปมาแทน หรือลอการิทึม ในกรณีนี้ มันจะเป็น ความสัมพันธ์แบบไม่เชิงเส้น

ค่าสัมประสิทธิ์สหสัมพันธ์

เมื่อพิจารณาถึงคำจำกัดความของความสัมพันธ์และความสัมพันธ์ประเภทต่างๆ ที่มีอยู่ เรามาดูวิธีการคำนวณค่าทางสถิตินี้กัน

ค่าสัมประสิทธิ์สหสัมพันธ์ หรือที่เรียกว่า ค่าสัมประสิทธิ์สหสัมพันธ์เชิงเส้น หรือ ค่าสัมประสิทธิ์สหสัมพันธ์แบบเพียร์สัน คือค่าของความสัมพันธ์ระหว่างตัวแปรสองตัว

ค่าสัมประสิทธิ์สหสัมพันธ์ของตัวแปรทางสถิติสองตัวจะเท่ากับผลหารระหว่างความแปรปรวนร่วมของตัวแปรและรากที่สองของผลคูณของความแปรปรวนของตัวแปรแต่ละตัว ดังนั้นสูตรในการคำนวณค่าสัมประสิทธิ์สหสัมพันธ์จึงเป็นดังนี้

![]()

เมื่อคำนวณค่าสัมประสิทธิ์สหสัมพันธ์ต่อประชากร สัญลักษณ์สหสัมพันธ์จะเป็นตัวอักษรกรีก ρ แต่เมื่อคำนวณสัมประสิทธิ์สัมพันธ์กับตัวอย่าง โดยปกติจะใช้ตัวอักษร r เป็นสัญลักษณ์

ค่าของดัชนีความสัมพันธ์สามารถอยู่ระหว่าง -1 ถึง +1 รวม เราจะดูด้านล่างว่าค่าของสัมประสิทธิ์สหสัมพันธ์ถูกตีความอย่างไร

คุณสามารถดูตัวอย่างที่ชัดเจนของวิธีคำนวณค่าสัมประสิทธิ์สหสัมพันธ์ได้จากลิงก์ต่อไปนี้:

โปรดทราบว่ามีค่าสัมประสิทธิ์สหสัมพันธ์ประเภทอื่นๆ เช่น สัมประสิทธิ์สหสัมพันธ์ของสเปียร์แมนหรือเคนดัลล์ แต่สิ่งที่พบบ่อยที่สุดคือค่าสัมประสิทธิ์สหสัมพันธ์ของเพียร์สันอย่างไม่ต้องสงสัย

การตีความความสัมพันธ์

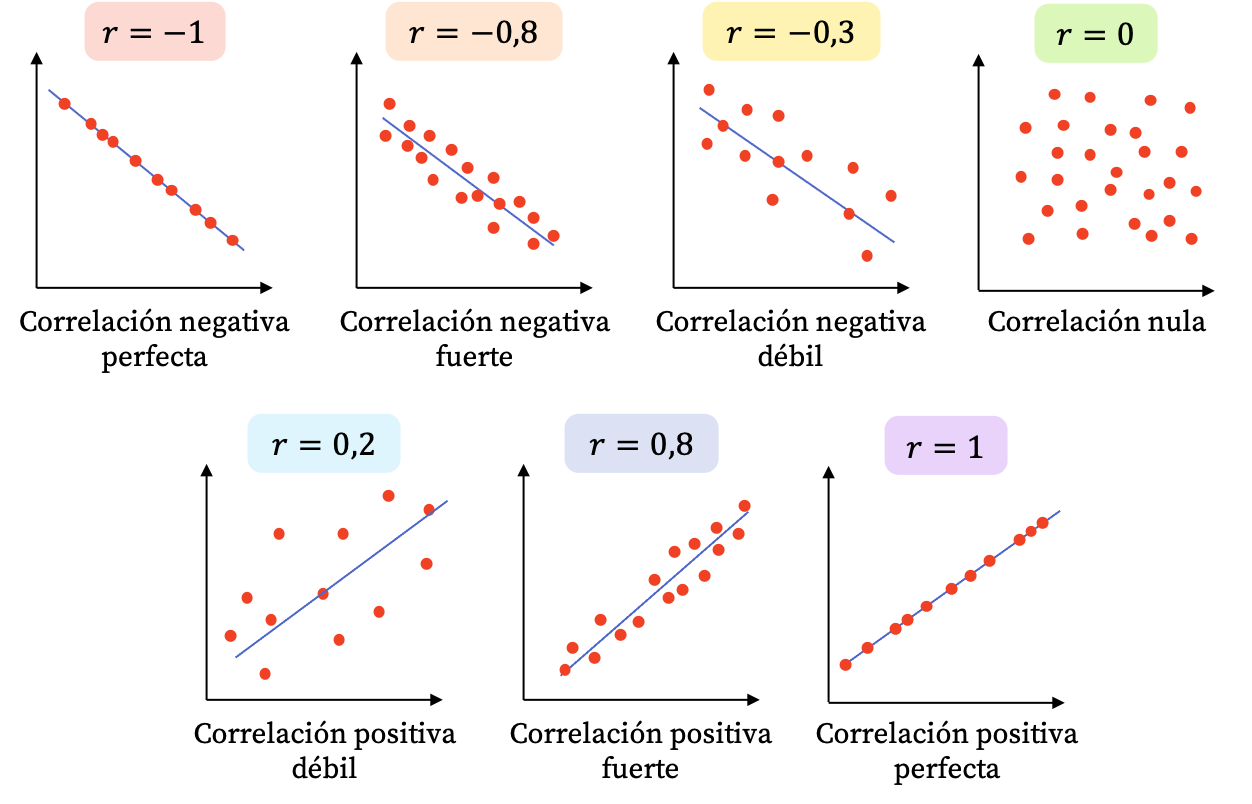

ค่าของสัมประสิทธิ์สหสัมพันธ์สามารถอยู่ในช่วงตั้งแต่ -1 ถึง +1 รวม ดังนั้น ขึ้นอยู่กับค่าของสัมประสิทธิ์สหสัมพันธ์ หมายความว่าความสัมพันธ์ระหว่างตัวแปรทั้งสองอยู่ในทิศทางเดียวหรืออีกทิศทางหนึ่ง ต่อไปนี้เป็น วิธีตีความค่าความสัมพันธ์ :

- r=-1 : ตัวแปรทั้งสองมีความสัมพันธ์เชิงลบที่สมบูรณ์แบบ ดังนั้นเราจึงสามารถวาดเส้นที่มีความชันเป็นลบโดยที่จุดทั้งหมดเชื่อมโยงกัน

- -1<r<0 : ความสัมพันธ์ระหว่างตัวแปรทั้งสองนั้นเป็นลบ ดังนั้นเมื่อตัวแปรตัวหนึ่งเพิ่มขึ้น อีกตัวแปรหนึ่งก็จะลดลง ยิ่งค่าเข้าใกล้ -1 มากเท่าใด ตัวแปรก็จะยิ่งมีความสัมพันธ์เชิงลบมากขึ้นเท่านั้น

- r=0 : ความสัมพันธ์ระหว่างตัวแปรทั้งสองนั้นอ่อนแอมาก จริงๆ แล้วความสัมพันธ์เชิงเส้นระหว่างตัวแปรทั้งสองนั้นเป็นศูนย์ นี่ไม่ได้หมายความว่าตัวแปรมีความเป็นอิสระ เนื่องจากอาจมีความสัมพันธ์แบบไม่เชิงเส้นได้

- 0<r<1 : ความสัมพันธ์ระหว่างตัวแปรทั้งสองเป็นค่าบวก ยิ่งค่าเข้าใกล้ +1 มากเท่าใด ความสัมพันธ์ระหว่างตัวแปรก็จะยิ่งแข็งแกร่งขึ้นเท่านั้น ในกรณีนี้ ตัวแปรตัวหนึ่งมีแนวโน้มที่จะเพิ่มมูลค่าเมื่ออีกตัวแปรหนึ่งเพิ่มขึ้นเช่นกัน

- r=1 : ตัวแปรทั้งสองมีความสัมพันธ์เชิงบวกที่สมบูรณ์แบบ กล่าวคือ ตัวแปรทั้งสองมีความสัมพันธ์เชิงเส้นเชิงบวก

ดังที่คุณเห็นในแผนภาพกระจายด้านบน ยิ่งความสัมพันธ์ระหว่างตัวแปรสองตัวมีมากขึ้น จุดต่างๆ บนกราฟก็จะยิ่งอยู่ใกล้กันมากขึ้นเท่านั้น ในทางกลับกัน หากจุดห่างกันมาก แสดงว่าความสัมพันธ์มีน้อย

โปรดทราบว่าแม้ว่าจะมีความสัมพันธ์กันระหว่างตัวแปรสองตัว แต่ก็ไม่ได้หมายความว่ามีสาเหตุ ระหว่างตัวแปรทั้งสอง กล่าวคือ ความสัมพันธ์ระหว่างตัวแปรสองตัวไม่ได้หมายความว่าการเปลี่ยนแปลงในตัวแปรตัวหนึ่งเป็นสาเหตุของการเปลี่ยนแปลงในตัวแปรอีกตัวหนึ่ง ตัวแปร.

ตัวอย่างเช่น ถ้าเราพบว่ามีความสัมพันธ์เชิงบวกระหว่างการผลิตฮอร์โมนที่แตกต่างกันของร่างกาย ก็ไม่ได้หมายความว่าการเพิ่มขึ้นของฮอร์โมนตัวหนึ่งจะทำให้ฮอร์โมนอีกตัวหนึ่งเพิ่มขึ้นเสมอไป อาจเป็นไปได้ว่าร่างกายผลิตฮอร์โมนทั้งสองตัวขึ้นมาเพราะต้องต่อสู้กับความเจ็บป่วยจึงทำให้ระดับฮอร์โมนทั้งสองเพิ่มขึ้นพร้อมๆ กัน ซึ่งสาเหตุอาจมาจากความเจ็บป่วย เพื่อตรวจสอบว่ามีความเชื่อมโยงเชิงสาเหตุระหว่างฮอร์โมนทั้งสองชนิดนี้หรือไม่ ควรทำการศึกษาโดยละเอียดเพิ่มเติม

สหสัมพันธ์และการถดถอย

สหสัมพันธ์และการถดถอย เป็นแนวคิดสองแนวคิดที่เกี่ยวข้องกันโดยทั่วไป เนื่องจากทั้งสองแนวคิดใช้ในการวิเคราะห์ความสัมพันธ์ระหว่างตัวแปรสองตัว

สหสัมพันธ์เป็นการวัดทางสถิติที่วัดความสัมพันธ์ระหว่างตัวแปรสองตัว อย่างไรก็ตาม การถดถอยเกี่ยวข้องกับการสร้างสมการ (หากเป็นการถดถอยเชิงเส้น ก็จะเป็นเส้นตรง) ที่ทำให้ตัวแปรทั้งสองมีความสัมพันธ์กัน

ดังนั้น ความสัมพันธ์เพียงแต่ให้ค่าตัวเลขกับความสัมพันธ์ระหว่างตัวแปร ในขณะที่การถดถอยสามารถใช้เพื่อพยายามทำนายค่าของตัวแปรหนึ่งที่สัมพันธ์กับอีกตัวแปรหนึ่งได้

โดยทั่วไป ขั้นแรกเราจะวิเคราะห์ว่าตัวแปรมีความสัมพันธ์กันหรือไม่โดยการคำนวณค่าสัมประสิทธิ์สหสัมพันธ์ และหากความสัมพันธ์มีนัยสำคัญ เราก็จะทำการถดถอยของชุดข้อมูล

เป็นเรื่องปกติที่จะสร้างความสับสนให้กับค่าสัมประสิทธิ์สหสัมพันธ์กับค่าของความชันของเส้นที่ได้จากการถดถอยเชิงเส้น อย่างไรก็ตาม ค่าเหล่านี้ไม่เท่ากัน

เมทริกซ์สหสัมพันธ์

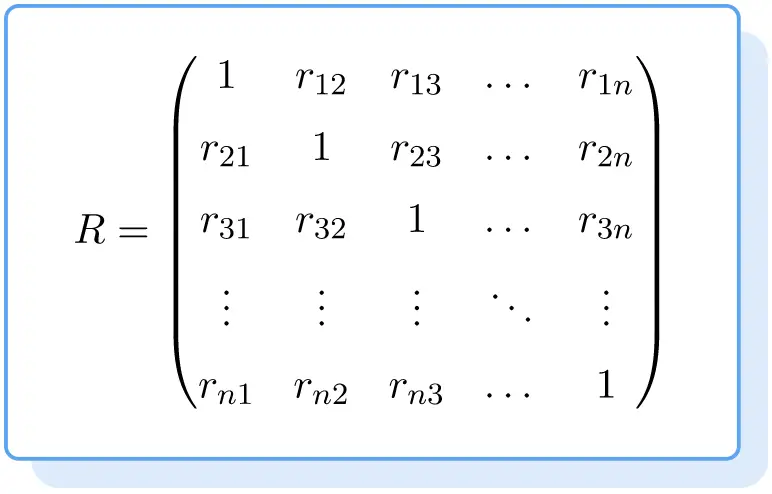

เมทริกซ์สหสัมพันธ์ คือเมทริกซ์ซึ่งมีตำแหน่ง i,j ค่าสัมประสิทธิ์สหสัมพันธ์ระหว่างตัวแปร i และ j .

ดังนั้นเมทริกซ์สหสัมพันธ์จึงเป็นเมทริกซ์จตุรัสที่เต็มไปด้วยเมทริกซ์บนเส้นทแยงมุมหลักและองค์ประกอบของแถว i และคอลัมน์ j ประกอบด้วยค่าของสัมประสิทธิ์สหสัมพันธ์ระหว่างตัวแปร i และตัวแปร j .

ดังนั้นสูตรสำหรับเมทริกซ์สหสัมพันธ์จึงเป็นดังนี้:

ทอง

![]()

คือค่าสัมประสิทธิ์สหสัมพันธ์ระหว่างตัวแปรต่างๆ

![]()

และ

![]()

เมทริกซ์สหสัมพันธ์มีประโยชน์มากในการสรุปผลลัพธ์และเปรียบเทียบความสัมพันธ์ระหว่างตัวแปรหลายตัวพร้อม ๆ กัน เพราะคุณสามารถดูได้อย่างรวดเร็วว่าความสัมพันธ์ใดที่แข็งแกร่ง