Множинна лінійна регресія

У цій статті пояснюється, що таке множинна лінійна регресія в статистиці. Крім того, ви дізнаєтеся, як створити модель множинної лінійної регресії та як вона інтерпретується.

Що таке множинна лінійна регресія?

Множинна лінійна регресія — це регресійна модель, у якій включено дві або більше незалежних змінних. Іншими словами, множинна лінійна регресія — це статистична модель, яка дозволяє лінійно пов’язати кілька пояснювальних змінних зі змінною відповіді.

Таким чином, модель множинної лінійної регресії використовується для пошуку рівняння, яке пов’язує дві або більше незалежних змінних із залежною змінною. Таким чином, підставляючи значення кожної незалежної змінної, отримують наближення значення залежної змінної.

Наприклад, рівняння y=3+6x 1 -4x 2 +7x 3 є моделлю множинної лінійної регресії, оскільки воно математично пов’язує три незалежні змінні (x 1 , x 2 , x 3 ) з однією залежною змінною (y) шляхом лінійного значення .

Формула множинної лінійної регресії

Рівняння для моделі множинної лінійної регресії має вигляд y=β 0 +β 1 x 1 +β 2 x 2 +…+β m x m +ε.

![]()

золото:

-

є залежною змінною.

-

є незалежною змінною i.

-

є константою рівняння множинної лінійної регресії.

-

це коефіцієнт регресії, пов’язаний зі змінною

.

-

Це помилка або залишок, тобто різниця між спостережуваним значенням і значенням, оціненим за допомогою моделі.

-

загальна кількість змінних у моделі.

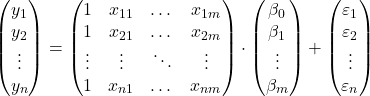

Отже, якщо у нас є вибірка із загальною кількістю

![]()

спостережень, ми можемо запропонувати модель множинної лінійної регресії у матричній формі:

Наведений вище вираз масиву можна переписати, призначивши літеру кожному масиву:

![]()

Таким чином, застосовуючи критерій найменших квадратів, можна прийти до формули для оцінки коефіцієнтів моделі множинної лінійної регресії :

![]()

Однак застосування цієї формули є дуже трудомістким і трудомістким, тому на практиці рекомендується використовувати комп’ютерне програмне забезпечення (наприклад, Minitab або Excel), яке дозволяє запускати кратну регресійну модель набагато швидше.

Припущення множинної лінійної регресії

У моделі множинної лінійної регресії мають бути виконані такі умови, щоб модель була дійсною:

- Незалежність : залишки повинні бути незалежними один від одного. Поширеним способом забезпечення незалежності моделі є додавання до процесу вибірки випадковості.

- Гомоскедастичність : дисперсії залишків повинні бути однорідними, тобто мінливість залишків має бути постійною.

- Немультиколінеарність : пояснювальні змінні, включені в модель, не можуть бути пов’язані одна з одною або, принаймні, їхній зв’язок має бути дуже слабким.

- Нормальність : залишки мають бути нормально розподілені, або, іншими словами, вони повинні відповідати нормальному розподілу із середнім 0.

- Лінійність : передбачається, що зв’язок між змінною відповіді та пояснювальними змінними є лінійним.

Інтерпретація моделі множинної лінійної регресії

Щоб інтерпретувати модель множинної лінійної регресії, ми повинні поглянути на коефіцієнт детермінації (R у квадраті), який виражає відсоток, пояснений регресійною моделлю. Таким чином, чим вищий коефіцієнт детермінації, тим більше модель буде налаштована на досліджувану вибірку даних.

Однак відповідність статистичної моделі може ввести в оману, особливо в моделях множинної лінійної регресії. Тому що при додаванні змінної в модель коефіцієнт детермінації зростає, навіть якщо змінна не є значущою. Однак необхідно максимізувати коефіцієнт детермінації, намагаючись мінімізувати кількість змінних, оскільки модель менш складна і легша для інтерпретації.

Щоб вирішити цю проблему, необхідно розрахувати скоригований коефіцієнт детермінації (скоригований R в квадраті), який є статистичним коефіцієнтом, який вимірює якість відповідності регресійної моделі, штрафуючи за кожну змінну, додану до моделі, на відміну від нескоригованого коефіцієнта рішучості. це не враховує кількість змінних у моделі.

Таким чином, скоригований коефіцієнт детермінації дозволяє порівняти відповідність двох моделей з різною кількістю змінних. В принципі, слід вибрати модель, яка має вищий скоригований коефіцієнт детермінації, але якщо дві моделі мають дуже схожі значення, краще вибрати модель з меншою кількістю змінних, оскільки її легше інтерпретувати.

Навпаки, коефіцієнти регресії вказують на зв’язок між пояснювальною змінною та змінною відповіді. Якщо коефіцієнт регресії позитивний, змінна відповіді буде збільшуватися разом зі збільшенням пояснювальної змінної. тоді як, якщо коефіцієнт регресії негативний, змінна відповіді буде зменшуватися, коли пояснювальна змінна зростатиме.

Логічно, щоб попередня умова була виконана, інші змінні повинні залишатися постійними. Ось чому важливо, щоб між різними пояснювальними змінними моделі не було мультиколінеарності. Ви можете побачити, як вивчається мультиколінеарність моделі, знайшовши відповідну статтю на нашому сайті.

Множинна та проста лінійна регресія

Нарешті, ми побачимо, які відмінності між моделлю простої лінійної регресії та моделлю множинної лінійної регресії, оскільки це дві моделі регресії, які широко використовуються в статистиці.

Проста лінійна регресія — це модель регресії, яка використовується для зв’язку незалежної змінної. Отже, рівняння моделі простої лінійної регресії має такий вигляд:

![]()

Отже, різниця між множинною лінійною регресією та простою лінійною регресією полягає в кількості пояснювальних змінних. Множинна лінійна регресійна модель має дві або більше пояснювальних змінних, тоді як проста лінійна регресійна модель має лише одну пояснювальну змінну.

![]()

Підсумовуючи, множинна лінійна регресія є розширенням простої лінійної регресії, оскільки просто додається більше пояснювальних змінних та їхні відповідні коефіцієнти регресії. Однак коефіцієнти регресії розраховуються інакше, щоб побачити, як це робиться, натисніть тут: