Підгонка кривої в r (з прикладами)

Часто вам може знадобитися знайти рівняння, яке найкраще відповідає кривій R.

У наступному покроковому прикладі пояснюється, як підігнати криві до даних у R за допомогою функції poly() і як визначити, яка крива найкраще відповідає даним.

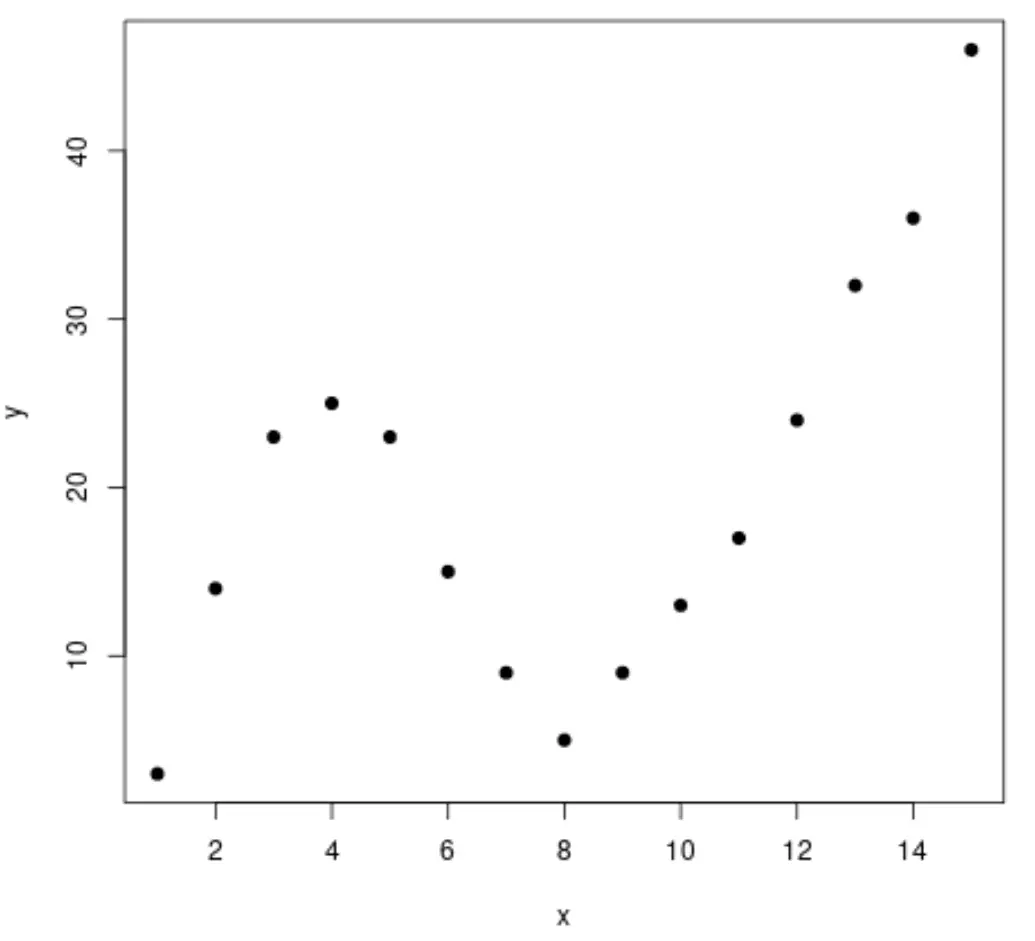

Крок 1: Створення та візуалізація даних

Давайте почнемо зі створення підробленого набору даних, а потім створимо діаграму розсіювання для візуалізації даних:

#create data frame df <- data. frame (x=1:15, y=c(3, 14, 23, 25, 23, 15, 9, 5, 9, 13, 17, 24, 32, 36, 46)) #create a scatterplot of x vs. y plot(df$x, df$y, pch= 19 , xlab=' x ', ylab=' y ')

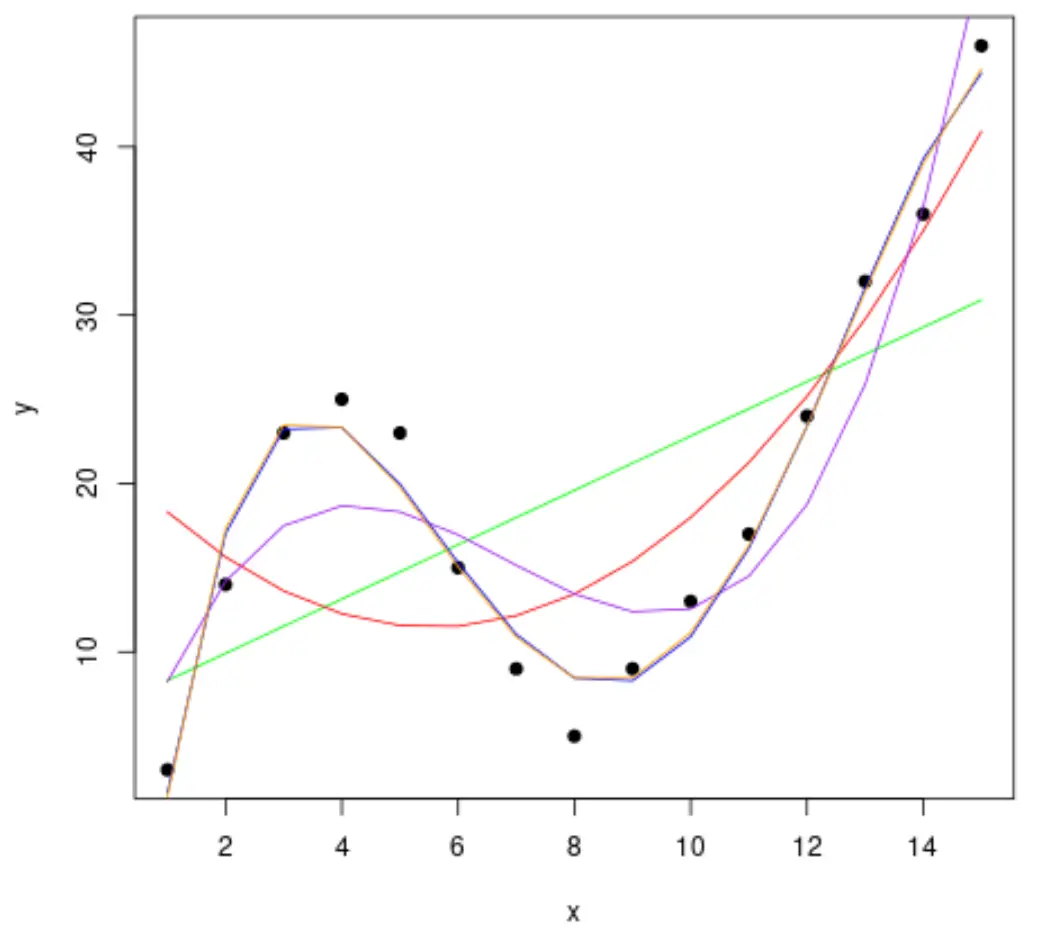

Крок 2: Налаштуйте кілька кривих

Тоді давайте підберемо кілька моделей поліноміальної регресії до даних і візуалізуємо криву кожної моделі на одному графіку:

#fit polynomial regression models up to degree 5 fit1 <- lm(y~x, data=df) fit2 <- lm(y~poly(x,2,raw= TRUE ), data=df) fit3 <- lm(y~poly(x,3,raw= TRUE ), data=df) fit4 <- lm(y~poly(x,4,raw= TRUE ), data=df) fit5 <- lm(y~poly(x,5,raw= TRUE ), data=df) #create a scatterplot of x vs. y plot(df$x, df$y, pch=19, xlab=' x ', ylab=' y ') #define x-axis values x_axis <- seq(1, 15, length= 15 ) #add curve of each model to plot lines(x_axis, predict(fit1, data. frame (x=x_axis)), col=' green ') lines(x_axis, predict(fit2, data. frame (x=x_axis)), col=' red ') lines(x_axis, predict(fit3, data. frame (x=x_axis)), col=' purple ') lines(x_axis, predict(fit4, data. frame (x=x_axis)), col=' blue ') lines(x_axis, predict(fit5, data. frame (x=x_axis)), col=' orange ')

Щоб визначити, яка крива найкраще відповідає даним, ми можемо подивитися на скоригований R-квадрат кожної моделі.

Це значення повідомляє нам про відсоток варіації змінної відповіді, який можна пояснити змінною(ями) предиктора в моделі, скоригованою на кількість змінних предиктора.

#calculated adjusted R-squared of each model summary(fit1)$adj. r . squared summary(fit2)$adj. r . squared summary(fit3)$adj. r . squared summary(fit4)$adj. r . squared summary(fit5)$adj. r . squared [1] 0.3144819 [1] 0.5186706 [1] 0.7842864 [1] 0.9590276 [1] 0.9549709

З результату ми бачимо, що модель з найвищим скоригованим R-квадратом є поліномом четвертого ступеня, який має скоригований R-квадрат 0,959 .

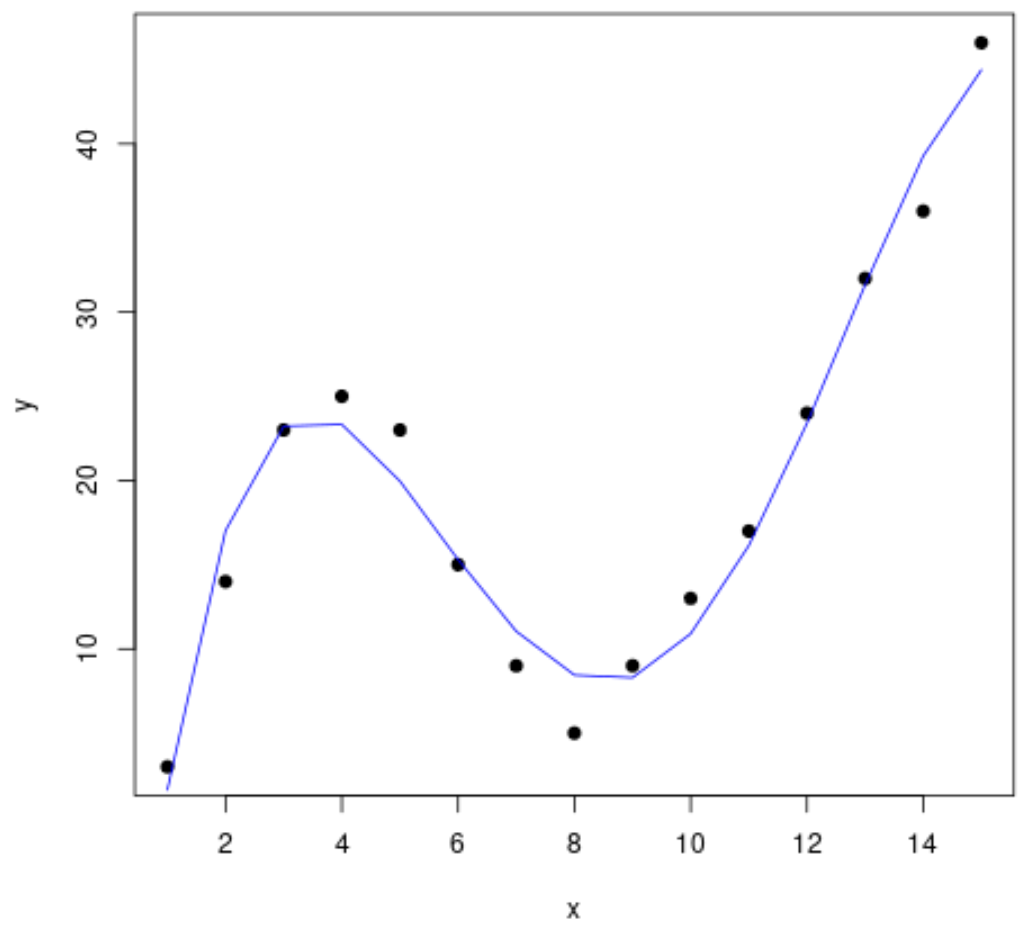

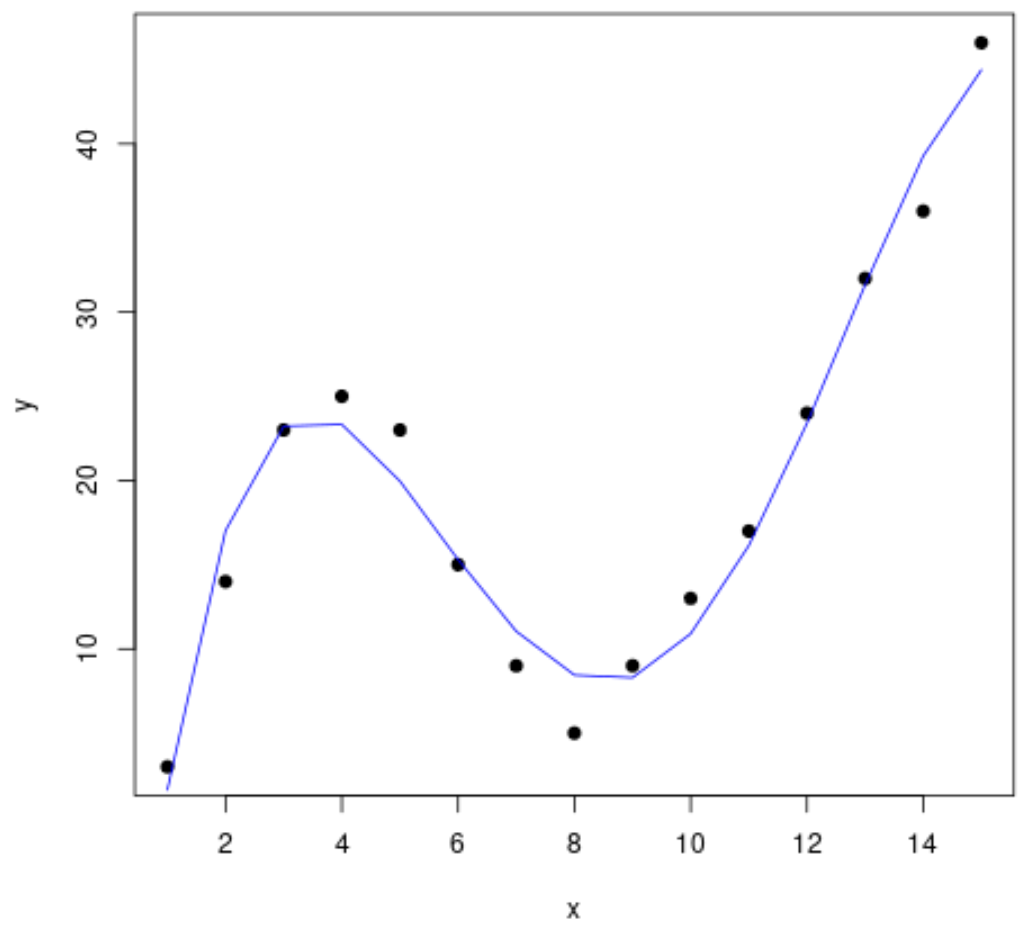

Крок 3: Візуалізуйте остаточну криву

Нарешті, ми можемо створити діаграму розсіювання з кривою поліноміальної моделі четвертого ступеня:

#create a scatterplot of x vs. y plot(df$x, df$y, pch=19, xlab=' x ', ylab=' y ') #define x-axis values x_axis <- seq(1, 15, length= 15 ) #add curve of fourth-degree polynomial model lines(x_axis, predict(fit4, data. frame (x=x_axis)), col=' blue ')

Ми також можемо отримати рівняння для цього рядка за допомогою функції summary() :

summary(fit4)

Call:

lm(formula = y ~ poly(x, 4, raw = TRUE), data = df)

Residuals:

Min 1Q Median 3Q Max

-3.4490 -1.1732 0.6023 1.4899 3.0351

Coefficients:

Estimate Std. Error t value Pr(>|t|)

(Intercept) -26.51615 4.94555 -5.362 0.000318 ***

poly(x, 4, raw = TRUE)1 35.82311 3.98204 8.996 4.15e-06 ***

poly(x, 4, raw = TRUE)2 -8.36486 0.96791 -8.642 5.95e-06 ***

poly(x, 4, raw = TRUE)3 0.70812 0.08954 7.908 1.30e-05 ***

poly(x, 4, raw = TRUE)4 -0.01924 0.00278 -6.922 4.08e-05 ***

---

Significant. codes: 0 '***' 0.001 '**' 0.01 '*' 0.05 '.' 0.1 ' ' 1

Residual standard error: 2.424 on 10 degrees of freedom

Multiple R-squared: 0.9707, Adjusted R-squared: 0.959

F-statistic: 82.92 on 4 and 10 DF, p-value: 1.257e-07

Рівняння кривої виглядає наступним чином:

y = -0,0192x 4 + 0,7081x 3 – 8,3649x 2 + 35,823x – 26,516

Ми можемо використовувати це рівняння, щоб передбачити значення змінної відповіді на основі змінних предиктора в моделі. Наприклад, якщо x = 4, ми передбачимо, що y = 23,34 :

y = -0,0192(4) 4 + 0,7081(4) 3 – 8,3649(4) 2 + 35,823(4) – 26,516 = 23,34

Додаткові ресурси

Вступ до поліноміальної регресії

Поліноміальна регресія в R (крок за кроком)

Як використовувати функцію seq у R