Comment calculer un intervalle de confiance pour une intersection de régression

La régression linéaire simple est utilisée pour quantifier la relation entre une variable prédictive et une variable de réponse.

Cette méthode trouve une ligne qui « correspond » le mieux à un ensemble de données et prend la forme suivante :

ŷ = b 0 + b 1 x

où:

- ŷ : La valeur de réponse estimée

- b 0 : L’origine de la droite de régression

- b 1 : La pente de la droite de régression

- x : La valeur de la variable prédictive

Nous sommes souvent intéressés par la valeur de b 1 , qui nous indique le changement moyen de la variable de réponse associé à une augmentation d’une unité de la variable prédictive.

Cependant, dans de rares circonstances, nous sommes également intéressés par la valeur de b 0 , qui nous indique la valeur moyenne de la variable de réponse lorsque la variable prédictive est égale à zéro.

Nous pouvons utiliser la formule suivante pour calculer un intervalle de confiance pour la valeur de β 0 , la véritable constante de la population :

Intervalle de confiance pour β 0 : b 0 ± t α/2, n-2 * se(b 0 )

L’exemple suivant montre comment calculer un intervalle de confiance pour une interception en pratique.

Exemple : intervalle de confiance pour l’interception de régression

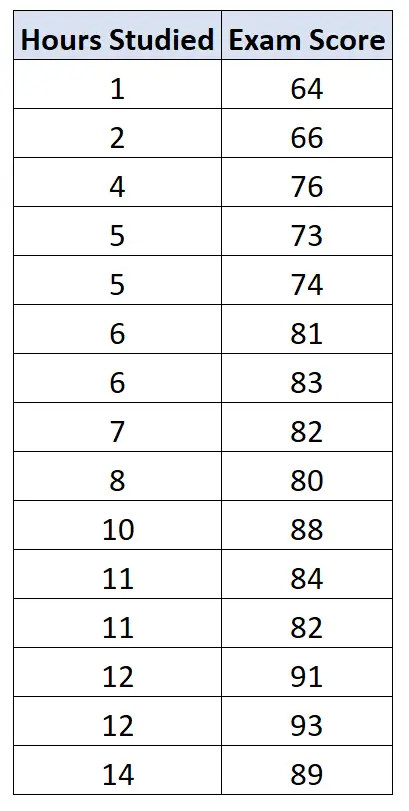

Supposons que nous souhaitions ajuster un modèle de régression linéaire simple utilisant les heures étudiées comme variable prédictive et les résultats à l’examen comme variable de réponse pour 15 étudiants d’une classe particulière :

Le code suivant montre comment adapter ce modèle de régression linéaire simple dans R :

#create data frame df <- data.frame(hours=c(1, 2, 4, 5, 5, 6, 6, 7, 8, 10, 11, 11, 12, 12, 14), score=c(64, 66, 76, 73, 74, 81, 83, 82, 80, 88, 84, 82, 91, 93, 89)) #fit simple linear regression model fit <- lm(score ~ hours, data=df) #view summary of model summary(fit) Call: lm(formula = score ~ hours, data = df) Residuals: Min 1Q Median 3Q Max -5.140 -3.219 -1.193 2.816 5.772 Coefficients: Estimate Std. Error t value Pr(>|t|) (Intercept) 65.334 2.106 31.023 1.41e-13 *** hours 1.982 0.248 7.995 2.25e-06 *** --- Signif. codes: 0 '***' 0.001 '**' 0.01 '*' 0.05 '.' 0.1 ' ' 1 Residual standard error: 3.641 on 13 degrees of freedom Multiple R-squared: 0.831, Adjusted R-squared: 0.818 F-statistic: 63.91 on 1 and 13 DF, p-value: 2.253e-06

En utilisant les estimations de coefficients dans le résultat, nous pouvons écrire le modèle de régression linéaire simple ajusté comme suit :

Score = 65,334 + 1,982*(Heures étudiées)

La valeur d’interception est 65,334. Cela nous indique que la note moyenne estimée à l’examen pour un étudiant qui étudie pendant zéro heure est de 65,334 .

Nous pouvons utiliser la formule suivante pour calculer un intervalle de confiance à 95 % pour l’interception :

- IC à 95 % pour β 0 : b 0 ± t α/2, n-2 * se(b 0 )

- IC à 95 % pour β 0 : 65,334 ± t 0,05/2, 15-2 * 2,106

- IC à 95 % pour β 0 : 65,334 ± 2,1604 * 2,106

- IC à 95 % pour β 0 : [60,78, 69,88]

Nous interprétons cela comme signifiant que nous sommes sûrs à 95 % que la note moyenne réelle aux examens des étudiants qui étudient pendant zéro heure se situe entre 60,78 et 69,88.

Remarque : Nous avons utilisé le calculateur de distribution t inverse pour trouver la valeur critique t qui correspond à un niveau de confiance de 95 % avec 13 degrés de liberté.

Précautions concernant le calcul d’un intervalle de confiance pour une intersection de régression

Dans la pratique, nous ne calculons souvent pas d’intervalle de confiance pour une ordonnée à l’origine de la régression, car cela n’a généralement pas de sens d’interpréter la valeur de l’ordonnée à l’origine dans un modèle de régression.

Par exemple, supposons que nous ajustions un modèle de régression qui utilise la taille d’un joueur de basket-ball comme variable prédictive et la moyenne de points par match comme variable de réponse.

Il n’est pas possible qu’un joueur mesure zéro pied, il ne serait donc pas logique d’interpréter l’interception littéralement dans ce modèle.

Il existe d’innombrables scénarios comme celui-ci dans lesquels une variable prédictive ne peut pas prendre la valeur zéro. Il n’est donc pas logique d’interpréter la valeur d’origine du modèle ou de créer un intervalle de confiance pour l’origine.

Par exemple, considérons les variables prédictives potentielles suivantes dans un modèle :

- Superficie d’une maison

- Longueur d’une voiture

- Poids d’une personne

Chacune de ces variables prédictives ne peut pas prendre la valeur zéro. Il ne serait donc pas logique de calculer un intervalle de confiance pour l’origine d’un modèle de régression dans l’une de ces circonstances.

Ressources additionnelles

Les didacticiels suivants fournissent des informations supplémentaires sur la régression linéaire :

Introduction à la régression linéaire simple

Introduction à la régression linéaire multiple

Comment lire et interpréter un tableau de régression

Comment signaler les résultats de la régression