Les quatre hypothèses de la régression linéaire

La régression linéaire est une méthode statistique utile que nous pouvons utiliser pour comprendre la relation entre deux variables, x et y. Cependant, avant de procéder à une régression linéaire, nous devons d’abord nous assurer que quatre hypothèses sont remplies :

1. Relation linéaire : Il existe une relation linéaire entre la variable indépendante, x, et la variable dépendante, y.

2. Indépendance : Les résidus sont indépendants. En particulier, il n’existe aucune corrélation entre les résidus consécutifs dans les données de séries chronologiques.

3. Homoscédasticité : Les résidus ont une variance constante à chaque niveau de x.

4. Normalité : Les résidus du modèle sont normalement distribués.

Si une ou plusieurs de ces hypothèses ne sont pas respectées, les résultats de notre régression linéaire peuvent alors être peu fiables, voire trompeurs.

Dans cet article, nous fournissons une explication pour chaque hypothèse, comment déterminer si l’hypothèse est remplie et que faire si l’hypothèse n’est pas respectée.

Hypothèse 1 : Relation linéaire

Explication

La première hypothèse de la régression linéaire est qu’il existe une relation linéaire entre la variable indépendante x et la variable indépendante y.

Comment déterminer si cette hypothèse est remplie

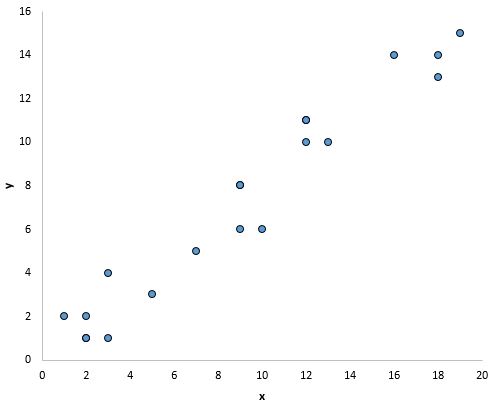

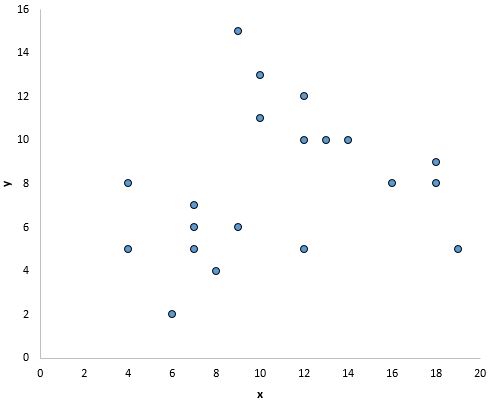

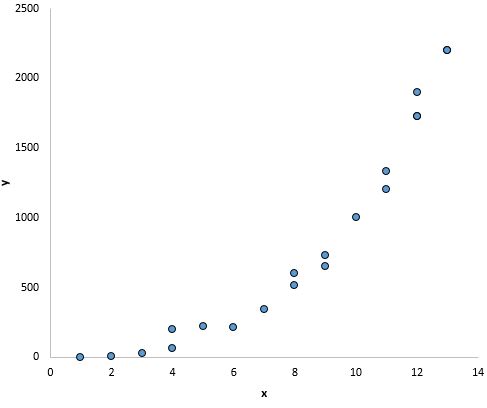

Le moyen le plus simple de détecter si cette hypothèse est satisfaite est de créer un nuage de points de x par rapport à y. Cela vous permet de voir visuellement s’il existe une relation linéaire entre les deux variables. S’il semble que les points du tracé pourraient se situer le long d’une ligne droite, alors il existe un certain type de relation linéaire entre les deux variables et cette hypothèse est remplie.

Par exemple, les points du graphique ci-dessous semblent tomber sur une ligne droite, ce qui indique qu’il existe une relation linéaire entre x et y :

Cependant, il ne semble pas y avoir de relation linéaire entre x et y dans le graphique ci-dessous :

Et dans ce graphique, il semble y avoir une relation claire entre x et y, mais pas une relation linéaire :

Que faire si cette hypothèse n’est pas respectée

Si vous créez un nuage de points de valeurs pour x et y et constatez qu’il n’y a pas de relation linéaire entre les deux variables, vous disposez de plusieurs options :

1. Appliquez une transformation non linéaire à la variable indépendante et/ou dépendante. Des exemples courants incluent la prise du log, de la racine carrée ou de l’inverse de la variable indépendante et/ou dépendante.

2. Ajoutez une autre variable indépendante au modèle. Par exemple, si le tracé de x en fonction de y a une forme parabolique, il peut être judicieux d’ajouter X 2 comme variable indépendante supplémentaire dans le modèle.

Hypothèse 2 : Indépendance

Explication

L’hypothèse suivante de la régression linéaire est que les résidus sont indépendants. Ceci est particulièrement pertinent lorsque vous travaillez avec des données de séries chronologiques. Idéalement, nous ne voulons pas qu’il y ait une tendance parmi les résidus consécutifs. Par exemple, les résidus ne devraient pas augmenter régulièrement avec le temps.

Comment déterminer si cette hypothèse est remplie

Le moyen le plus simple de vérifier si cette hypothèse est vérifiée consiste à examiner un tracé de série chronologique des résidus, qui est un tracé des résidus en fonction du temps. Idéalement, la plupart des autocorrélations résiduelles devraient se situer dans les bandes de confiance de 95 % autour de zéro, qui sont situées à environ +/- 2 sur la racine carrée de n , où n est la taille de l’échantillon. Vous pouvez également tester formellement si cette hypothèse est remplie à l’aide du test de Durbin-Watson .

Que faire si cette hypothèse n’est pas respectée

Selon la manière dont cette hypothèse est violée, vous disposez de plusieurs options :

- Pour une corrélation en série positive, envisagez d’ajouter des décalages de la variable dépendante et/ou indépendante au modèle.

- Pour une corrélation série négative, assurez-vous qu’aucune de vos variables n’est surdifférée .

- Pour la corrélation saisonnière, envisagez d’ajouter des variables fictives saisonnières au modèle.

Hypothèse 3 : Homoscédasticité

Explication

L’hypothèse suivante de la régression linéaire est que les résidus ont une variance constante à chaque niveau de x. C’est ce qu’on appelle l’homoscédasticité . Lorsque ce n’est pas le cas, les résidus souffrent d’ hétéroscédasticité .

Lorsque l’hétéroscédasticité est présente dans une analyse de régression, les résultats de l’analyse deviennent difficiles à croire. Plus précisément, l’hétéroscédasticité augmente la variance des estimations du coefficient de régression, mais le modèle de régression n’en tient pas compte. Cela rend beaucoup plus probable qu’un modèle de régression déclare qu’un terme du modèle est statistiquement significatif, alors qu’en réalité il ne l’est pas.

Comment déterminer si cette hypothèse est remplie

Le moyen le plus simple de détecter l’hétéroscédasticité consiste à créer un graphique valeur ajustée/résiduelle .

Une fois que vous avez ajusté une droite de régression à un ensemble de données, vous pouvez créer un nuage de points qui montre les valeurs ajustées du modèle par rapport aux résidus de ces valeurs ajustées. Le nuage de points ci-dessous montre un graphique typique de la valeur ajustée par rapport au résidu dans lequel l’hétéroscédasticité est présente.

Remarquez comment les résidus s’étalent de plus en plus à mesure que les valeurs ajustées augmentent. Cette forme de « cône » est un signe classique d’hétéroscédasticité :

Que faire si cette hypothèse n’est pas respectée

Il existe trois manières courantes de corriger l’hétéroscédasticité :

1. Transformez la variable dépendante. Une transformation courante consiste simplement à prendre le journal de la variable dépendante. Par exemple, si nous utilisons la taille de la population (variable indépendante) pour prédire le nombre de fleuristes dans une ville (variable dépendante), nous pouvons plutôt essayer d’utiliser la taille de la population pour prédire le logarithme du nombre de fleuristes dans une ville. L’utilisation du log de la variable dépendante, plutôt que de la variable dépendante d’origine, entraîne souvent la disparition de l’hétéroscédasticité.

2. Redéfinissez la variable dépendante. Une façon courante de redéfinir la variable dépendante consiste à utiliser un taux plutôt que la valeur brute. Par exemple, au lieu d’utiliser la taille de la population pour prédire le nombre de fleuristes dans une ville, nous pouvons utiliser la taille de la population pour prédire le nombre de fleuristes par habitant. Dans la plupart des cas, cela réduit la variabilité qui se produit naturellement au sein de populations plus importantes puisque nous mesurons le nombre de fleuristes par personne, plutôt que le nombre même de fleuristes.

3. Utilisez la régression pondérée. Une autre façon de corriger l’hétéroscédasticité consiste à utiliser la régression pondérée. Ce type de régression attribue un poids à chaque point de données en fonction de la variance de sa valeur ajustée. Essentiellement, cela donne de faibles poids aux points de données qui ont des variances plus élevées, ce qui réduit leurs carrés résiduels. Lorsque les pondérations appropriées sont utilisées, cela peut éliminer le problème de l’hétéroscédasticité.

Hypothèse 4 : normalité

Explication

L’hypothèse suivante de la régression linéaire est que les résidus sont normalement distribués.

Comment déterminer si cette hypothèse est remplie

Il existe deux manières courantes de vérifier si cette hypothèse est satisfaite :

1. Vérifiez visuellement l’hypothèse à l’aide des tracés QQ .

Un tracé QQ, abréviation de quantile-quantile plot, est un type de tracé que nous pouvons utiliser pour déterminer si les résidus d’un modèle suivent ou non une distribution normale. Si les points du tracé forment à peu près une ligne diagonale droite, alors l’hypothèse de normalité est remplie.

Le tracé QQ suivant montre un exemple de résidus qui suivent à peu près une distribution normale :

Cependant, le graphique QQ ci-dessous montre un exemple de cas où les résidus s’écartent clairement d’une ligne diagonale droite, ce qui indique qu’ils ne suivent pas la distribution normale :

2. Vous pouvez également vérifier l’hypothèse de normalité à l’aide de tests statistiques formels comme Shapiro-Wilk, Kolmogorov-Smironov, Jarque-Barre ou D’Agostino-Pearson. Cependant, gardez à l’esprit que ces tests sont sensibles aux échantillons de grande taille – c’est-à-dire qu’ils concluent souvent que les résidus ne sont pas normaux lorsque la taille de votre échantillon est grande. C’est pourquoi il est souvent plus facile d’utiliser simplement des méthodes graphiques comme un tracé QQ pour vérifier cette hypothèse.

Que faire si cette hypothèse n’est pas respectée

Si l’hypothèse de normalité n’est pas respectée, vous disposez de plusieurs options :

- Tout d’abord, vérifiez que les valeurs aberrantes n’ont pas un impact énorme sur la distribution. S’il y a des valeurs aberrantes, assurez-vous qu’il s’agit de valeurs réelles et qu’il ne s’agit pas d’erreurs de saisie de données.

- Ensuite, vous pouvez appliquer une transformation non linéaire à la variable indépendante et/ou dépendante. Des exemples courants incluent la prise du log, de la racine carrée ou de l’inverse de la variable indépendante et/ou dépendante.

Lectures complémentaires :

Introduction à la régression linéaire simple

Comprendre l’hétéroscédasticité dans l’analyse de régression

Comment créer et interpréter un tracé QQ dans R